Nachdem Tesla-Chef Elon Musk die neuesten Forschungsergebnisse des chinesischen KI-Unternehmens Kimi öffentlich gelobt hatte, antwortete Kimis offizieller Account heute in einem humorvollen Ton: „Eure Rakete ist auch nicht schlecht!“Kürzlich veröffentlichte das Kimi-Team einen technischen Bericht, in dem ein neuer Aufmerksamkeitsresidualmechanismus vorgeschlagen wurde, um eine disruptive Rekonstruktion der traditionellen Restverbindung zu erreichen, die im Bereich des Deep Learning seit fast zehn Jahren verwendet wird und schnell weltweite Aufmerksamkeit erlangte.

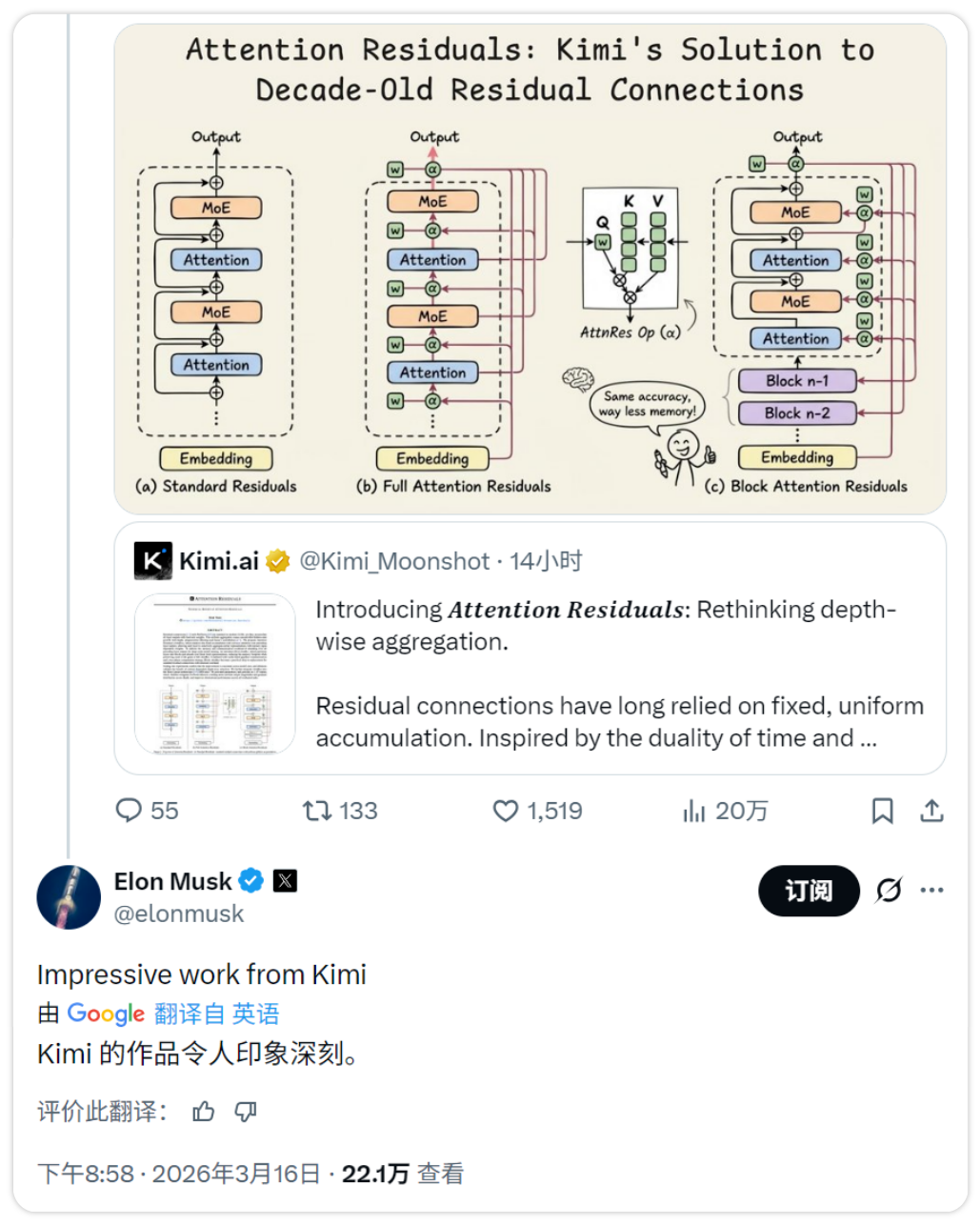

Herkömmliche Restverbindungen verwenden zur Übertragung von Informationen eine „feste Akkumulation gleicher Gewichtung“. Eine Erhöhung der Anzahl der Schichten kann leicht zu einer Verwässerung oberflächlicher Informationen, einer geringen Trainingseffizienz und einer schlechten Stabilität führen.

Kimis Innovation entspricht der Installation eines „intelligenten Filters“ auf der KI, der den Transformer-Aufmerksamkeitsmechanismus in die Tiefendimension des Modells migriert und es jeder Schicht ermöglicht, zuvor nützliche Informationen dynamisch zu überprüfen, Redundanz zu reduzieren und die Übertragungseffizienz zu verbessern.

Um eine Überlastung des Gedächtnisses zu vermeiden, entwickelte das Team die Strategie „Aufmerksamkeitsreste blockieren“. Nachdem das Modell in Blöcke unterteilt wurde, bleibt die traditionelle Akkumulation in den Blöcken erhalten, um Stabilität zu gewährleisten.Zwischen den Blöcken wird eine dynamische Gewichtung verwendet, und die Inferenzverzögerung erhöht sich nur um weniger als 2 %, wodurch ein Gleichgewicht zwischen Leistung und Effizienz erreicht wird.

Tatsächliche Messungen zeigen, dass die Trainingseffizienz des 48B-Parametermodells um das 1,25-fache erhöht wird und die Ergebnisse für wissenschaftliches Denken und mathematische Fragenbeantwortung um 7,5 % bzw. 3,6 % gesteigert werden, wodurch das Ungleichgewichtsproblem des traditionellen Modelltrainings effektiv gelöst wird.

Musk, der dafür bekannt ist, wählerisch zu sein, leitete die Recherche weiter und kommentierte: „Kimis Arbeit ist beeindruckend.“ Seine xAI befindet sich im Umstrukturierungsprozess und diese Anerkennung zeigt ihr technisches Gewicht.

Darüber hinaus schrieb Jerry Tworek, der ehemalige Vizepräsident für Forschung bei OpenAI, bekannt als „Vater der Inferenzmodelle“, auch: „Deep Learning 2.0 kommt.“