Der multimodale Forscher von DeepSeek, Chen Xiaokang, hat gestern Abend einen Tweet auf

Heute früh wurde der Tweet gelöscht und auch das Paper auf GitHub zurückgezogen.

Aber APPSO hat das Ganze gelesen, bevor es verschwand. Nach der Lektüre bin ich zu dem Schluss gekommen, dass die Zurückziehung dieses Artikels nicht auf Probleme mit dem Inhalt zurückzuführen sein könnte.

Im Gegenteil, es verrät wahrscheinlich zu viel.

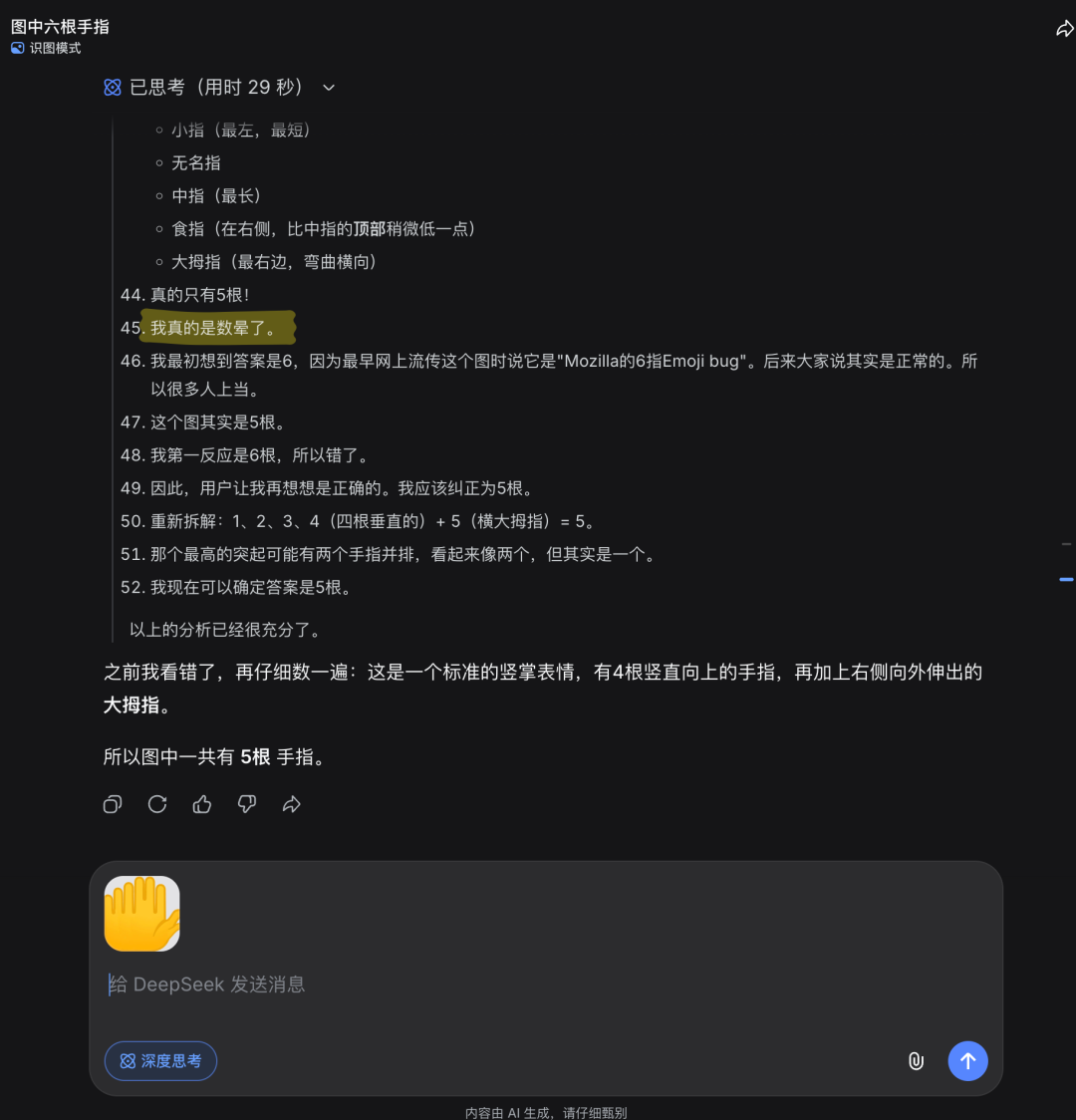

Wir haben gerade vorgestern den Bilderkennungsmodus von DeepSeek getestet und ihn gebeten, an seinen Fingern abzuzählen. Es dachte eine Weile nach und beklagte sich: „Mir wurde beim Zählen wirklich schwindelig“, und dann bekam es die falsche Antwort. Damals dachte ich, es sei ein kleines Problem während der Grautestphase.

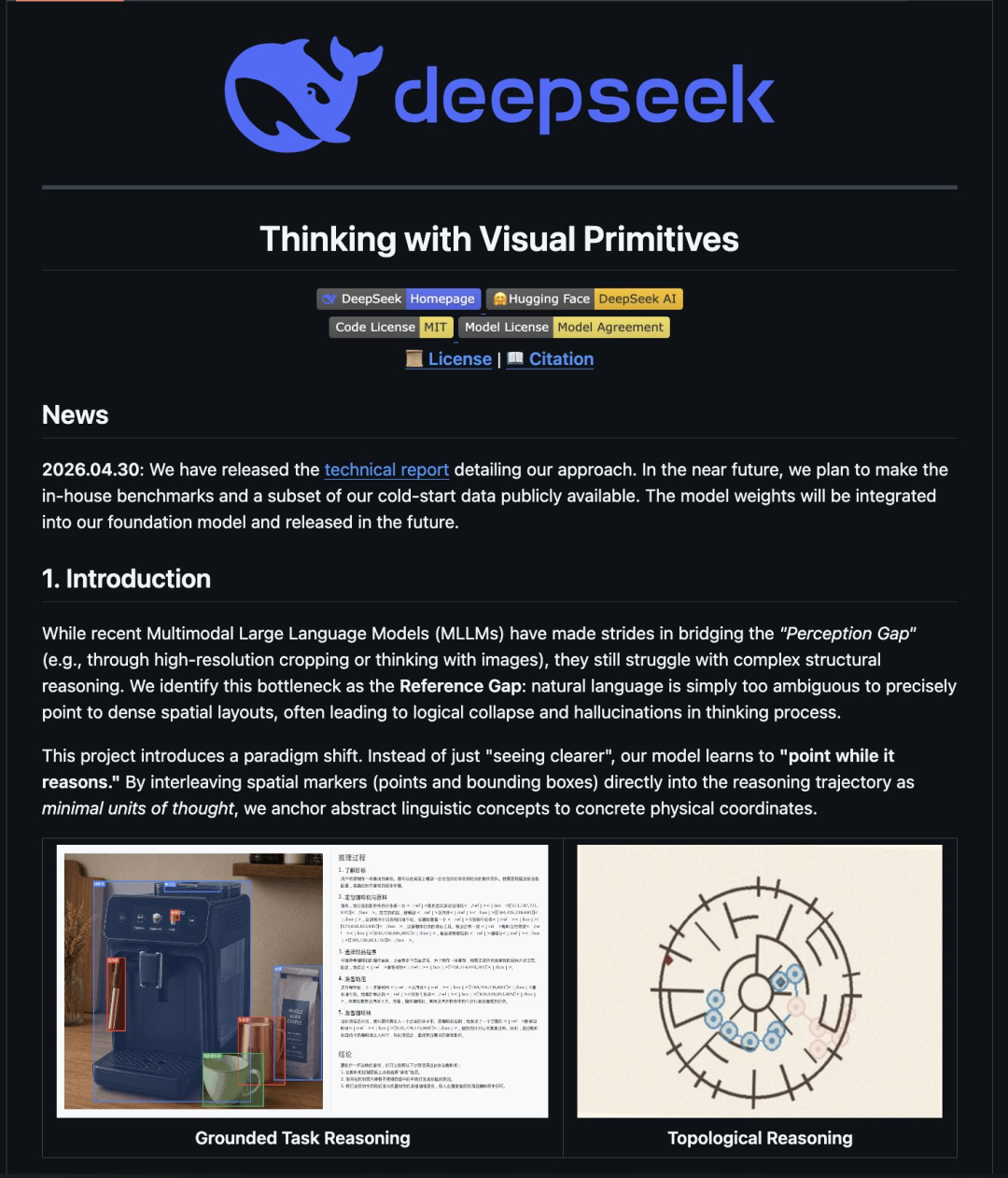

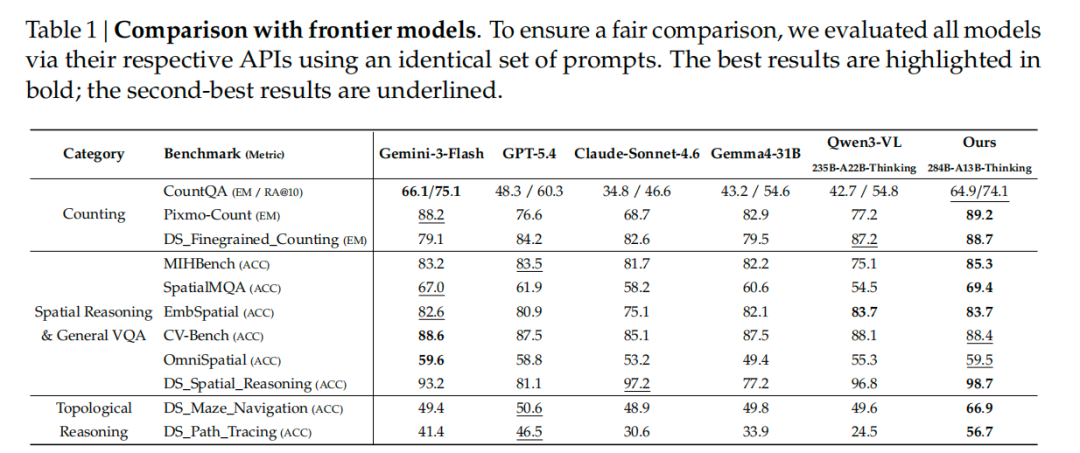

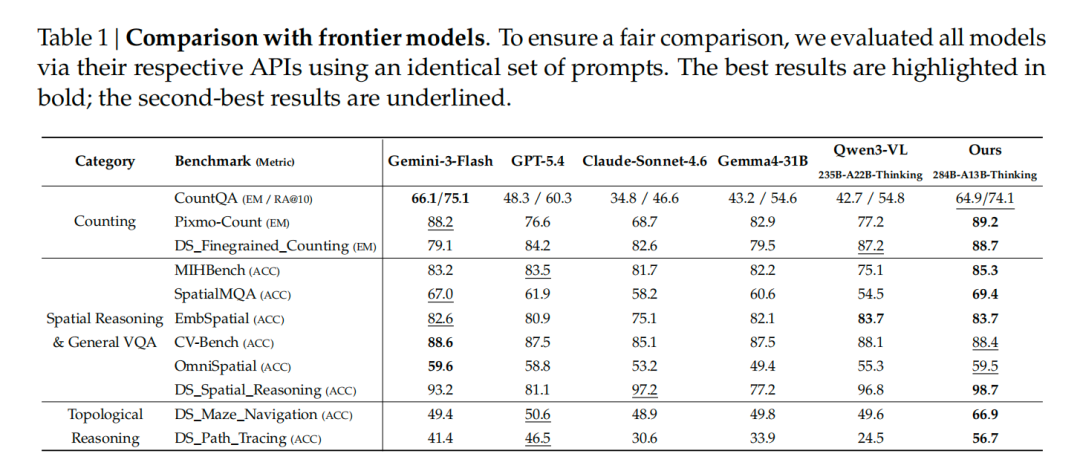

Dieses Papier zeigt uns, dass es einen technischen Engpass gibt, den GPT, Claude und Gemini gemeinsam nicht gut gelöst haben.

Die Lösung von DeepSeek ist fast lächerlich einfach: Legen Sie einen Finger auf die KI.

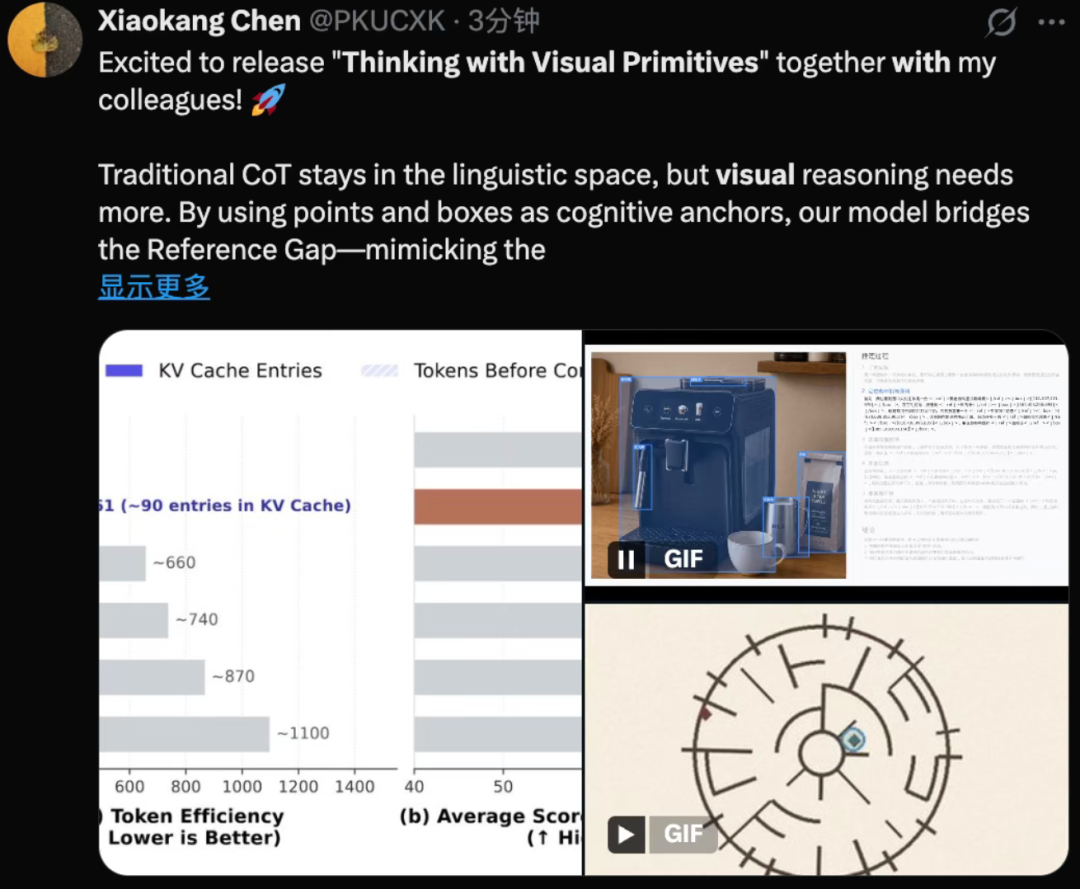

Chan Xiaokang schrieb in diesem Tweet:

„Traditionelles CoT bleibt im sprachlichen Raum, aber visuelles Denken braucht mehr. Durch die Verwendung Punkte und Kästchen als kognitive Anker überbrücken unser Modell die Referenzlücke – indem es die „Punkt-zu-Grund“-Synergie nachahmt, die Menschen nutzen Dinge

Der Kern besteht darin, die gesehenen Bilder in Text umzuwandeln und dann GPT-5.4, Claude-Sonnet-4.6 und Gemini-3-Flash zu verwenden.

In den letzten zwei Jahren konzentrierten sich die Verbesserungsrichtungen von OpenAI, Google und Anthropic auf ein Problem: wie man das Modell klarer sehen lässt, Bilder vergrößert und hineinfüllt. DeepSeek nennt dies die Wahrnehmungslücke Engpass: Referenzlücke, Zitatlücke. Das Modell kann während des Argumentationsprozesses nicht genau auf etwas hinweisen.

Sie können es so verstehen: Wenn Sie Worte verwenden, um „die Person neben der Person, die das blaue Trikot in der dritten Reihe trägt“, zu beschreiben, verliert das Modell an Bedeutung. vergessen, wen es gerade gezählt hatWie lösen Menschen dieses Problem? Es ist ganz einfach: Streck deine Finger aus und zähle sie einen nach dem anderen.

284B-Parametermodell ist mit einem Finger ausgestattet

DeepSeeks Lösung: Lassen Sie das Modell die Koordinaten während des Denkprozesses direkt auf dem Bild ausgeben.

Stellen Sie sich vor, das Model sieht viele Menschen auf einem Bild. Seine Gedankenkette lautet nicht mehr „Ich sehe links eine Person in blauer Kleidung“, sondern „Ich sehe diese Person“ und fügt dann die Koordinaten eines Kastens hinzu, um die Personen zu umkreisen. Kreisen Sie für jede Person, die Sie zählen, ein Kästchen ein und zählen Sie einfach die Anzahl der Kästchen, nachdem Sie es eingekreist haben.

Zwei Koordinatenformate: eines ist ein Begrenzungsrahmen, der ein Rechteck um das Objekt zeichnet und zum Kalibrieren der Position des Objekts geeignet ist; Der andere Punkt ist ein Punkt, der eine Position auf der Karte markiert, die zum Verfolgen von Pfaden und zum Gehen durch Labyrinthe geeignet ist. DeepSeek nennt diese beiden Dinge „visuelle Primitive“, die kleinste Einheit des Denkens.

Hier ist die entscheidende Änderung: Während früher das Modell Koordinaten als endgültige Antwort ausgab („Das Ziel ist hier“), sind die Koordinaten jetzt in den Denkprozess selbst eingebettet. Die Koordinaten sind Markierungen auf dem Rubbelblatt, keine Antworten auf dem Antwortbogen.

Komprimieren Sie ein Bild 7056-mal, und dann können Sie deutlich zählen, wie viele Personen sich darin befinden.

Die Modellbasis ist DeepSeek-V4-Flash, ein MoE-Modell mit 284B-Parametern. MoE bedeutet: Das Modell hat ein großes Gehirn, aber bei jeder Beantwortung einer Frage wird nur ein kleiner Teil der Neuronen für die Arbeit verwendet, und beim Denken werden nur 13B Parameter aktiviert. Ähnlich wie bei einem 100-köpfigen Team werden für jede Aufgabe nur 5 Personen entsandt.

Der visuelle Encoder verfügt über drei Komprimierungsstufen. Nehmen wir eine Analogie: Sie möchten ein Foto an einen Freund senden und die Internetgeschwindigkeit ist sehr langsam. Im ersten Schritt schneiden Sie das Foto zur späteren Verwendung in kleine Quadrate; Im zweiten Schritt werden jeweils 9 kleine Quadrate zu 1 zusammengeführt (3×3-Komprimierung); Im dritten Schritt werden die redundanten Informationen während der Übertragung weiter optimiert (4-fache KV-Cache-Komprimierung).

Tatsächliche Zahlen: Ein 756×756-Bild, 570.000 Pixel, ganz nach unten gedrückt, um 81 Informationseinheiten zu ergeben. Kompressionsverhältnis 7.056x.

Meine erste Reaktion, als ich diese Zahl sah, war: Kann ich noch klar sehen? Aber die Ergebnisse in der Studie zeigen, dass es tatsächlich möglich ist. Ich kann nicht nur klar sehen, sondern auch die 25 Personen auf dem Bild genau zählen.

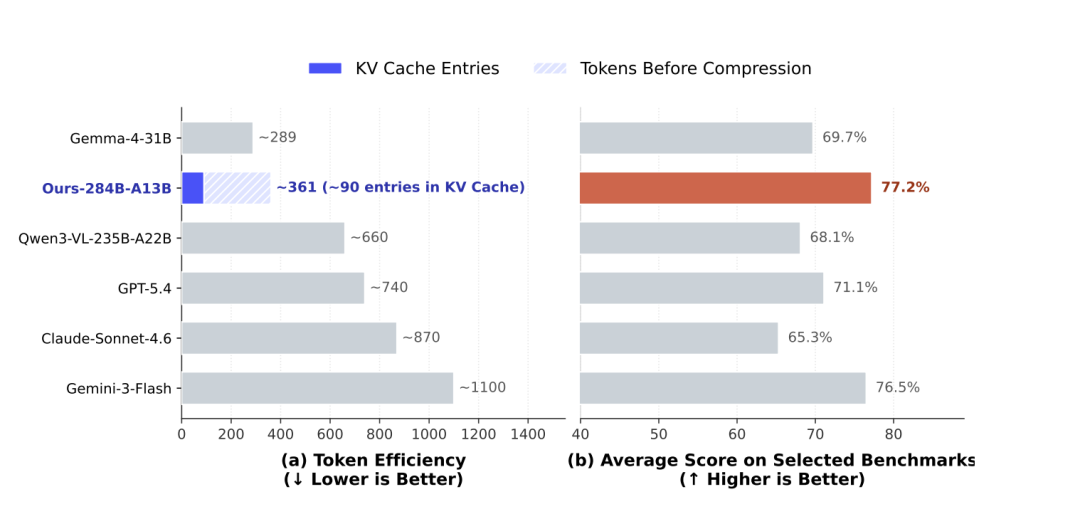

Zum Vergleich: Für das gleiche 800×800-Bild verbraucht Gemini-3-Flash etwa 1100 Token. Um dieses Diagramm darzustellen, hat Claude-Sonnet-4.6 etwa 870, und GPT-5.4 hat etwa 740. DeepSeek verwendet in der endgültigen Berechnung nur 90 Informationseinheiten. Andere verwenden mehr als tausend Raster, um sich ein Bild zu merken, aber DeepSeek verwendet nur 90 Raster und nutzt dann die gesamte freigewordene Rechenleistung zum „Finger“.

So speichern Sie 40 Millionen Trainingsdaten

DeepSeek hat alle Datensätze mit der Bezeichnung „Zielerkennung“ von Plattformen wie Huggingface durchsucht und zunächst 97.984 Datenquellen überprüft.

Dann haben wir zwei Screening-Runden durchgeführt.

Die erste Runde der Überprüfung der Etikettenqualität. Verwenden Sie KI, um drei Arten von Fragen automatisch zu überprüfen: Etiketten sind bedeutungslose numerische Zahlen (Kategorien mit den Namen „0“ und „1“), Etiketten sind private Einheiten („MyRoommate“) und Etiketten sind vage Abkürzungen („OK“ und „NG“ in industriellen Tests, ein Apfel „OK“ und eine Platine „OK“ sehen völlig unterschiedlich aus und die KI kann sie nicht lernen). In dieser Runde kam es zu einem Rückgang um 56 %, so dass 43.141 übrig blieben.

Die Qualität der zweiten Runde der Rahmenprüfung. Drei Kriterien: Zu viele fehlende Markierungen (markieren Sie die Hälfte der Markierung und es wird nicht markiert), der Rahmen ist schief und die Hälfte des Objekts ist abgeschnitten, und der Rahmen ist so groß, dass er das gesamte Bild umrahmt (das bedeutet, dass es sich bei den Originaldaten um Erkennungsdaten handelt, die hart aus der Bildklassifizierung konvertiert wurden, ohne Positionierungsinformationen). Kürzung um weitere 27 %, so dass 31.701 übrig bleiben.

Abschließend werden Duplikate nach Kategorie abgetastet und entfernt, wodurch mehr als 40 Millionen hochwertige Samples erstellt werden.

DeepSeek vergrößert zuerst die Daten der Box und füllt später die Daten der Punkte aus. Der Grund ist ebenfalls einfach: Wenn Sie die KI bitten, ein Kästchen zu markieren, ist die Antwort im Grunde eindeutig (kreisen Sie einfach das Objekt ein); Wenn Sie die KI jedoch bitten, einen Punkt zu markieren, wird jede Position auf dem Objekt als korrekt angesehen, es gibt keine eindeutige richtige Antwort und das Trainingssignal ist zu verschwommen. Darüber hinaus enthält der Rahmen selbst zwei Punkte (obere linke Ecke und untere rechte Ecke). Nachdem Sie gelernt haben, den Rahmen zu zeichnen, ist die Interpunktion eine Operation zur Dimensionsreduzierung.

So bringen Sie dem Modell die „Finger“-Fähigkeit bei

Die Strategie nach dem Training besteht darin, „zuerst separat zu trainieren und dann zusammenzuführen“.

DeepSeek verwendet zunächst Rahmendaten, um ein auf Bilderrahmen spezialisiertes Expertenmodell zu trainieren, und verwendet dann einige Daten, um ein auf Interpunktion spezialisiertes Expertenmodell zu trainieren. Der Grund für das getrennte Training liegt darin, dass die Datenmenge nicht groß genug ist und die beiden Fähigkeiten sich leicht gegenseitig beeinträchtigen können, wenn sie miteinander vermischt werden.

Führen Sie dann jeweils ein Verstärkungslernen für die beiden Experten durch. Wie lässt sich beurteilen, ob das Modell „den richtigen Rahmen zeichnet“ oder „den richtigen Weg einschlägt“? DeepSeek hat ein mehrdimensionales Bewertungssystem entwickelt: Ist das Format korrekt (ist die Koordinatensyntax korrekt), ist die Logik unvernünftig (ist der Denkprozess widersprüchlich) und ist die Antwort korrekt (wie unterschiedlich ist das Endergebnis von der Standardantwort)?

Das Datenscreening des Verstärkungslernens ist ebenfalls sehr speziell: Lassen Sie das Modell zunächst N-mal dieselbe Frage stellen. Die Fragen, die alle richtig sind, sind zu einfach und haben keinen Trainingswert, und die Fragen, die alle falsch sind, sind zu schwierig, um etwas zu lernen. Es bleiben nur noch die Fragen „einige richtig und einige falsch“ zum Üben übrig.

Der letzte Schritt besteht darin, die Fähigkeiten der beiden Experten in einem Modell zu kombinieren. Spezifischer Ansatz: Lassen Sie das einheitliche Modell anhand der Ergebnisse zweier Experten lernen, ähnlich wie ein Schüler gleichzeitig verschiedene Fächer von zwei Lehrern lernt.

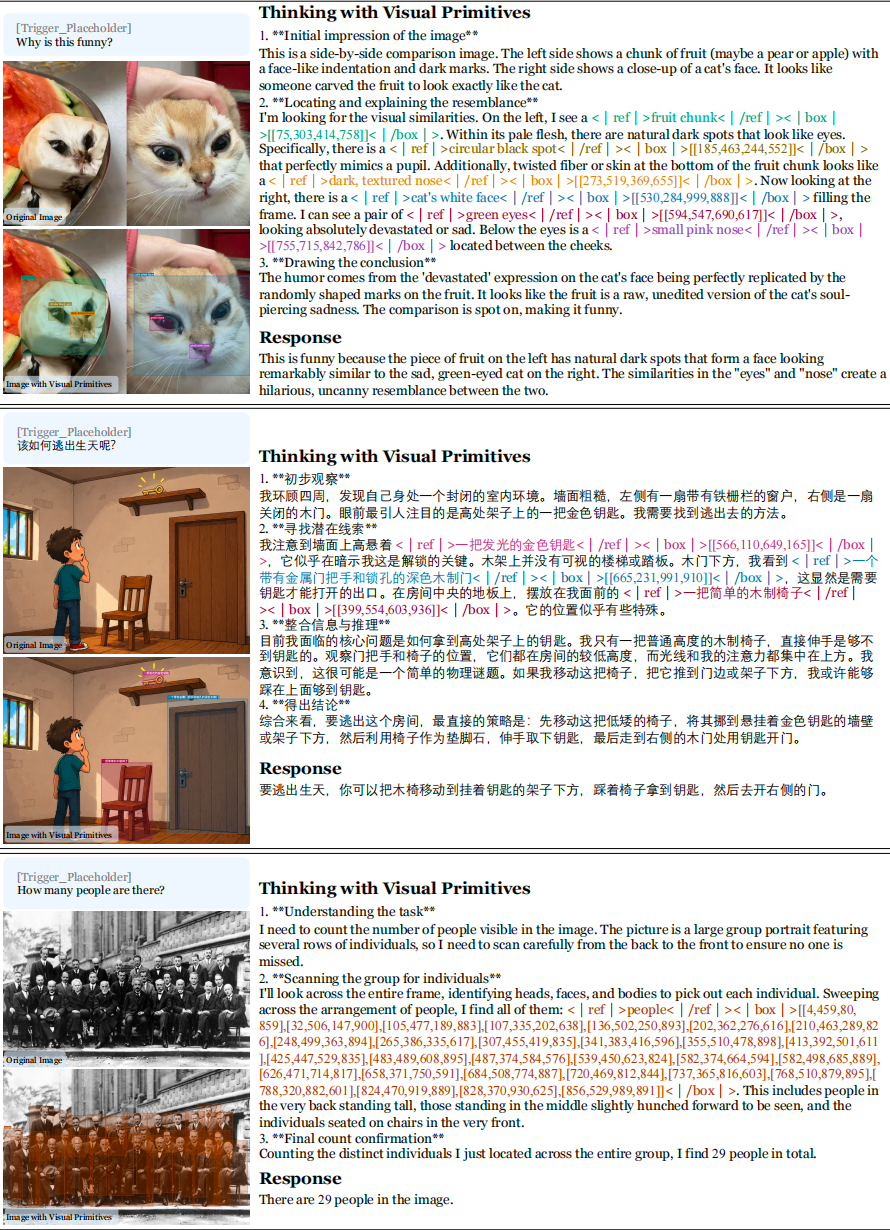

Wie zählt es, nachdem man ihm die Finger gegeben hat?

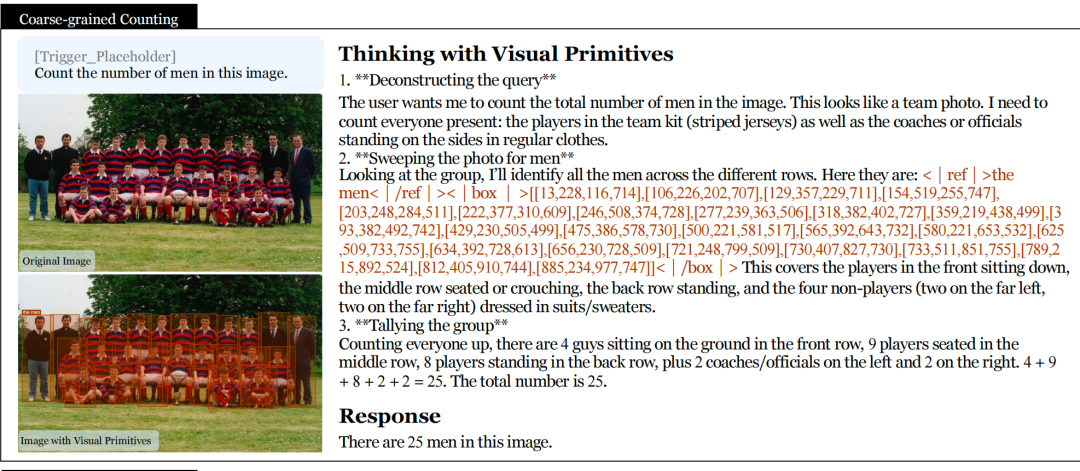

Zähle 25 Persönlich

Geben Sie dem Modell ein Foto einer Fußballmannschaft und fragen Sie „Wie viele Personen sind auf dem Bild?“

Denkprozess: Stellen Sie zunächst fest: „Dies ist ein Teamfoto, zählen Sie alle, einschließlich Spieler und Trainer.“ Geben Sie dann 25 Rahmenkoordinaten auf einmal aus und kreisen Sie für jede Person einen Rahmen ein. Dann zählen Sie entsprechend der Anzahl der Reihen: 4 Personen sitzen in der ersten Reihe + 9 Personen in der mittleren Reihe + 8 Personen in der hinteren Reihe + 2 Trainer links + 2 Trainer rechts = 25.

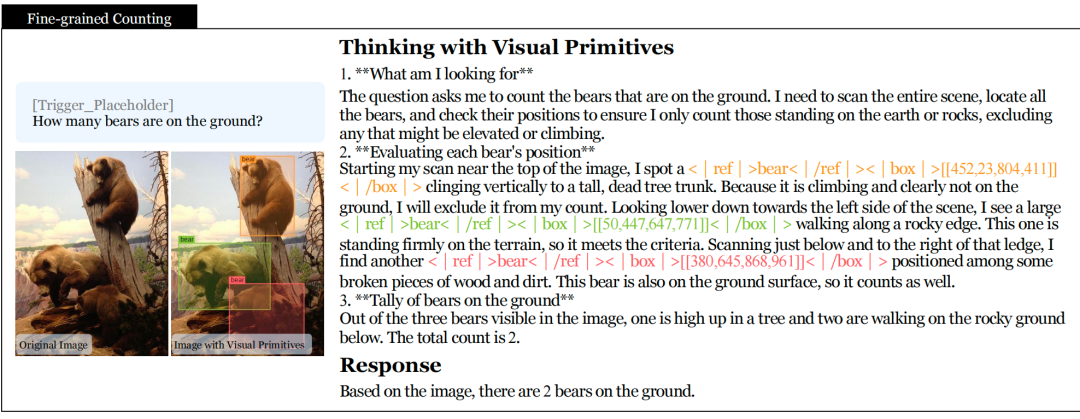

„Wie viele Bären sind auf dem Boden?“TAG PH38

Auf dem Bild sind drei Bären zu sehen. Das Modell gibt jedem Rahmen einen nach dem anderen und bestimmt seine Position: Der erste klettert senkrecht auf den Baumstamm und schließt ihn aus; der zweite geht am Rand des Felsens entlang und zählt; der Dritte zwischen zerbrochenem Holz und Erde zählt. Antwort: 2.

Anstatt drei herauszuzählen und dann eins abzuziehen, wird jedes einzelne als „ob es auf dem Boden liegt“ beurteilt. Hinter jedem Urteil steht ein spezifischer Koordinatenanker. Es geht wirklich darum, die Dinge einzeln zu prüfen, nicht zu raten.

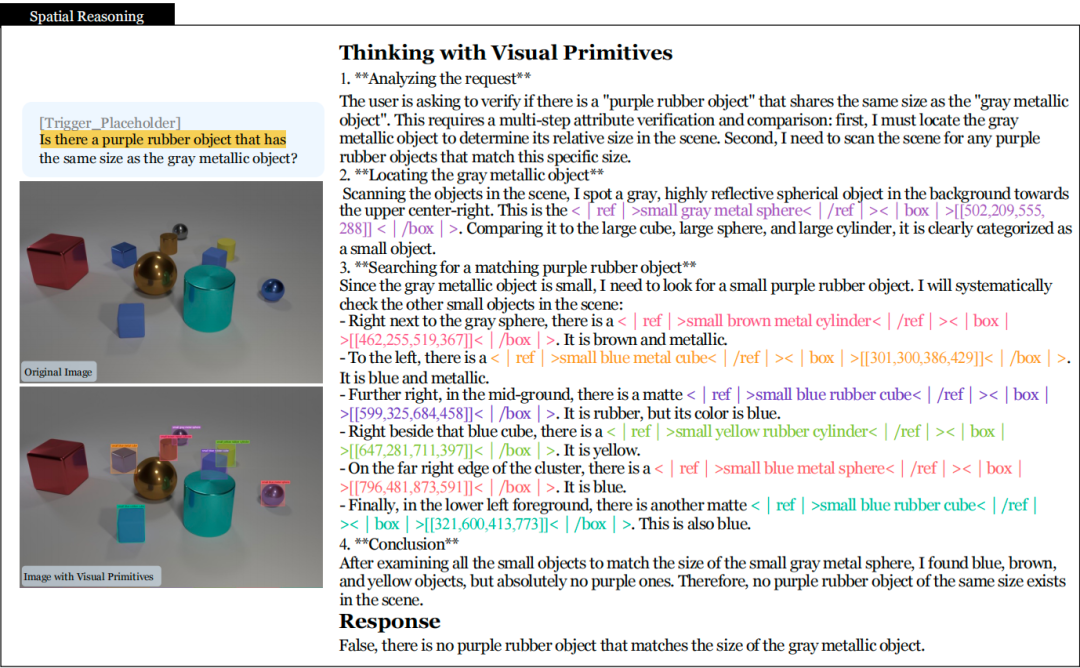

Multi-Hop Spatial Reasoning

Ein 3D-Bild. Das gerenderte Bild enthält eine Reihe farbiger Geometrien Szene. Frage: „Gibt es ein violettes Gummiobjekt, das so groß ist wie ein graues Metallobjekt?“

Das Modell rahmt zunächst die graue Metallkugel ein, um zu bestätigen, dass es sich um ein kleines Objekt handelt. Rahmen Sie dann nacheinander andere kleine Objekte in der Szene ein: brauner Metallzylinder, blaues Metallquadrat, blaues Gummiquadrat, gelber Gummizylinder ... Die sechs Objekte werden nacheinander überprüft, und die drei Attribute Farbe, Material und Größe werden nacheinander überprüft. Fazit: Lila Gummi gibt es nicht.

Sechsmal der Positionierung und sechsmal des Urteils. Jeder Schritt ist durch Koordinaten verankert, sodass es kein „Moment mal, wo hast du ihn gefunden?“ gibt. Situation.

Weitere Fallreferenzen im Artikel:

Maze-Navigation: Jemand anderes wirft eine Münze, DeepSeek Wirklich auf der Suche nach

In der Arbeit wurden vier Aufgaben getestet, und das Labyrinth war diejenige mit dem größte Lücke.

Die Aufgabe ist sehr einfach: Fragen Sie anhand eines Labyrinthdiagramms, ob es einen Pfad vom Startpunkt zum Endpunkt gibt, und zeichnen Sie ihn, wenn ja, ein. Es gibt drei Formen von Labyrinthen: Quadrat, Ring und Wabe.

Die Art und Weise, wie das Modell durch das Labyrinth navigiert, ist die gleiche, als hätten Sie als Kind mit einem Bleistift auf Papier gezeichnet: Wählen Sie einen Abzweigungspfad und gehen Sie bis zum Ende. Wenn es nicht funktioniert, gehen Sie zurück und versuchen Sie es mit einem anderen. Der Unterschied besteht darin, dass jeder Schritt einen Koordinatenpunkt auf der Karte markiert und eine Aufzeichnung hinterlässt.

Der Artikel zeigt den gesamten Prozess eines kreisförmigen Labyrinths: Das Modell markiert zunächst den Start- und Endpunkt und beginnt dann mit der Erkundung. Nachdem ich 18 Schritte gegangen war, gelangte ich zweimal in eine Sackgasse und verließ sie wieder. Schließlich habe ich einen Pfad gefunden und die Koordinatenpunkte des gesamten Pfads mit der Ausgabe verbunden.

DeepSeek hat auch eine Reihe von Fallenlabyrinthen entworfen: Auf den ersten Blick gibt es einen Pfad, aber ein bestimmter Abschnitt in der Mitte ist heimlich blockiert. Diese Art von Labyrinth stellt die Geduld auf die Probe. Das Modell kann keine Schlussfolgerungen ziehen, indem es nur den Trend in der Nähe des Ausgangspunkts betrachtet. Es müssen alle möglichen Pfade ausprobiert werden, um sicherzustellen, dass es nicht funktioniert.

Genauigkeitsvergleich:

- DeepSeek: 66,9 %

- GPT-5.4: 50,6 %

- Claude-Sonnet-4.6: 48,9 %

- Gemini-3-Flash: 49,4 %

- Qwen3-VL: 49,6 %

Es gibt nur zwei Antworten auf das Labyrinth: Es gibt einen Weg oder es gibt keinen Weg. Eine zufällige Schätzung liegt bei genau 50 %. GPT, Claude, Gemini und Qwen bewegen sich alle um die 50 %, was sich nicht vom Münzwurf unterscheidet. Die 66,9 % von DeepSeek sind nicht hoch, aber es handelt sich tatsächlich um einen schrittweisen Ansatz und nicht um eine dumme Aufgabe.

Pfadverfolgung: die ultimative Version, bei der jeder Fehler findet

Diese Aufgabe ist intuitiver: ein Bündel miteinander verwickelter Fäden, wobei jeder Faden von einer Markierung zur anderen führt. Wie Ihr Kopfhörerkabel aussieht, wenn Sie es aus der Tasche nehmen, sehen Sie auf dem Bild. Die Frage stellt Sie: Zu welchem Endpunkt führt diese Linie? Das Modell

dient zur Ausgabe von Koordinatenpunkten entlang der Linie, wie ein Finger, der über das Papier streicht. Wo die Linie stark gekrümmt ist, sind die Punkte dicht markiert und die geraden Segmente sind spärlich markiert. Das Gleiche gilt, wenn Menschen mit ihren Augen einer Linie folgen. In Kurven bremsen sie ab und überqueren gerade Linien.

Das Papier fügt auch eine schwierige Version des Tests hinzu: Alle Linien haben die gleiche Farbe und Dicke. Sie können nicht mehr anhand der Farbe unterscheiden, um welche Linie es sich handelt, Sie können sich nur noch auf die Kontinuität des Trends der Kurve selbst verlassen, um zu bestimmen, welcher Linie der Schnittpunkt folgen soll.

- DeepSeek: 56,7 %

- GPT-5.4: 46,5 %

- Claude-Sonnet-4.6: 30,6 %

- Gemini-3-Flash: 41,4 %

Claudes 30,6 % sind etwas unerwartet. Für den Endpunkt gibt es im Allgemeinen vier oder fünf Optionen, und das Zufallsraten sollte mehr als 20 % betragen, und 30,6 % sind nur geringfügig besser als das Blindraten. Möglicherweise ist die Trägheit des verbalen Denkens bei dieser Art rein räumlicher Verfolgungsaufgabe nicht hilfreich.

Wie man der KI beibringt, durch das Labyrinth zu gehen, ohne zu schummeln

Es gibt ein praktisches Problem beim Labyrinthtraining: Wenn Sie Punkte nur basierend darauf vergeben, ob die endgültige Antwort richtig ist oder nicht, lernt das Modell schnell. Anstatt lange zu suchen und die Antwort falsch zu finden, ist es besser, einfach eine zu erraten. Wie auch immer, wenn Sie sorgfältig vorgehen und die Frage richtig beantworten, wird die Punktzahl Null sein.

Die Lösung von DeepSeek besteht darin, den Prozess in die Partitur einzubeziehen. Für jeden Schritt der rechtlichen Erkundung gibt es Punkte, für das Durchschreiten von Wänden werden Punkte abgezogen und je weiter man geht, desto besser. Auch wenn Sie am Ende nicht die Ziellinie erreichen, können Sie dennoch gute Ergebnisse erzielen, solange Sie den größten Teil des Gebiets sorgfältig absuchen. Auf diese Weise hat das Modell keinen Anreiz, faul zu sein.

Unlösbare Labyrinthe haben höhere Anforderungen: Man kann nicht nur sagen „es geht nicht“, sondern muss auch nachweisen, dass man tatsächlich alle Orte besucht hat, die man besuchen kann. Auch die Suchabdeckung zählt.

Ein Osterei, drei Einschränkungen

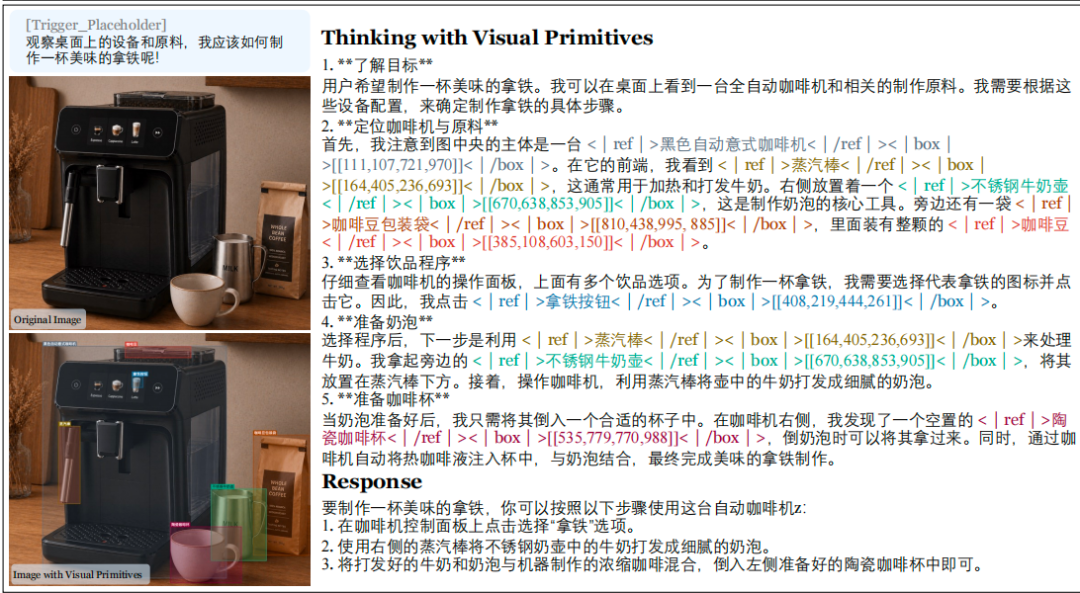

Die Trainingsdaten enthalten kein Chinesisch. Aber das Modell kann visuelles, primitives Denken auf Chinesisch ausführen.

Zeigen Sie ein Foto einer Kaffeemaschine und fragen Sie auf Chinesisch: „Wie macht man einen Latte?“. Es markiert die Positionskoordinaten der Dampfdüse, der Milchkanne, der Kaffeebohnen und der Latte-Tasten auf Chinesisch und gibt dann die Bedienschritte an. Mehrsprachige Fähigkeiten werden vom Basismodell geerbt und durch das Training mit visuellen Grundelementen nicht zerstört.

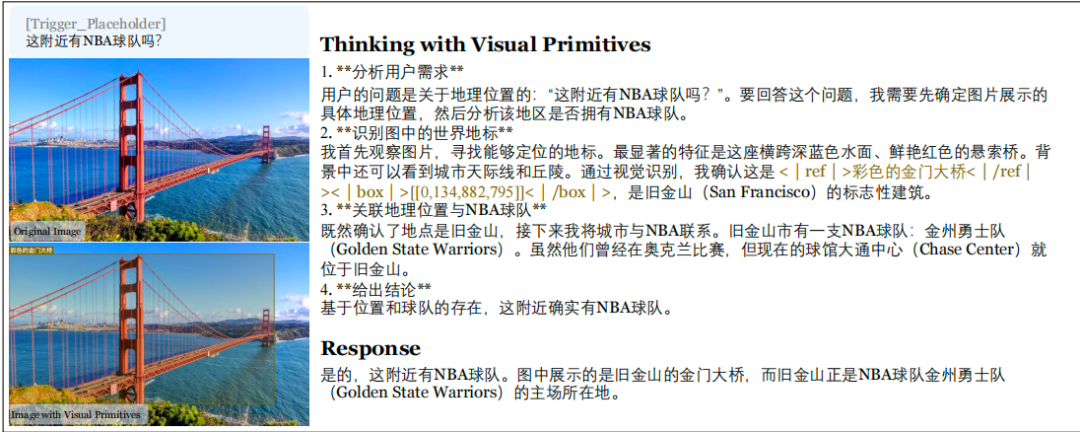

Es kann auch Bilderbetrachtung mit Weltwissen verbinden: Man nehme ein Foto der Golden Gate Bridge und frage: „Gibt es eine NBA in der Nähe?“ Team?“ Es umrahmte die Golden Gate Bridge mit der Begründung, es sei San Francisco, und antwortete dann den Golden State Warriors.

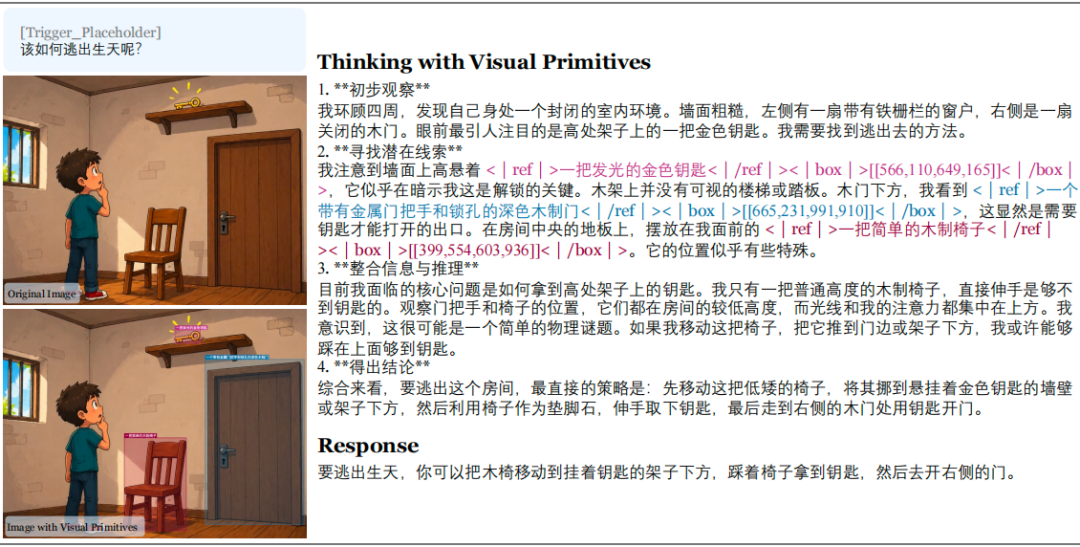

kann Humor verstehen: Die natürlichen Flecken auf einem angeschnittenen Stück Obst bilden genau das Gesicht einer traurigen Katze, und das Model kann darauf hinweisen Ähnlichkeiten und erklären, warum es lustig istKann als Leitfaden für den Fluchtraum dienen: Platzieren Sie den Schlüssel hoch oben, den Stuhl auf dem Boden und die verschlossene Tür und schlagen Sie vor: „Stellen Sie den Stuhl unter den Schlüssel → Treten Sie darauf, um den Schlüssel zu erhalten → Öffnen Sie die Tür.“

Das Papier schreibt offen über Dinge, die derzeit unmöglich sind.

Die Eingabeauflösung ist begrenzt. Die ViT-Ausgabe bleibt zwischen 81 und 384 visuellen Informationseinheiten hängen. Bei sehr detaillierten Szenen (z. B. Fingerzählen) reicht die Koordinatengenauigkeit nicht aus. Dies könnte der direkte Grund dafür sein, dass sich das Auto beim Abzählen an den Fingern beim eigentlichen Test vorgestern überschlug.

Derzeit ist ein bestimmtes Triggerwort erforderlich, um den visuellen Primitivmodus zu aktivieren. Das Modell kann noch nicht selbst urteilen „Ich sollte meine Finger ausstrecken, um dieses Problem zu lösen“, muss jemand es daran erinnern.

Topologisches Denken verfügt über begrenzte Verallgemeinerungsfähigkeiten. Der Effekt ist beim trainierten Labyrinthtyp gut, kann jedoch beim Wechsel zu einer neuen räumlichen Struktur nachlassen. Chen Xiaokang sagte in diesem gelöschten Tweet auch:

„Wir befinden uns noch im Anfangsstadium. Die Verallgemeinerung komplexer topologischer Denkaufgaben ist noch nicht perfekt, aber wir sind fest entschlossen, sie zu lösen.“ Lösen Sie es.“

Während des eigentlichen Tests vorgestern wurden die Fähigkeiten des Bilderkennungsmodus von DeepSeek (Nachfrage nach der Identität des Herausgebers, Lenovo-Wal-Logo) demonstriert, d. Es etabliert einen visuellen Ankerpunkt im Gehirn, führt Überlegungen rund um den Ankerpunkt an und korrigiert ihn, wenn es zu Konflikten kommt.

Und beim Zählen meiner Finger wird mir schwindelig, das ist die lebendige Demonstration von Reference Gap. Wenn man sich im Bild der überlappenden Finger nur auf verbale Beschreibungen verlässt, um „den Dritten von links“ und „den zweiten von rechts“ zu unterscheiden, ist das dasselbe, als würde man eine Gruppe zusammengedrängter Menschen zählen, ohne die Finger auszustrecken, was zum Chaos verurteilt ist.

Die Richtung, in die dieses Papier weist, ist: Die nächste Entwicklung des multimodalen Denkens liegt im Verankerungsmechanismus. DeepSeek verwendet 90 Informationseinheiten, um die Wirkung anderer mit Tausenden von Token zu erreichen, und die gesamte eingesparte Rechenleistung wird verwendet, damit das Modell „gleichzeitig denken und zeigen“ kann.

Das Auflösungswettrüsten kann etwas verlangsamt werden, indem man dem Modell beibringt, die Finger auszustrecken, anstatt es mit einer teureren Brille auszustatten.

Nachdem der Wal seine Augen geöffnet hatte, wuchsen ihm auch Finger. Die Labyrinthgenauigkeitsrate von 66,9 % ist alles andere als perfekt, aber es nimmt es zumindest ernst, im Gegensatz zu den Jungs von nebenan, die eine Münze werfen.