Am 24. April wurde die Vorschauversion von DeepSeeks neuem Serienmodell DeepSeek-V4 offiziell gestartet und gleichzeitig als Open Source bereitgestellt. Berichten zufolge verfügt DeepSeek-V4 über einen ultralangen Kontext mit einer Million Wörtern und ist in Bezug auf Agentenfähigkeiten, Weltwissen und Argumentationsleistung führend im Inlands- und Open-Source-Bereich.

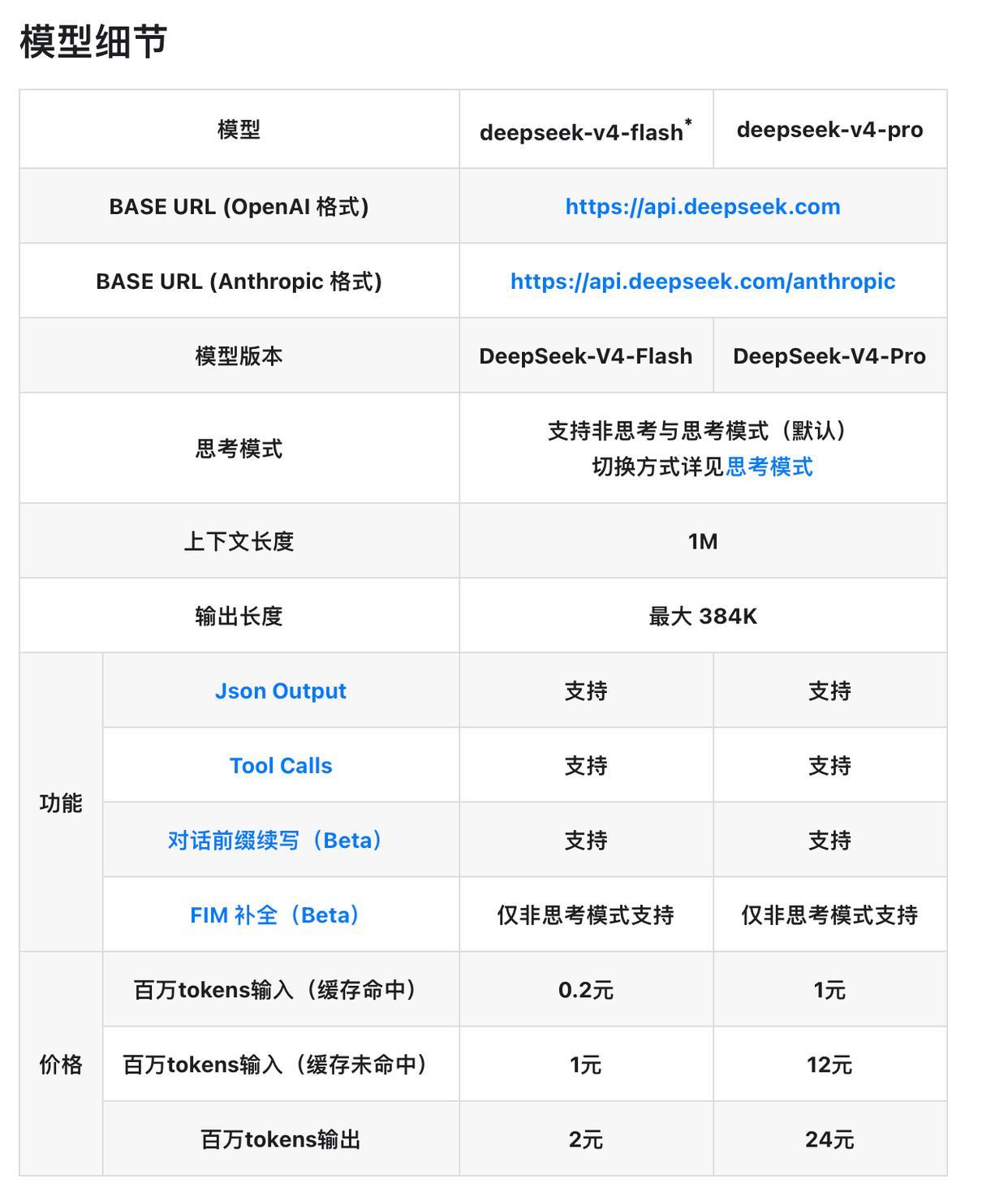

Melden Sie sich ab sofort auf der offiziellen Website chat.deepseek.com oder der offiziellen App an, um mit dem neuesten DeepSeek-V4 zu sprechen und die neue Erfahrung des 1M ultralangen Kontextspeichers zu erkunden. Der API-Dienst wurde synchron aktualisiert und kann durch Ändern des Modellnamens in „deepseek-v4-pro“ oder „deepseek-v4-flash“ aufgerufen werden.

Darüber hinaus hat DeepSeek-V4 Mainstream-Agent-Produkte wie Claude Code, OpenClaw, OpenCode und CodeBuddy angepasst und optimiert und so seine Leistung bei Aufgaben wie der Code- und Dokumentgenerierung verbessert. Sowohl V4-Pro als auch V4-Flash unterstützen eine Kontextlänge von 1 Mio. und bieten sowohl den Nicht-Denkmodus als auch den Denkmodus. Letzterer kann den Parameter reasoning_effort (hoch/max) festlegen. Für komplexe Agentenszenarien lautet die offizielle Empfehlung, den Denkmodus zu verwenden und die Intensität auf Maximum einzustellen.