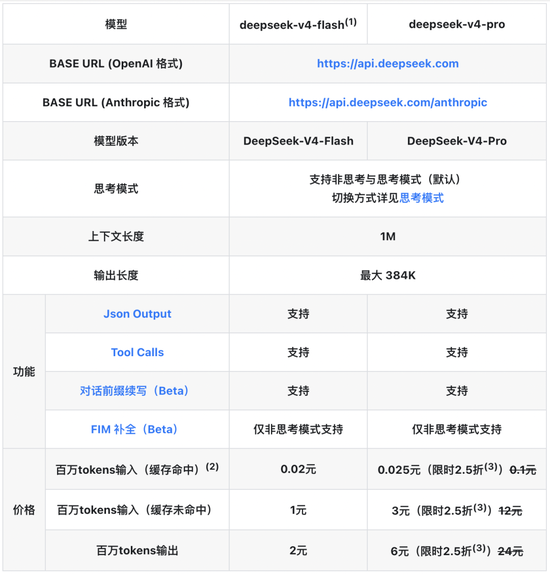

DeepSeek definiert die Grenzen der Einbeziehung großer Modelle neu. Am 26. April veröffentlichte DeepSeek offiziell eine Ankündigung zur API-Preisanpassung. Der Preis aller API-Eingabe-Cache-Treffer wurde auf ein Zehntel des ursprünglichen Preises gesenkt. Das V4-Pro-Upgrade ist für begrenzte Zeit 25 % günstiger und die Eingabe-Cache-Hits von einer Million Token kosten nur 0,025 Yuan, was einen neuen Tiefstpreis für große Modelle weltweit darstellt.

Laut der Ankündigung auf der offiziellen API-Preisseite von DeepSeek gilt diese Preissenkung für alle Modelle der V4-Serie, und die Kernanpassungen konzentrieren sich auf Eingabe-Cache-Treffer-Szenarien. Unter anderem sank der Hit-Preis für den DeepSeek-V4-Flash-Eingabecache von 0,2 Yuan/Million Token auf 0,02 Yuan/Million Token.

DeepSeek-V4-Pro für Benutzer auf Unternehmensebene bietet noch größere Rabatte. Der ursprüngliche Preis von 1 Yuan/Million Token wird für die Cache-Eingabe auf 0,1 Yuan reduziert. Vor dem 5. Mai 2026 wird ein zeitlich begrenztes Sonderangebot mit 25 % Rabatt hinzugefügt, das tatsächlich nur 0,025 Yuan/Million Token beträgt. Die Cache-Miss-Eingabe wird von 12 Yuan auf 3 Yuan und die Ausgabe von 24 Yuan auf 6 Yuan reduziert.

Bildquelle: Offizielle DeepSeek-Website

DeepSeek erwähnte, dass die beiden Modellnamen DeepSeek-Chat und DeepSeek-Reasoner in Zukunft veraltet sein werden. Aus Kompatibilitätsgründen entsprechen die beiden den Nicht-Denk- bzw. Denkmodi von DeepSeek-V4-Flash.

Vergleicht man die Preise vor und nach der Preisanpassung, lässt sich leicht feststellen, dass die Kosten für Hochfrequenzanrufe und Langtextverarbeitungsszenarien um mehr als 90 % gesunken sind. Anwendungen mit hohen Cache-Trefferraten wie RAG-Wissensdatenbanken, intelligenter Kundenservice und Dokumentenanalyse können direkt zu einem drastischen Rückgang der kommerziellen Kosten führen und so dazu beitragen, die Kostenfesseln einer groß angelegten Implementierung von KI zu durchbrechen.

Die deutliche Preissenkung von DeepSeek hängt mit dem technologischen Upgrade von DeepSeek-V4 und der intensiven Zusammenarbeit mit dem Shengteng-Ökosystem zusammen.

Am 24. April wurde die Vorschauversion von DeepSeek-V4 offiziell veröffentlicht. Sowohl die Open-Source-Pro- als auch die Flash-Modelle unterstützen ultralange Kontexte mit 1 Million Token. Die selbst entwickelte Architektur mit geringer Aufmerksamkeit reduziert den Verbrauch an Inferenzrechenleistung erheblich. Die Single-Token-Rechenleistung der Pro-Version beträgt nur 27 % der V3.2, und der KV-Cache wird auf 10 % reduziert, wodurch eine Kostenoptimierung von Grund auf erreicht wird.

Die von DeepSeek angekündigten Parameter zeigen, dass DeepSeek-V4-Pro über 49B Aktivierungsparameter und 33T Vortrainingsdaten verfügt und sich damit als leistungsstarkes Flaggschiff positioniert. DeepSeek-V4-Flash verfügt über 13B Aktivierungsparameter und 32T Vortrainingsdaten, wobei der Schwerpunkt auf hoher Geschwindigkeit und niedrigen Kosten liegt.

Im Vergleich zum Modell der vorherigen Generation sind die Agentenfunktionen von DeepSeek-V4-Pro deutlich verbessert. In der Agentic Coding-Bewertung erreichte V4-Pro das beste Niveau aktueller Open-Source-Modelle und schnitt auch in anderen Agenten-bezogenen Bewertungen gut ab. Es wird berichtet, dass DeepSeek-V4 zum Agenten-Codierungsmodell geworden ist, das von internen DeepSeek-Mitarbeitern verwendet wird. Laut Bewertungsfeedback ist das Nutzungserlebnis besser als bei Sonnet 4.5 und die Lieferqualität kommt dem Nicht-Denkmodus von Claude Opus 4.6 nahe, es gibt jedoch immer noch eine gewisse Lücke zum Denkmodus von Opus 4.6.

In der weltweiten Wissensbewertung liegt DeepSeek-V4-Pro deutlich vor anderen Open-Source-Modellen und ist dem Top-Closed-Source-Modell Gemini-Pro-3.1 leicht unterlegen. Bei der Bewertung von Mathematik, MINT und Wettbewerbscodes übertraf DeepSeek-V4-Pro alle derzeit öffentlich bewerteten Open-Source-Modelle und war mit den weltweit besten Closed-Source-Modellen vergleichbar.

Im Vergleich zu DeepSeek-V4-Pro ist DeepSeek-V4-Flash in Bezug auf die weltweite Wissensreserve etwas schlechter, zeigt aber gute Argumentationsfähigkeiten. Da die Modellparameter und Aktivierungen kleiner sind, kann V4-Flash schnellere und wirtschaftlichere API-Dienste bereitstellen.

DeepSeek-V4 war außerdem Vorreiter bei einem neuen Aufmerksamkeitsmechanismus, der die Token-Dimension komprimiert und mit DSA-Sparse-Aufmerksamkeit (DeepSeek Sparse Attention) kombiniert, um weltweit führende Funktionen für lange Kontexte zu erreichen und den Rechen- und Grafikspeicherbedarf im Vergleich zu herkömmlichen Methoden erheblich zu reduzieren.

Noch bemerkenswerter ist, dass die gesamte Palette der Ascend-Super-Node-Produkte die Modelle der DeepSeek V4-Serie unterstützt. Das bedeutet auch, dass DeepSeek mehr Lokalisierungssignale aussendet.

DeepSeek-V4 erwähnte in einem technischen Bericht: „Das feinkörnige EP-Schema (Expert Parallel) wurde auf zwei Plattformen verifiziert, NVIDIA GPU und Huawei Ascend NPU. Im Vergleich zur leistungsstarken, nicht fusionierten Basislinie erreichte das Schema eine 1,50- bis 1,73-fache Beschleunigung bei allgemeinen Argumentationsaufgaben; in latenzempfindlichen Szenarien (wie der Einführung von Reinforcement Learning (RL) und Hochgeschwindigkeits-Agent-Diensten) kann es eine bis zu 1,96-fache Beschleunigung erreichen.“

DeepSeek betonte, dass der Preis der Pro-Version voraussichtlich erheblich gesenkt werden wird, da die gesamte Palette der Ascend-Superknotenprodukte in der zweiten Jahreshälfte in Chargen auf den Markt kommt.

Nach der Veröffentlichung von DeepSeek-V4 veröffentlichte Goldman Sachs einen Analysebericht, in dem darauf hingewiesen wurde, dass die Kernbedeutung von DeepSeek V4 darin besteht, die Implementierung komplexerer Agentenanwendungen zu geringeren Kosten zu unterstützen und so einen neuen Raum für die Skalierung von KI-Anwendungen zu eröffnen. Was die Einbeziehung von Ascend-Superknoten betrifft, ist Goldman Sachs davon überzeugt, dass die Kostenwettbewerbsfähigkeit von DeepSeek weiter gestärkt wird und die Voraussetzungen für ein breiteres Anwendungsspektrum geschaffen werden. Darüber hinaus wurde der Trend, Chinas Top-KI-Modelle auf inländische Rechenleistung zu migrieren, vor dem Hintergrund der anhaltenden Knappheit bei Chips von führenden Akteuren eindeutig unterstützt.

Der Bericht von Goldman Sachs zitierte auch Nachrichtenberichte, denen zufolge Tencent und Alibaba über eine Investition in DeepSeek mit einem Wert von mehr als 20 Milliarden US-Dollar verhandeln. Die jüngsten Marktwerte von Zhipu und MiniMax liegen bei etwa 53 Milliarden US-Dollar bzw. 31 Milliarden US-Dollar. Diese potenzielle Transaktion spiegelt die Logik des Wettbewerbs der Giganten um knappe KI-Fähigkeiten auf höchstem Niveau wider.

Huatai Securities geht davon aus, dass der Markt V4 leicht als „Kostenreduzierung und geringere Anforderungen an Rechenleistung und Speicher“ interpretiert. Die wichtigere geringfügige Änderung besteht jedoch darin, dass die Verfügbarkeit komplexer Agenten, die Analyse mehrerer Dokumente, langfristige Aufgaben, Online-Lernen und andere Szenarien zunehmen wird, nachdem die Kosten für lange Kontexte gesunken sind und die Anzahl der Inferenzaufrufe und die Häufigkeit des Speicherzugriffs voraussichtlich zunehmen werden.