Die Speicherpreise sind in diesem Jahr um das Drei- bis Fünffache gestiegen, was die Bereitschaft aller, PCs und Mobiltelefone zu konsumieren, stark beeinträchtigt hat. Der Grund für diesen enormen Anstieg der Speicherpreise ist die starke Nachfrage nach KI. Jeder weiß, dass KI sehr hohe Anforderungen an die Kapazität und Bandbreite des Speichers (einschließlich Videospeicher auf GPUs) stellt, aber wie hoch dürfen diese sein? Das vor einigen Tagen von Google veröffentlichte TPU der achten Generation ist das beste Beispiel.

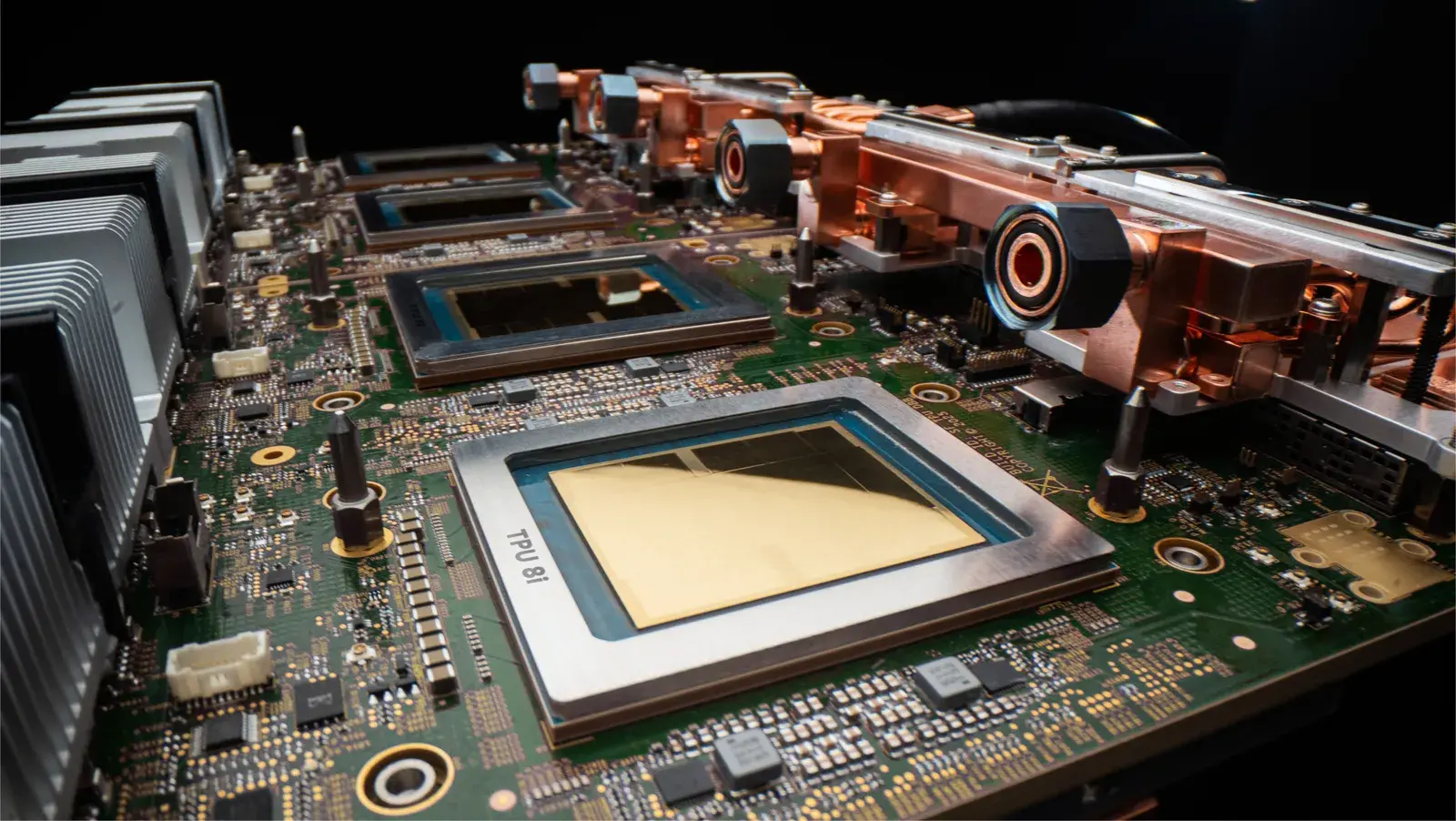

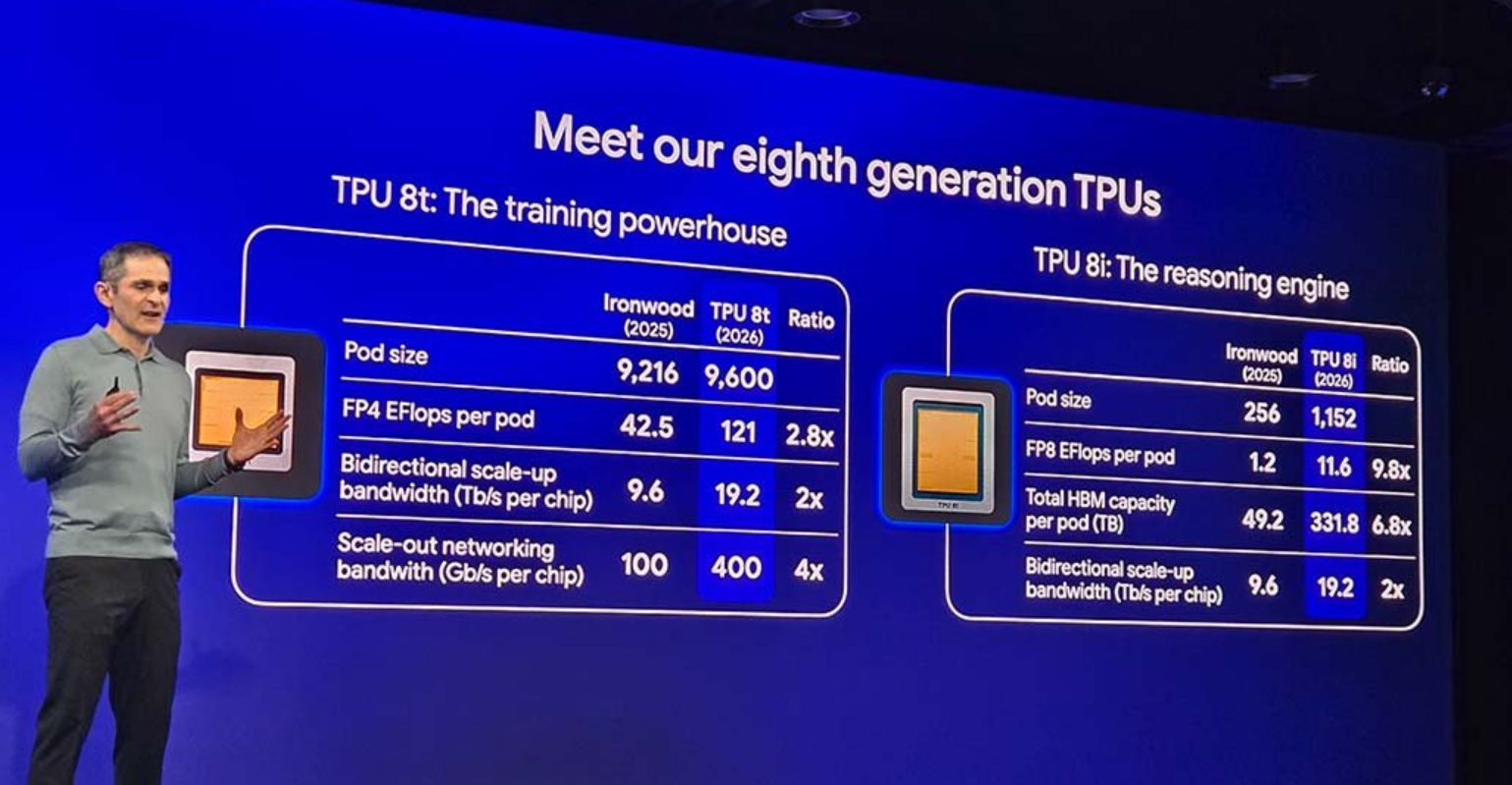

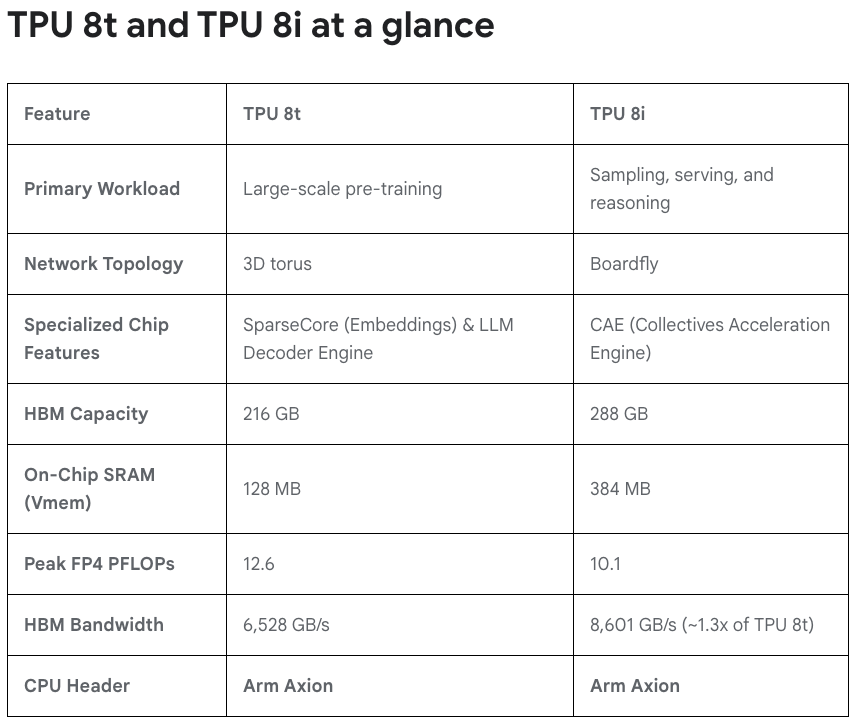

Die diesjährige TPU v8 unterscheidet erstmals zwischen Training und Reasoning. V8T konzentriert sich auf KI-Training. Obwohl Google sagt, dass es auch schlussfolgern kann, wird es hauptsächlich für das Training verwendet.Jeder Pod-Knoten ist mit 9.600 V8T-Chips gestapelt und die FP4-Leistung erreicht 121EFlops.Die Speicherbandbreite beträgt 19,2 TB/s und die interne Chipbandbreite beträgt 400 GB/s, was einer fast zwei- bis vierfachen Änderung entspricht.

V8i zielt hauptsächlich auf KI-Inferenzlasten ab und die Spezifikationen müssen stark reduziert werden. Jeder Knoten verfügt nur über 1152 V8i-Chips, die Rechenleistung wird auf 11,6 EFlops reduziert und die Speicherbandbreite bleibt unverändert bei 19,2 TB/s.

Bemerkenswert ist, dass die Speicherkapazität dieses Mal deutlich zugenommen hat.V8i erreicht außerdem 331,8 TB HBM-Speicher und V8T verfügt über einen übertriebenen 2 PB HBM-Speicher. Jeder V8T-Chip ist mit 216 GB HBM-Speicher ausgestattet.

Das Designkonzept von Google besteht dieses Mal darin, die Speichermauer von KI-Engpässen zu durchbrechen. Der 2PB-HBM bietet nicht nur eine supergroße Gesamtkapazität, sondern wird auch als einzelne globale Adresse innerhalb eines Knotens verwendet. Obwohl die GPU von NVIDIA zuvor mithilfe von Technologien wie NVLink in der Lage war, HBM-Speicher auf PB-Ebene zu stapeln, kann die Verbindung das herkömmliche Rechenzentrumsnetzwerk nicht umgehen, was zu Leistungs- und Latenzengpässen führt.

Larry Carvalho, Chefberater bei RobustCloud, sagte, dass der Durchbruch der „Speichermauer“ eine potenziell große Wettbewerbsveränderung für Google im Bereich der KI-Chips darstellt.

Aber für den Normalbürger ist die Einführung des 2PB-HBM-Speichers durch Google kein gutes Zeichen, denn das bedeutet, dass der Speicherbedarf der KI immer noch steigt.Sie müssen wissen, dass HBM-Speicher normalerweise zwei- bis viermal mehr DRAM-Chip-Produktionskapazität verbraucht als herkömmlicher DDR-Speicher.Je mehr HBM verwendet wird, desto mehr DDR-Speicherkapazität wird belegt.

Selbst wenn die Nachfrage steigt, werden Samsung, SK Hynix, Micron und andere Unternehmen der Sicherstellung der HBM-Nachfrage Vorrang einräumen, haben jedoch zuvor klargestellt, dass sie die Chipproduktionskapazität nicht wesentlich erhöhen werden. Offensichtlich wird sich der Mangel an Speicherchips verschärfen und ein schneller Preisverfall ist nicht zu erwarten.