DeepSeek hat auf GitHub ein multimodales Argumentationsmodell und einen technischen Bericht mit dem Titel „Thinking with Visual Primitives (Thinking with Visual Primitives)“ veröffentlicht. Dieses Modell basiert auf DeepSeek V4-Flash (284B Gesamtparameter, 13B MoE-Architektur während der Inferenz aktiviert) und schlägt ein neues multimodales Argumentationsparadigma vor.

Der Artikel weist darauf hin, dass es einen grundlegenden Engpass in bestehenden multimodalen großen Modellen gibt, der ignoriert wurde: die „Referenzlücke“, das heißt, das Modell kann den Inhalt des Bildes „sehen“, wenn es jedoch natürliche Sprache verwendet, um einen Gedanken aufzubauen Während des Denkprozesses können vage Beschreibungen wie das große rote Objekt auf der linken Seite in der Nähe der Mitte das visuelle Objekt in einer dichten Szene nicht genau lokalisieren, was dazu führt, dass die Aufmerksamkeit abschweift und falsche Schlussfolgerungen gezogen werden.

Früher bestand die gängige Reaktionsrichtung in der akademischen Gemeinschaft darin, die Wahrnehmungsauflösung zu verbessern, aber das Papier geht davon aus, dass das Sehen und die Fähigkeit, klar zu sagen, was gesagt wird, zwei verschiedene Dinge sind.

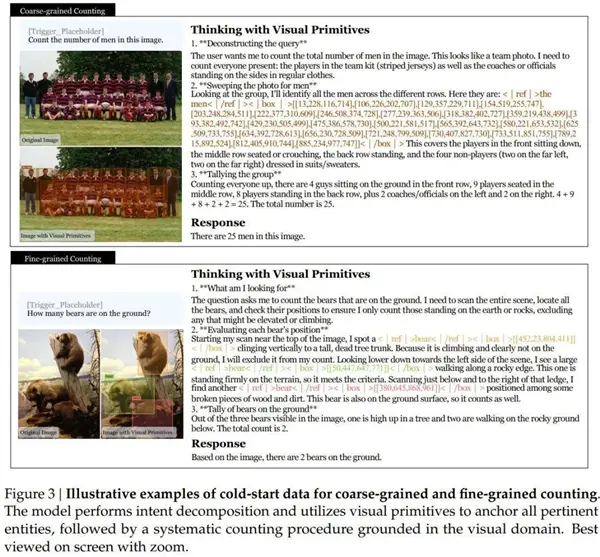

Die Kerninnovation dieses Modells besteht darin, Punktkoordinaten und Begrenzungsrahmen in den Argumentationsprozess selbst einzubetten und sie so zur Grundeinheit der Denkkette zu machen. Jedes Mal, wenn das Modell während der Inferenz ein visuelles Objekt erwähnt, werden seine Koordinaten synchron ausgegeben.

Zum Beispiel: „Finde einen Bären [452, 23, 804, 411], klettere auf einen Baum, schließe ihn aus, schaue dann nach links und finde einen anderen [50, 447, 647, 771], der am Rand des Felsens steht und die Bedingungen erfüllt.“ Koordinaten sind nicht mehr nachträglich markierte Antworten, sondern räumliche Anker, um Unklarheiten während des Argumentationsprozesses zu beseitigen.

Auf architektonischer Ebene erreicht das Modell eine 7056-fache visuelle Komprimierung, ein 756 × 756-Bild. Nach der ViT-Verarbeitung wurden 2916 Bildblock-Token generiert, die zu 324 zusammengeführt wurden Tokens durch räumliche 3×3-Komprimierung. Der KV-Cache wurde durch den Compressed Sparse Attention (CSA)-Mechanismus viermal weiter komprimiert, und schließlich blieben nur noch 81 visuelle KV-Einträge übrig.

Als Referenz: Das gleich große Bild Claude Sonnet 4.6 benötigt etwa 870 Teile und Gemini-3-Flash benötigt etwa 1100 Teile.

In Bezug auf Trainingsdaten hat das Team etwa 31.700 hochwertige Datenquellen aus fast 100.000 Zielerkennungsdatensätzen herausgesucht und mehr als 40 Millionen Trainingsbeispiele generiert, die vier Arten von Aufgaben abdecken: Zählen, räumliches Denken, Labyrinthnavigation und Pfadverfolgung.

Nach dem Training wird zuerst die Fachkompetenz und dann die Vereinheitlichungsstrategie übernommen. Zwei Expertenmodelle, Begrenzungsrahmen und Punktkoordinaten, werden separat trainiert. Nach der Optimierung des Reinforcement Learning werden sie durch Online-Richtliniendestillation zu einem einheitlichen Modell zusammengeführt.

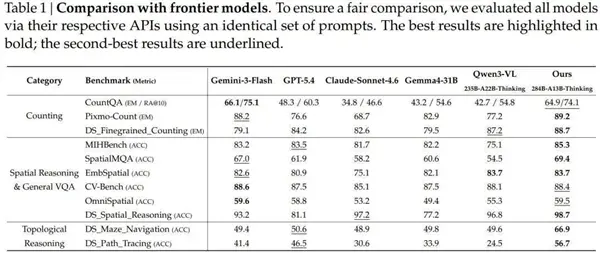

Die experimentellen Ergebnisse wurden in 11 Benchmark-Tests mit Mainstream-Modellen wie Gemini-3-Flash, GPT-5.4 und Claude Sonnet 4.6 verglichen.

Bei der Zählaufgabe beträgt der genaue Matching-Score von Pixmo-Count 89,2 %, übertrifft Gemini-3-Flash mit 88,2 % und liegt deutlich darüber 76,6 % von GPT-5.4 und 68,7 % von Claude von Sonnet 4.6.

Die repräsentativste Lücke zeigt sich im topologischen Denken: Der Labyrinth-Navigations-Score liegt bei 66,9 %, GPT-5,4 bei 50,6 %, Gemini-3-Flash bei 49,4 %, Claude Sonnet 4,6 bei 48,9 %, ein Anstieg von etwa 17 Prozentpunkten; Der Path-Tracking-Score beträgt 56,7 %, GPT-5.4 liegt bei 46,5 %.

Der Artikel weist jedoch auch auf die aktuellen Einschränkungen hin: Das Modell muss Wörter explizit auslösen, um den visuellen Primitivmechanismus zu ermöglichen, die Koordinatengenauigkeit in extrem feinkörnigen Szenen ist begrenzt und es gibt noch Raum für Verbesserungen bei den Fähigkeiten zur szenenübergreifenden Generalisierung.