Der OpenAI-Forscher Chen Boyuan hat einen Artikel über Zhihu gepostet, der sehr direkt beginnt:„Hallo zusammen, ich bin Chen Boyuan, ein Forschungswissenschaftler im GPT-Bildteam. Das letzte Woche veröffentlichte GPT-Bilderzeugungsmodell war mein Haupttraining!“Er erwähnte auch, dass die chinesische Darstellung des Modells dieses Mal endlich korrigiert wurde. Wenn chinesische Benutzer Feedback haben, können Sie direkt darauf antworten.

Nach der Veröffentlichung von ChatGPT Images 2.0 war die erste Reaktion vieler Menschen:Die chinesischen Fähigkeiten dieses Modells sind etwas unvernünftig.

Frühere Bildvorbilder waren etwas „unverständlich“. Sie können Landschaften und Figuren zeichnen, aber sobald chinesische Schriftzeichen im Spiel sind, können sie sich leicht in ein unleserliches Durcheinander geisterhafter Symbole verwandeln. Aber GPT-image-2 ist anders. Es kann nicht nur die richtigen Wörter schreiben, sondern auch chinesische Informationsgrafiken mit einer logischen Struktur setzen, segmentieren und generieren.

Die alte Methode, „den Text anzusehen, um festzustellen, ob er von KI generiert wurde“, funktioniert in dieser Generation nicht mehr.

Chen Boyuan ist einer der Menschen, die beim GPT Image 2-Training und der Fähigkeitsdemonstration wirklich an der Rezeption standen. Auf der Pressekonferenz demonstrierten er und Ultraman die Möglichkeiten zur Textwiedergabe. Nach der Veröffentlichung erklärte er viele Details hinter den offiziellen Website-Bildern auf Zhihu: Während des Doppelblindtests von LMArena verwendete GPT Image 2 „duct-tape“ als Codenamen; viele Bilder auf der offiziellen Blog-Website wurden von ihm mit Models gemacht; Chinesische Comics, Reiskorngravuren, mehrsprachige Texte, visuelle Beweise und automatisch generierte QR-Codes. Diese Bilder, die wie Werbematerialien aussehen, dienen in Wirklichkeit dazu, Fähigkeiten immer wieder auf die Probe zu stellen.

Er hat eine sehr interessante Erklärung für dieses „Klebeband“ verwendet:

„Was den Grund für den Namen „Klebeband“ angeht … natürlich liegt es daran, dass man mit Klebeband Bananen an die Wand kleben kann!“

01

Er stellt eine langsamere Frage

Chen Boyuan ist nicht die Art von Forscher, an die man sich auf den ersten Blick erinnert. Es gibt kein häufiges öffentliches Reden und keine bewusste Steuerung des persönlichen Ausdrucks. Er schreibt Blogs und veröffentlicht unbeschwerte Inhalte, aber diese ähneln eher Rekorden als dem Aufbau von Einfluss.

Im Gegensatz dazu kommt seine Präsenz eher vom Modell selbst.

Heute ist er Forscher bei OpenAI und beschäftigt sich mit dem Training von Bildmodellen. Zuvor absolvierte er am MIT einen Doktortitel in Elektrotechnik und Informatik mit Nebenfach Philosophie. Er beteiligte sich auch an der Erforschung multimodaler Modelle bei Google DeepMind.

Diese Erfahrungen sind schon auffällig genug, aber noch wichtiger sind seine langfristigen Sorgen.

Von DeepMind zu OpenAI hat sich Chen Boyuans Forschungsrichtung kaum verändert. Während die meisten Leute immer noch darüber diskutieren, ob das Modell besser geschrieben und genauer gezeichnet werden kann, geht es ihnen um eine grundlegendere Ebene: darum, was das Modell „versteht“.

Konkret kann man es als drei Fragen betrachten: Wie versteht das Modell das Bild? Welche Beziehung besteht zwischen Bild und Sprache? Wenn ein Modell der realen Welt gegenübersteht, generiert es dann Ergebnisse oder simuliert es die Welt?

Diese Fragen klingen abstrakt, aber sie definieren im Großen und Ganzen die Grenzen der heutigen Modellgeneration.

Auf seiner persönlichen Homepage schreibt er sehr direkt über seine Forschungsrichtung:Weltmodelle, verkörperte Intelligenz und verstärkendes Lernen.

Unter dem sogenannten Weltmodell lässt sich eines verstehen: Es ermöglicht der KI, sich intern ein Urteil über die Welt zu bilden.

Es muss nicht nur wissen, was vor Ihnen passiert, sondern auch vorhersagen können, was als nächstes passieren wird.

Dies unterscheidet sich ein wenig vom heute üblichen LLM (großes Sprachmodell). LLM ähnelt eher der Verarbeitung von Sprache, während das Weltmodell eher einer Struktur ähnelt: Es muss Raum, Zeit, Ursache und Wirkung sowie die Ergebnisse von Verhalten verstehen.

Um ein ganz einfaches Beispiel zu nennen: Wenn KI die Welt wirklich „versteht“, sollte sie wissen, dass ein Plastikbecher abprallt, wenn er auf den Boden fällt, während ein Glasbecher zerbricht.

Embodied Intelligence und Reinforcement Learning können als Erweiterung dieses Problems verstanden werden – wenn ein Modell die Welt wirklich versteht, sollte es nicht nur Fragen beantworten, sondern auch handlungsfähig sein und sein Urteil während der Aktion ständig revidieren.

Die Arbeit, an der er beteiligt ist, ist oft keine einzelne Aufgabenoptimierung, sondern ein Versuch, generative Modelle, visuelles Verständnis und Entscheidungssysteme miteinander zu verbinden.

Eines seiner repräsentativsten Werke ist eine Studie mit dem Titel Diffusion Forcing.

Diese Forschung versucht, eine sehr grundlegende Frage zu lösen: Wird das Modell Schritt für Schritt generiert, oder wird es auf einmal generiert?

LLM ist ersteres und eignet sich gut für die flexible Generierung, ist aber bei langen Inhalten fehleranfällig. Das Diffusionsmodell liegt näher am letzteren, das stabiler ist, aber keine Struktur aufweist.

Der Ansatz von Chen Boyuan besteht darin, diese beiden Methoden in dasselbe Modell zu integrieren, sodass das Modell schrittweise generiert und das Ganze eingeschränkt werden kann.

Wenn es bei Diffusion Forcing um die Vereinheitlichung in der Zeitdimension geht, dann geht es bei SpatialVLM, einer weiteren Arbeit, an der er beteiligt war, um die Ergänzung von Fähigkeiten in der räumlichen Dimension.

Diese Arbeit adressiert ein seit langem bestehendes Problem: Obwohl das Modell Bilder betrachten und sprechen kann, versteht es räumliche Zusammenhänge nicht wirklich. Es kennt weder Entfernung, Größe noch die relative Position von Objekten.

Um dieses Problem zu lösen, baute sein Team ein dreidimensionales räumliches Denksystem auf, damit das Modell nicht nur „sehen“, sondern auch „begründen“ kann.

Ähnliche Ideen sind auch in anderen Arbeiten aufgetaucht, beispielsweise in der History-Guided-Methode, die historische Informationen als Leitfaden für die Generierung verwendet, oder in der Forschung zur einheitlichen Modellierung von Vision, Handeln und Sprache. Diese Bemühungen mögen verstreut erscheinen, aber sie weisen alle in die gleiche Richtung: Das Modell soll nicht nur Ergebnisse ausgeben, sondern intern eine stabile Darstellung bilden.

Neben seiner ernsthaften Forschungsrichtung zeigt Chen Boyuan gelegentlich auch ein sehr lebhaftes persönliches Interesse.

Diesmal hat er beispielsweise einen Artikel über Zhihu veröffentlicht und auf seiner persönlichen Homepage ausdrücklich erklärt, dass sein Interesse an der Herstellung von Boba liegt, und sogar sein Name auf Zhihu ist „MIT Milk Tea Store Manager“.

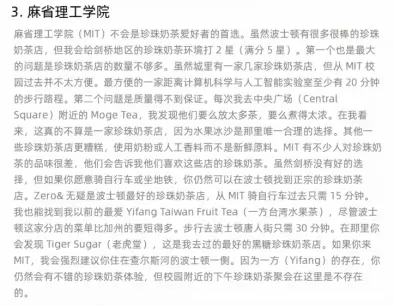

Er schrieb auch einen Blog, um die besten Informatikschulen in den Vereinigten Staaten zu bewerten. Das Kriterium war nicht die Stärke der wissenschaftlichen Forschung, sondern Bubble Milk Tea.

Er stufte Berkeley an erster Stelle ein, weil der Campus „fast von hochwertigen Milchtee-Läden umgeben ist“, während das MIT eine niedrige Punktzahl erhielt, weil „es zu wenige Milchtee-Läden in der Nähe gibt und die Qualität instabil ist“.

Diese Art des Ausdrucks ist sehr entspannt, aber es ist zu erkennen, dass seine Forschungsgewohnheiten darin bestehen, komplexe Probleme zu zerlegen, vergleichbare Dimensionen zu finden und dann Urteile zu fällen.

Seine Arbeit selbst macht etwas Ähnliches, aber das Objekt wird durch ein Modell ersetzt.

02

Er vermied die einfachere Richtung

Betrachtet man nur den Entwicklungspfad von Bildmodellen, ist die Logik der Vergangenheit eigentlich sehr klar: größere Daten, höhere Auflösung und stabilerer Generierungsprozess. Die meisten Verbesserungen konzentrieren sich darauf, „mehr zu zeichnen“.

Doch wenn das Modell beginnt, komplexere Inhalte zu verarbeiten, stößt auch dieser Weg auf einen Engpass: Wenn das Bild nicht nur visuelle Elemente, sondern auch Text, Struktur und sogar logische Zusammenhänge enthält, stellt sich nicht mehr nur die Frage nach Gleichheit oder Unähnlichkeit, sondern auch nach der Frage, wie diese Informationen gleichzeitig hergestellt werden.

Das Problem verlagert sich von der Produktionsqualität hin zur strukturellen Konsistenz.

Nicht alle Forscher werden diese Art von Problem lösen. Es entspricht nicht direkt einem bestimmten Bewertungsindikator und es ist schwierig, ihn kurzfristig in Produkteffekte zu übersetzen. Im Gegensatz dazu sind Verbesserungen oft einfacher zu erkennen, wenn an Auflösung, Stil und Details gearbeitet wird.

Chen Boyuans Weg vermied zufällig diese „einfacheren“ Richtungen: Von Beginn seiner Forschung im akademischen Stadium an lag sein Fokus nicht auf einmodalen Fähigkeiten, sondern darauf, wie verschiedene Fähigkeiten miteinander verbunden sind.

Visuelle Modelle, Sprachmodelle und Entscheidungssysteme haben sich lange Zeit unabhängig voneinander entwickelt. Sie können über Schnittstellen verbunden werden, sind aber intern oft getrennt. Obwohl das Modell „Fähigkeiten abrufen kann“, ist es daher schwierig, ein konsistentes Verständnis zu demonstrieren.

Die Arbeit von Chen Boyuan besteht darin, zu versuchen, diese Situation zu ändern.

Viele der Fähigkeiten des Modells wurden dieses Mal an der Schnittstelle von „Bildern, Text, Memes, realen Objekten und kulturellem Kontext“ demonstriert.

Chen Boyuan sagte, dass viele der Bilder im offiziellen Blog von ihm gemacht wurden. Der gesamte Blog wird aus Bildern erstellt, ohne gewöhnlichen Text. Mit anderen Worten: Viele der Beispiele, die Benutzer auf der offiziellen Website sehen, sind nicht nur Werbematerialien, sondern Teil der Modellfunktionen selbst.

Zum Beispiel dieser chinesische Osterei-Comic.

Er wollte einen sehr lustigen Cartoon machen, also benutzte er „Fangstiel“ und „Bananenstiel“. Um seine Schreibfähigkeiten zu demonstrieren, bat er das Modell speziell, dem Bild Text in mehreren Sprachen hinzuzufügen, und erzeugte außerdem sehr kleine chinesische Zeichen in der unteren rechten Ecke des Heimatstadtplakats, um zu testen, wie fein die Details das Modell verarbeiten konnte.

Noch wichtiger ist, dass dieses Bild nicht gespleißt ist – seiner Meinung nach wird das gesamte Bild, einschließlich Bild-in-Bild und Bild-in-Bild-in-Bild, auf einmal generiert. Er befürchtete, dass die Leute denken könnten, es handele sich um ein zusammengefügtes Bild, deshalb fügte er bewusst einen Hinweis am unteren Rand des Bildes hinzu.

Dies verdeutlicht nur die Schwierigkeit von GPT Image 2. Wenn das Bildmodell der Vergangenheit einige große Zeichen ohne Fehler schreiben könnte, würde es als sehr gut angesehen werden. Aber GPT Image 2 muss sich mit einer ganzen Reihe von Ebenen auseinandersetzen: Es muss wissen, dass es sich um ein Comic-Foto handelt, dass es Bilder im Comic gibt und dass es Bilder in den Bildern gibt; Es muss Text in verschiedenen Sprachen auf verschiedenen Ebenen platziert werden. Außerdem muss die Beziehung zwischen diesen Wörtern und dem Bild hergestellt werden, anstatt sie zufällig im Bild zu verstreuen.

Ein weiteres Beispiel ist die Gravur von Reiskörnern.

Chen Boyuan sagte, dass er zunächst das Gefühl hatte, dass die normale Textwiedergabe nicht beeindruckend genug sei, und so machte er auf Anregung seiner Teamkollegen ein 4K-Bild: Das Bild zeigte einen Stapel Reiskörner, in eines davon waren Wörter eingraviert.

Dadurch wird die Fähigkeit des Modells getestet, Text in extrem kleinen Maßstäben zu steuern.

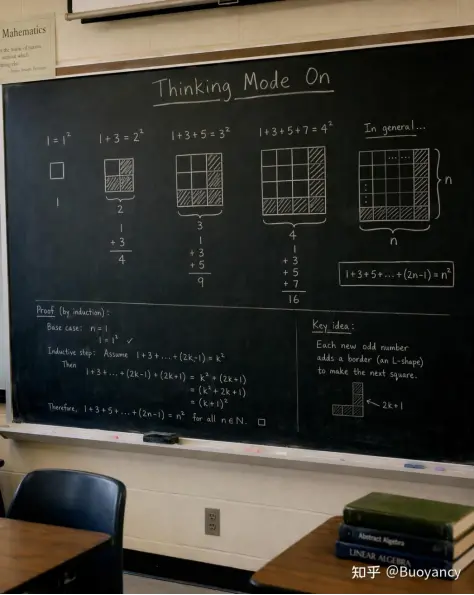

Und dieser visuelle Beweis an der Tafel.

Chen Boyuan sagte: „Es scheint zu einfach zu sein, wenn man ihn bittet, gewöhnliche mathematische Gleichungen und dergleichen zu lösen. Nano Banana scheint dazu in der Lage zu sein, dies durch Denkmodus + Textwiedergabe zu tun. Deshalb habe ich mir einen visuellen Beweis überlegt, den ich sehr mag, um GPT-Bild 2 wirklich zu testen Lösung, aber die grafische Lösung kann nur mit dem visuellen Modell erfolgen.

Dies ist auch eine der bemerkenswertesten Änderungen in der Veröffentlichung von GPT Image 2: Es kann damit beginnen, eine abstrakte Beziehung in eine Bildstruktur umzuwandeln und diese Struktur dann visuell auszudrücken.

Anstatt zu sagen, dass GPT Image 2 „Bilder erzeugt“, ist es daher besser zu sagen, dass es einen visuellen Ausdruck mit Struktur erzeugt.

Comics, Poster, visuelle Beweise ... nichts davon sind reine Bilder. Sie enthalten außerdem Text, Typografie, Hierarchie, Objektbeziehungen, Aufgabenziele und ästhetische Urteile.

Frühere Bildmodelle scheitern hier oft, weil sie Bilder als Pixelergebnisse behandeln. Diese Generation stärkerer Bildmodelle muss Bilder als strukturierten Ausdruck behandeln.

03

er ist nicht allein

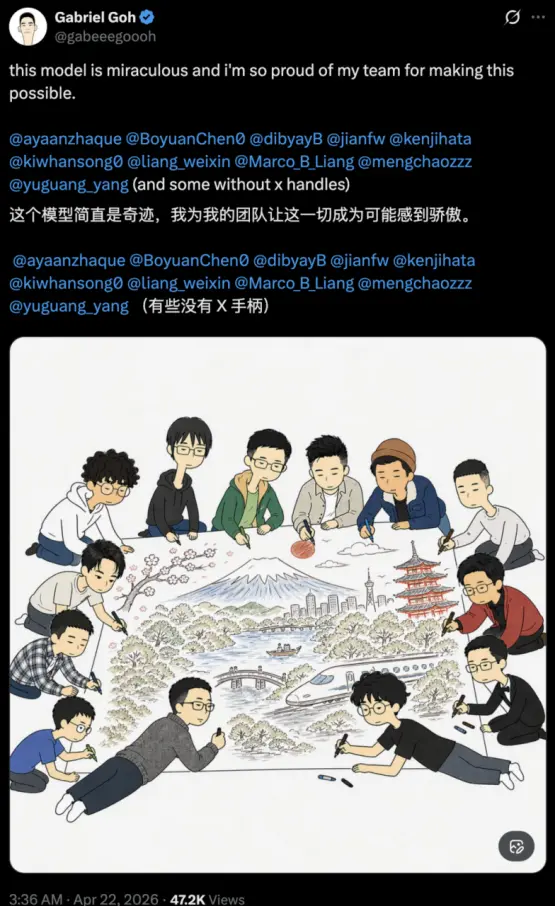

Innerhalb von OpenAI sind nicht viele Personen tatsächlich am Modelltraining beteiligt. Nach der Veröffentlichung von GPT-image-2 bedankte sich Forschungsleiter Gabriel Goh öffentlich in den sozialen Medien bei seinen Teammitgliedern.

Die Liste ist nicht lang, nur ein Dutzend Leute.

Dies ähnelt eher einem kleinen Team als einem großen Engineering-System.

Die Teammitglieder sind in verschiedene Richtungen verstreut, einige kümmern sich um Visionen, einige um Generierungsmechanismen und einige befassen sich mit der Systemstruktur, aber letztendlich geht es ihnen um dasselbe: dem Modell eine Reihe von Fähigkeiten zu geben, die gleichzeitig mit Bildern, Sprache und Struktur umgehen können.

Auch die Illustration im Tweet gleicht gewissermaßen einer Metapher: Eine Gruppe von Menschen kommt zusammen, jeder ist für einen Teil verantwortlich, und am Ende entsteht das gleiche Bild.

Die Struktur des Modells, die Grenzen der Fähigkeiten und sogar „wie das Bild aussehen soll“ werden in einem solchen Team nach und nach festgelegt.

Bemerkenswert ist, dass wir im Kernteam von mehr als einem Dutzend Personen eine beträchtliche Anzahl chinesischer Namen finden.

Neben Chen Boyuan gehören dazu auch Jianfeng Wang, der sich mit der Modellierung visueller Sprache beschäftigt, Weixin Liang, der sich mit Modellbewertung und Datenproblemen befasst, Yuguang Yang, der sich seit langem mit der Bilderzeugung beschäftigt, und viele Forscher, die sich mit Bilderzeugung und Systemschulung befassen.

Chen Boyuan bezeichnete diesen Vorfall nicht als persönlichen Sieg. Am Ende des Zhihu-Artikels dankte er ganz besonders dem gesamten Team. Er sagte, dass jeder viele, viele Dinge getan hat. Am Ende der Pre-Launch-Phase arbeitete er neben der Behebung einiger Kleinigkeiten gemeinsam mit Kollegen aus der Marketingabteilung und Art-Kollegen an der Vorbereitung der Pressekonferenz und der Website.

Mit anderen Worten: GPT Image 2 ist eine gemeinsame Vollendung von Forschung, Produkten, Ästhetik und Kommunikation. Das Modellteam muss die Fähigkeiten schaffen, das Kunstteam muss wissen, welche Art von Bildern die Fähigkeiten darstellen können, und das Marketingteam muss diese Fähigkeiten in Bilder übersetzen, die normale Benutzer verstehen, zum Testen bereit sind und bereit sind, sie zu verbreiten.

Deshalb sind viele Beispiele in dieser Veröffentlichung besonders. Am Ende erzeugen sie nicht nur ein schönes Bild, sondern schaffen aktiv Probleme: mehrere Sprachen, sehr kleiner Text, Bild-in-Bild, reale Objekte, visuelle Beweise, durch die Suche generierte Poster und die Einbettung von QR-Codes.

Jedes Bild sagt dem Benutzer: Was Sie vorher dachten, das Bildmodell könnte es nicht, das können Sie jetzt noch einmal versuchen.

Aus dieser Perspektive ist die Position von Chen Boyuan etwas ganz Besonderes.

Er ist sowohl auf der Seite des Modelltrainings als auch auf der Seite der verlegerischen Erzählung tätig; Er beteiligte sich nicht nur an der Herstellung des Modells, sondern entwarf auch persönlich viele Bilder, um der Außenwelt die Fähigkeiten des Modells verständlich zu machen.

GPT Image 2 ist sicherlich nicht das Werk von Chen Boyuan allein, aber den öffentlichen Informationen nach zu urteilen, ist Chen Boyuan tatsächlich einer der Namen, die in dieser Bildmodellveröffentlichung die größte Aufmerksamkeit der chinesischen Community verdienen.

Einerseits war das dieses Mal veröffentlichte GPT-Graph-Generierungsmodell seine Hauptausbildung; Andererseits war er für einen Durchbruch verantwortlich, der von chinesischen Benutzern am leichtesten wahrgenommen wird: das chinesische Rendering.

Als die KI endlich in der Lage war, Chinesisch in komplexe Bilder zu schreiben, rückte der Forscher dahinter in den Vordergrund, der sich seit langem mit Weltmodellen, räumlichem Verständnis und generativer Konsistenz beschäftigt hatte.

„Hoffentlich haben wir dieses Mal alle sicher erwischt“, sagte er.