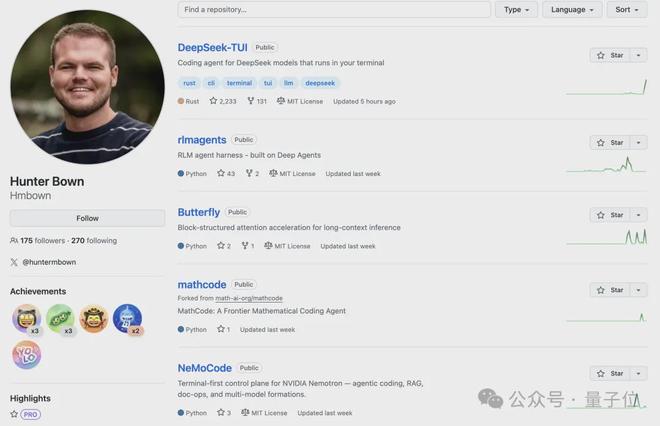

DeepSeek verfügt außerdem über einen eigenen exklusiven Codierungsagenten. Der Name ist einfach und grob, heißt einfach DeepSeek-TUI. Der Autor nennt sich selbst einen DeepSeek-Enthusiasten, der ein „Bruder der Wale“ ist. Gerade jetzt begann die Anzahl der Sterne für dieses Projekt plötzlich stark zu steigen und erreichte 2,3.000, und es erschien auch auf der GitHub-Hotlist.

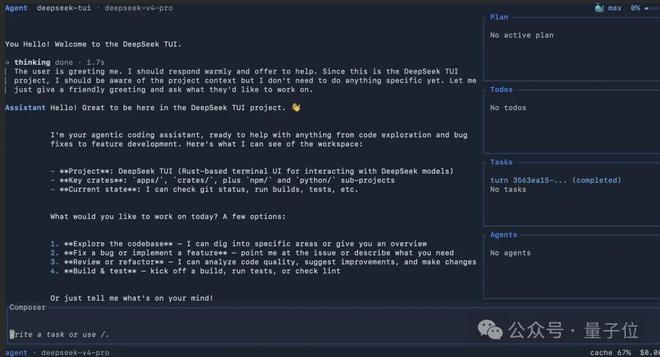

Dies ist ein in der Rust-Sprache geschriebenes TUI-Programmiertool. Es läuft im Terminal wie Claude Code, ist jedoch speziell für DeepSeek optimiert und angepasst.

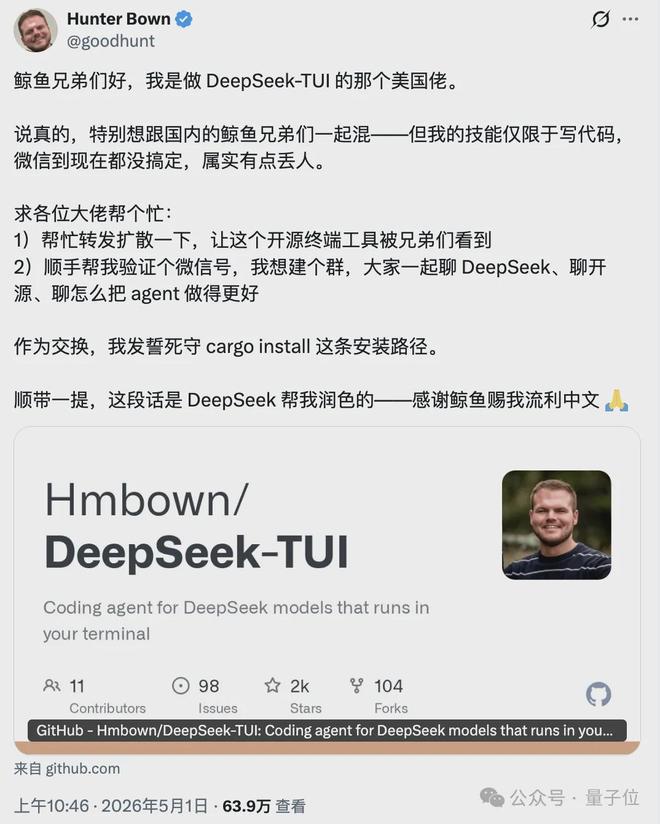

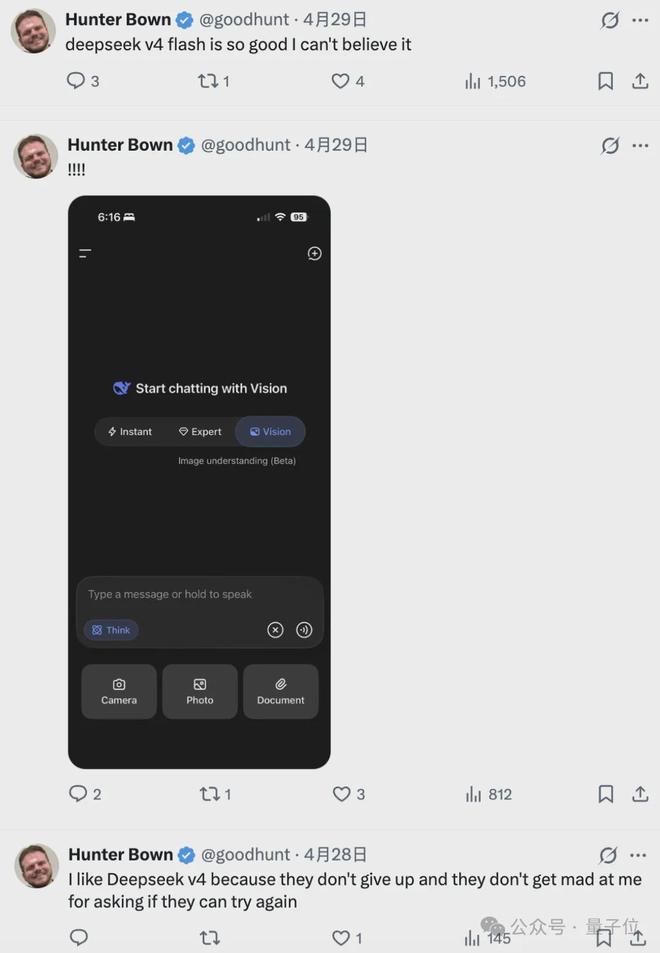

Um seine Arbeit bei inländischen Internetnutzern bekannt zu machen, nutzte der Autor Hunter Bown DeepSeek auch speziell, um die Werbe-Tweets ins Chinesische zu übersetzen.

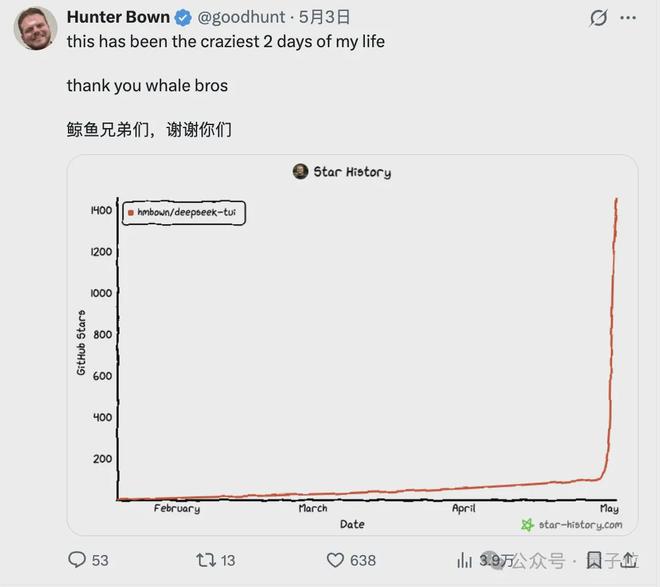

Als DeepSeek – After TUI wie gewünscht auf GitHub populär wurde, veröffentlichte Hunter ein Bild und sagte unverblümt, dass dies die verrücktesten zwei Tage seines Lebens seien, und drückte seinen Dank gegenüber den „Walbrüdern“ aus Chinesisch.

„DeepSeek Edition Claude Code“

DeepSeek-TUI ist ein Programmieragent, der im Terminal lebt. Um es einfacher zu verstehen: Es handelt sich um die „DeepSeek-Version von Claude Code“.

Es wurde im Januar dieses Jahres vom amerikanischen unabhängigen Entwickler Hunter Bown initiiert. Es ist in der Sprache Rust geschrieben und steht unter der MIT-Lizenz als Open Source. Bis zur Veröffentlichung von DeepSeek-V4 und der chinesischen Werbung von Hunter war es jedoch verhalten. Dieses Projekt begann während dieses Maifeiertags zu explodieren.

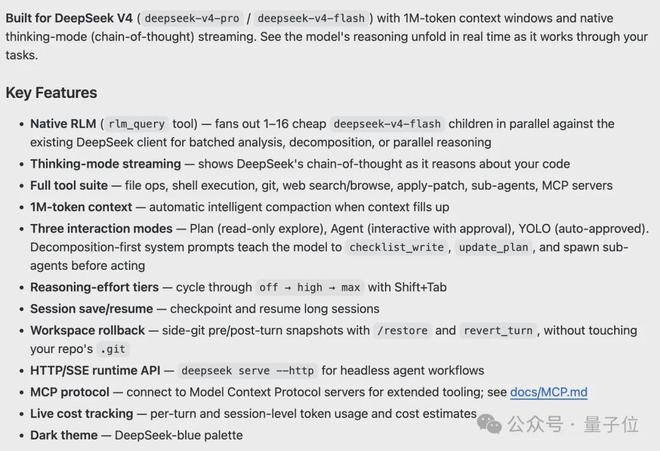

Zum Beispiel Dateien lesen und schreiben, Shell ausführen, Webseiten durchsuchen, Git verwalten, Subagenten planen, Verbindung zu MCP-Servern herstellen ... diese Claude Es kann im Grunde alles, was Code kann, und es unterstützt auch die Installation von Fähigkeiten, aber es nutzt DeepSeek V4, um dahinter zu laufen.

Das gesamte Tool, von der Designlogik bis zu den funktionalen Details, dreht sich um die Funktionen von DeepSeek.

Die direkteste ist die Denkkette.

DeepSeek-TUI streamt den Argumentationsprozess des Modells direkt an das Terminal – wie das Modell das Problem analysiert hat, welchen Weg es eingeschlagen hat und ob es auf halbem Weg seine Meinung geändert hat, alles ist in Echtzeit sichtbar.

Dann gibt es noch den Kontext. V4 unterstützt ein Kontextfenster von 1 Million Token, das vom Projekt standardmäßig vollständig genutzt wird. Sie müssen sich keine Sorgen über Speicherlücken machen, wenn Sie komplexe Aufgaben von Anfang bis Ende ausführen.

Wenn der Kontext fast voll ist, komprimiert TUI den Inhalt automatisch, oder er kann manuell ausgelöst/komprimiert werden.

Die Komprimierungsstrategie berücksichtigt insbesondere den Präfix-Caching-Mechanismus von DeepSeek – versuchen Sie, den vorherigen stabilen Teil beizubehalten, damit der Cache weiterhin zugreifen kann.

Dieses TUI hat auch ein Design namens RLM, und die Idee ist „sehr DeepSeek“ – da DeepSeek billig genug ist, um in großen Mengen verwendet zu werden, nutzt dieses Tool diese Funktion direkt.

Im RLM-Modus leitet ein Hauptmodell bis zu 16 V4-Flash-Unteraufgaben zur gleichzeitigen Ausführung zur Stapelanalyse oder Aufgabenzerlegung an. Der Ausgabepreis von Flash beträgt etwa ein Drittel des Preises von Pro. Durch die Zuteilung von Unteraufgaben, die keiner starken Begründung bedürfen, können die Gesamtkosten erheblich gesenkt werden.

Der Modellwechsel wurde ebenfalls speziell behandelt. Zusätzlich zur offiziellen DeepSeek-API werden auch NVIDIA NIM, Fireworks und selbst gehostete SGLang-Pfade unterstützt.

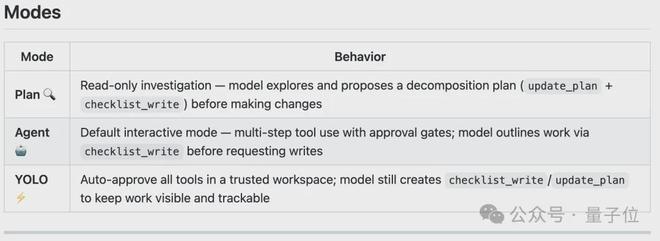

Es gibt drei Betriebsmodi:

Plan ist eine schreibgeschützte Erkundung, ich werde Ihnen zuerst einen Plan geben;

Agent ist die Standarddatei und jeder Tool-Aufruf erfordert ein Nicken;

YOLO ist, wie der Name schon sagt, vollautomatisch, also öffnen Sie es einfach, wenn Sie nicht unterbrochen werden möchten. Sitzungen können gespeichert und wiederhergestellt werden, und der Arbeitsbereich verfügt über einen unabhängigen Git-Snapshot. Das Zurückrollen in Runden hat keine Auswirkungen auf das ursprüngliche Lagerhaus, Sie geraten also nicht in Panik, wenn es umkippt.

Allerdings ist zu beachten, dass es schwierig ist, die Cache-Trefferquote zu garantieren, wenn zu viele Subagenten geöffnet werden.

Sie sollten wissen, dass der Preis eines verpassten Tokens zehnmal so hoch ist wie der eines Treffers. Auf der Projektoberfläche gibt es eine runde Kostenanzeige. Es wird empfohlen, darauf zu achten, wenn Sie eine lange Sitzung durchführen, und sich nicht wundern, wenn die Rechnung fertig ist.

Installation, Linux, macOS und Windows verfügen über vorkompilierte Binärdateien, nur npm install -g deepseek-tui kann mit einem Befehl durchgeführt werden.

Darüber hinaus hat der Autor auch eine spezielle chinesische Version des README-Dokuments und einen speziellen Konfigurationspfad für inländische Benutzer vorbereitet, der die TUNA Cargo-Spiegelung unterstützt. Das Release-Paket kann auch auf Alibaba Cloud OSS oder Tencent Cloud COS gehostet werden. Das Projekt

wurde am 19. Januar gegründet. Es ist weniger als 4 Monate her, seit es auf v0.8.8 iteriert wurde und 37 Versionen veröffentlicht wurden. Das Tempo ist nicht langsam.

Den Aktualisierungsdatensätzen nach zu urteilen, ist es grob in mehrere Phasen unterteilt.

Die frühe Version baute hauptsächlich den Skeleton-Tool-Aufruf, die Sitzungsverwaltung und grundlegende Git-Snapshots auf. Die Inbetriebnahme des Agenten hat oberste Priorität. In der Phase

v0.7.x begann man mit der Verfeinerung der Details und fügte mehrsprachige Schnittstellenunterstützung (v0.7.6), TUI-Eingabeaufforderungen, Hilfetext und Statusleisten in Chinesisch und anderen Sprachen hinzu. Dies ist auch ein Schritt zur Anpassung an inländische Benutzer.

v0.8.x ist die Hauptspindel neuerer Versionen und konzentriert sich auf Stabilität und Erfahrung beim Polieren.

v0.8.2 behebt speziell Datei-Handle-Lecks in langen Sitzungen Leckproblem;

v0.8.6/v0.8.7 up Eine Reihe interaktiver Funktionen wurden hinzugefügt, darunter die Anzeige von Countdown-Wiederholungsbannern, wenn aktuelle Begrenzungen oder Serverfehler gemeldet werden, die Suche nach dem Eingabeverlauf und die Ausführung der Visualisierung der Nachrichtenwarteschlange;

v0.8.8 hat auf dieser Basis eine Abschlussrunde durchgeführt und gleichzeitig vorkompilierte Linux ARM64-Binärdateien hinzugefügt.

Wenn man den Gesamtrhythmus betrachtet, weist dieser Iterationspfad intensive Funktionsaktualisierungen auf, aber jede Version weist grundsätzlich klare Probleme auf, die gelöst werden müssen.

„Musiker, der die Wissenschaft liebt“

Tatsächlich war Hunter schon immer ein begeisterter Fan von DeepSeek. Seit der Veröffentlichung von V4 hat er viele Tweets verschickt, in denen er es lobte.

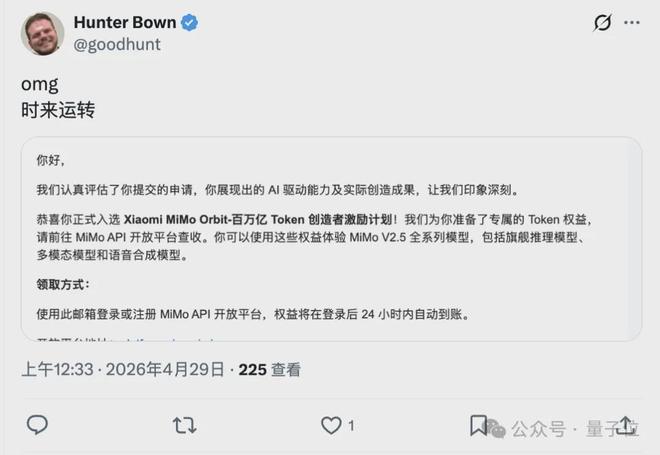

Gleichzeitig mag er auch andere chinesische Modelle und hat am One Billion Token Creator Incentive-Programm von Xiaomi teilgenommen.

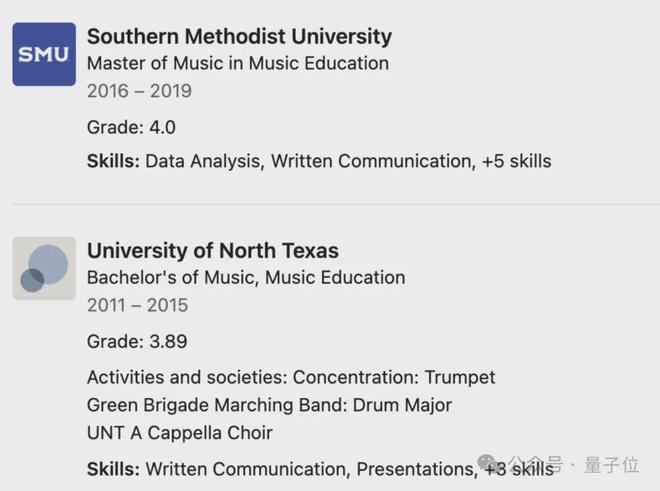

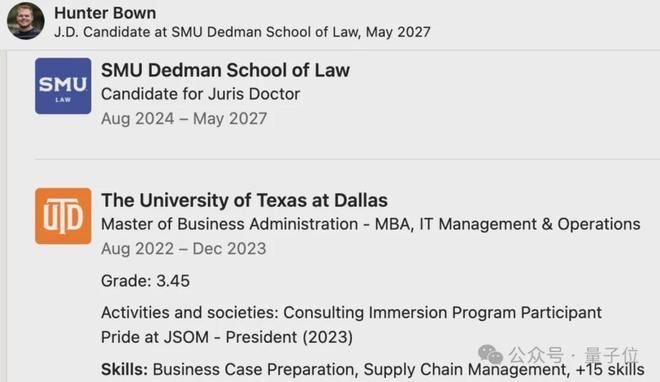

Hunter Bowns Ausgangspunkt war eigentlich die Musik. Einst strebte er danach, Kapellmeister zu werden.

Er studierte zunächst Musikpädagogik an der University of North Texas. Nach seinem Abschluss setzte er seine Ausbildung fort und erwarb einen Master-Abschluss in Musikpädagogik an der Southern Methodist University.

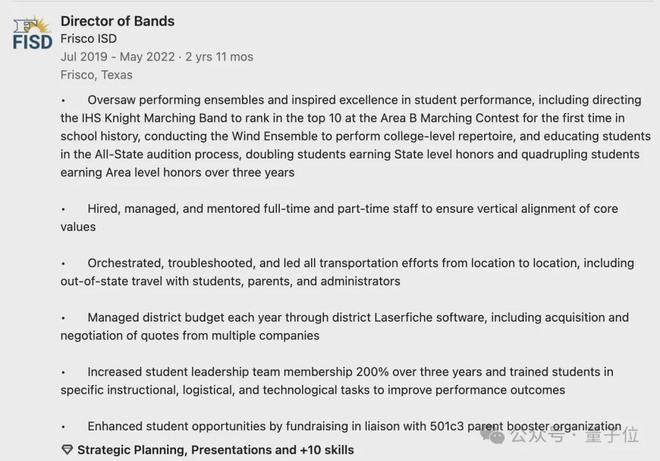

Nach seinem Masterabschluss arbeitete Hunter drei Jahre lang als Banddirigent, wie er es sich gewünscht hatte.

Später erwarb er einen MBA an der University of Texas in Dallas, kehrte dann an seine frühere Alma Mater, SMU, zurück und begann die juristische Fakultät mit Spezialisierung auf Patentrecht.

Was die Codierung betrifft, ist es noch eher eine „Midway-Mönch“-Wahl.

Aber diese „Halbzeit“ ist keine berufliche Veränderung, sondern eher so, als ob mehrere Linien endlich zusammenkommen.

Als er Gesangsmusikwissenschaft studierte, stieß er auf ein Konzept namens „fehlende Grundtöne“ – das menschliche Ohr kann aus Obertönen eine Tonhöhe rekonstruieren, die physisch nicht existiert.

Später entdeckte er, dass dies direkt der Informationstheorie entspricht. Sie müssen nicht alle Informationen explizit angeben, das System vervollständigt diese selbst.

Diese Intuition aus der Musik wurde für ihn zum Schlüssel zum Verständnis des KI-Systems.

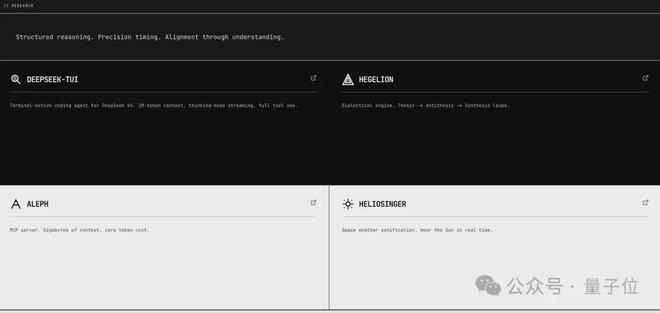

Letztes Jahr gründete er für sich selbst ein Studio namens Shannon Labs, das als „das nächste Bell Labs in der AGI-Ära“ positioniert ist.

DeepSeek-TUI ist für ihn nur eines von vielen Forschungsprojekten. Auf seinem GitHub gibt es 65 öffentliche Repositories, darunter den gleichen Terminal-Agenten NeMoCode für NVIDIA Nemotron sowie das MLX-Kernel-Toolkit und so weiter.

Die Projekte unter Shannon Labs haben eine größere Spanne.

Hegelion ist eine dialektische Denkmaschine, die wandelt. Es ist die zirkuläre Logik von „These → Antithese → Synthese“;

Al eph ist ein MCP-Server, der sich auf Kontext mit hoher Kapazität und null Token-Kosten konzentriert;

Heliosinger wandelt Sonnenwinddaten in Echtzeit in Schall um, von der KI-Infrastruktur bis zur Weltraumakustik.

Außerdem baute er drei Software-Architekturen (SCU, Driftlock, Hegelion) und eine Hardware-Lösung (Driftlock Choir), seiner Ansicht nach sind dies zusammengestellt, um die Infrastruktur für die AGI-Ära aufzubauen.

kann diese Anweisungen zusammenstellen, und sie hängen auch mit seiner Familiengeschichte zusammen.

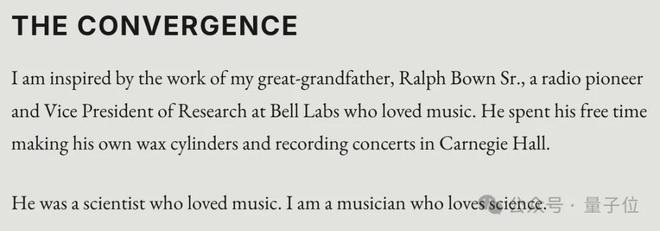

Sein Urgroßvater, Ralph Bown Sr., war Vizepräsident für Forschung bei Bell Labs und Radiopionier. In seiner Freizeit fertigte er gerne selbstgemachte Wachszylinder an und ging in die Carnegie Hall, um Aufnahmen zu machen.

Hunter erkannte im Patentrechtsunterricht, dass er sich auf einer Reise befand. Ein Weg, der sich mit diesem Vorfahren kreuzt –

bringt die Wahrnehmungsweise des Musikers in die technische Forschung, um diese zu entdecken „Ideen, die ignoriert wurden, weil Forscher diesen Hintergrund nicht hatten“.

Auf seiner persönlichen Website verglich er sich mit seinem Urgroßvater: „Er ist Wissenschaftler und liebt Musik; ich bin Musiker und liebe Wissenschaft.“

One More Thing

In der Mitwirkendenliste von DeepSeek-TUI können wir auch einige bekannte Schatten sehen.

Es umfasst eine Reihe von KI-Modellen wie Claude, Gemini und Qwen sowie Programmiertools wie Cursor und GitHub Copilot.

Detaillierte Aufzeichnungen zeigen, dass der Großteil des Codes direkt von Hunter übermittelt wurde und mehr als 150 Commits von Claude vorgenommen wurden. Darüber hinaus haben einige echte Mitwirkende eine kleine Anzahl von Commits eingereicht.

Ein Programmierer, der unterwegs Mönch wurde, nutzt KI-gestützte Programmierung, um ein Hilfsprogrammierungs-Framework für KI zu schreiben. Auch dieser Workflow ist ein Closed-Loop-Workflow (manueller Dog-Head).

GitHub-Adresse:

https://github.com/Hmbown/DeepSeek-TUI