Bei einer speziellen Android-Veranstaltung am Vorabend der diesjährigen I/O-Entwicklerkonferenz konzentrierte sich Google erneut auf sein eigenes Allzweck-Großmodell Gemini und kündigte eine Reihe neuer Funktionen an, die Ihnen dabei helfen sollen, Ihr Telefon zu steuern. Diese Funktionen werden im Chrome-Browser, beim automatischen Ausfüllen von Formularen und in weiteren Anwendungsszenarien angezeigt.

Google hat außerdem einen neuen Konzeptnamen eingeführt – „Gemini Intelligence“. Laut Ben Greenwood, Google Android Experience Director, steht dieser Name für „die Veröffentlichung der besten Funktionen von Gemini auf den fortschrittlichsten Android-Geräten“. Es handelt sich im Wesentlichen um eine gebündelte Integration vorhandener und neuer Funktionen und ist hauptsächlich auf High-End-Flaggschiffmodelle wie das Galaxy S26 ausgerichtet und bildet einen Funktionsumfang, der einem „erweiterten Android-Erlebnis“ ähnelt.

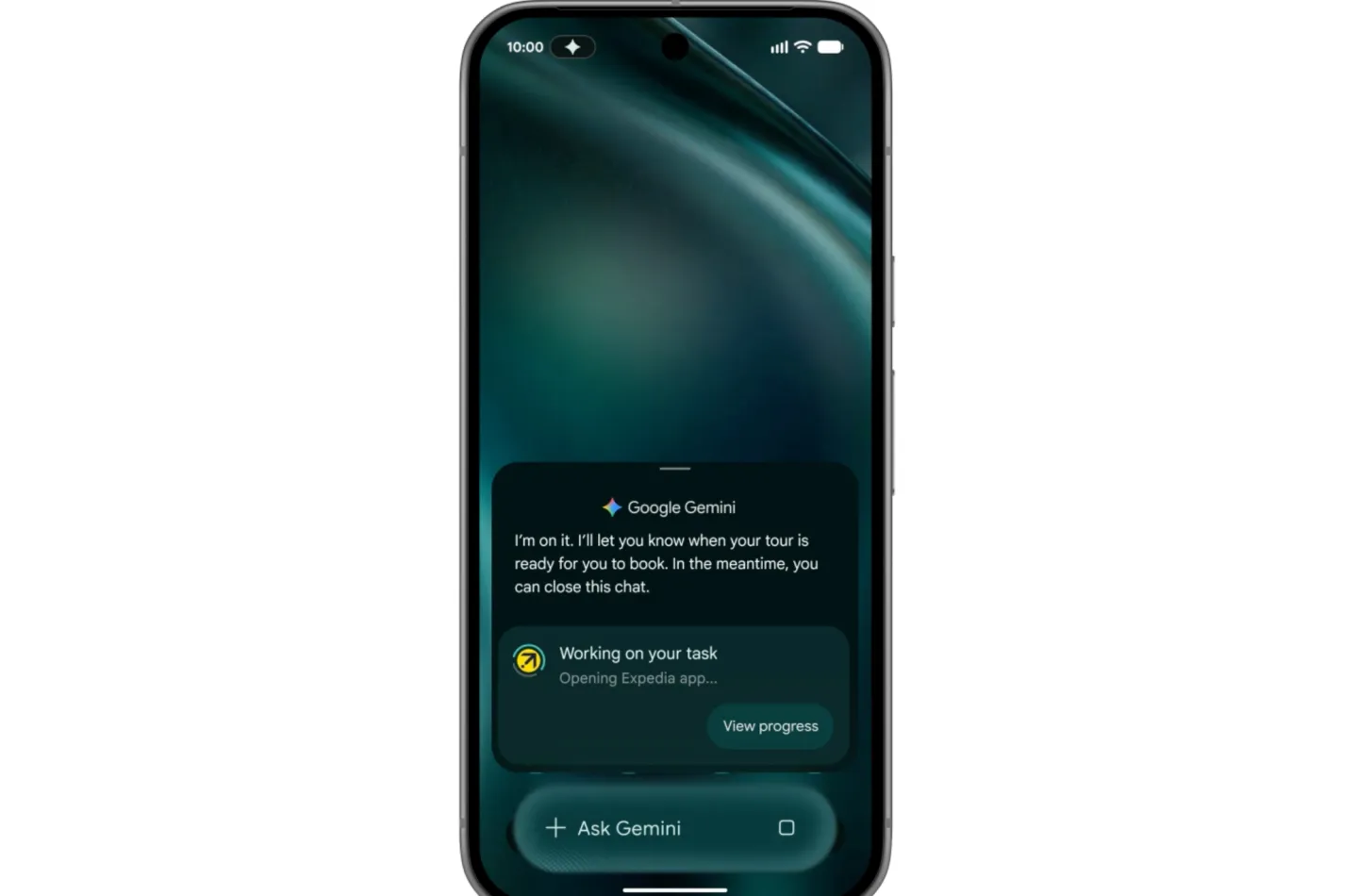

Das Herzstück dieser Sammlung sind Aufgabenautomatisierungsfunktionen, die zuvor auf einigen neuen Pixel- und Samsung Galaxy-Telefonen getestet wurden. Mit dieser Funktion können Gemini bestimmte Anwendungen direkt auf dem Telefon bedienen. Zuvor unterstützte es hauptsächlich einige Apps wie Ride-Hailing und Essenslieferungen. Jetzt hat Google angekündigt, dass es „bald“ für ein breiteres Anwendungsökosystem geöffnet wird. Darüber hinaus wird auch die Aufgabenautomatisierung von der Unterstützung nur von Sprach- und Textbefehlen auf multimodale Eingaben umgestellt. Benutzer können durch Screenshots oder Fotos Aktionen auslösen. Geben Sie Gemini beispielsweise einen Screenshot einer Einkaufsliste in der Notizanwendung und es fügt automatisch einen Warenkorb zur E-Commerce- oder Lebensmitteleinkaufsplattform hinzu – vorausgesetzt, das Gerät selbst unterstützt Gemini Intelligence.

Unter Gemini Intelligence kündigte Google zudem erstmals eine neue Funktion namens „Create My Widget“ an, die offiziell als erster Schritt in Richtung „generative UI“ gilt. Benutzer müssen lediglich die gewünschten Widget-Funktionen in natürlicher Sprache beschreiben, und Gemini generiert automatisch die entsprechenden Desktop-Komponenten. Beispiele von Google sind die Anpassung einer Wetterkomponente, die Windgeschwindigkeit und Niederschlagswahrscheinlichkeit für Radsportbegeisterte hervorhebt, oder eine Rezeptkomponente, die jede Woche automatisch „drei Rezepte für die Zubereitung proteinreicher Mahlzeiten“ empfiehlt. Nach der Generierung werden diese Komponenten nicht nur auf dem Desktop des Mobiltelefons angezeigt, sondern auch gleichzeitig auf Wear OS-Smartwatches ausgeweitet, wodurch ein einheitliches Erlebnis auf allen Geräten entsteht.

Aus Sicht des Interaktionskonzepts hofft Google, dass Benutzer Komponenten als „Minianwendungen betrachten, die mithilfe von KI einfach auf dem Desktop geschrieben werden können“ und so die Entwicklung von Schnittstellenformen hin zu sofortiger Generierung und On-Demand-Änderungen fördern. Die Branche achtet auch darauf, ob Google auf der I/O-Konferenz den langfristigen Weg der „generativen Benutzeroberfläche“ weiter erläutern wird: ob es eine wirklich sofortige Rekonstruktion der Benutzeroberfläche entsprechend der Szene ermöglicht oder ob es sich eher um einen personalisierten Versuch auf Komponentenebene handelt.

Zusätzlich zu den Funktionen auf Systemebene hat Google auch einige der Desktop-Funktionen von Gemini auf die Android-Version des Chrome-Browsers verlagert. Zukünftig wird Nutzern in Chrome eine eigenständige Gemini-Schaltfläche angezeigt, mit der sie den aktuellen Webseiteninhalt direkt mit Gemini teilen und im Browser Fragen stellen oder eine Zusammenfassung der Seiteninformationen generieren können. Für Nutzer, die den Google AI Pro- oder Ultra-Plan abonnieren, bietet Chrome auch „Auto Browse“ zur Unterstützung bei der Erledigung von Aufgaben, wie etwa dem automatischen Wechseln zwischen Websites, dem Ausfüllen von Informationen und dem Erledigen von Terminen. Diese Funktion wird voraussichtlich Ende Juni schrittweise eingeführt.

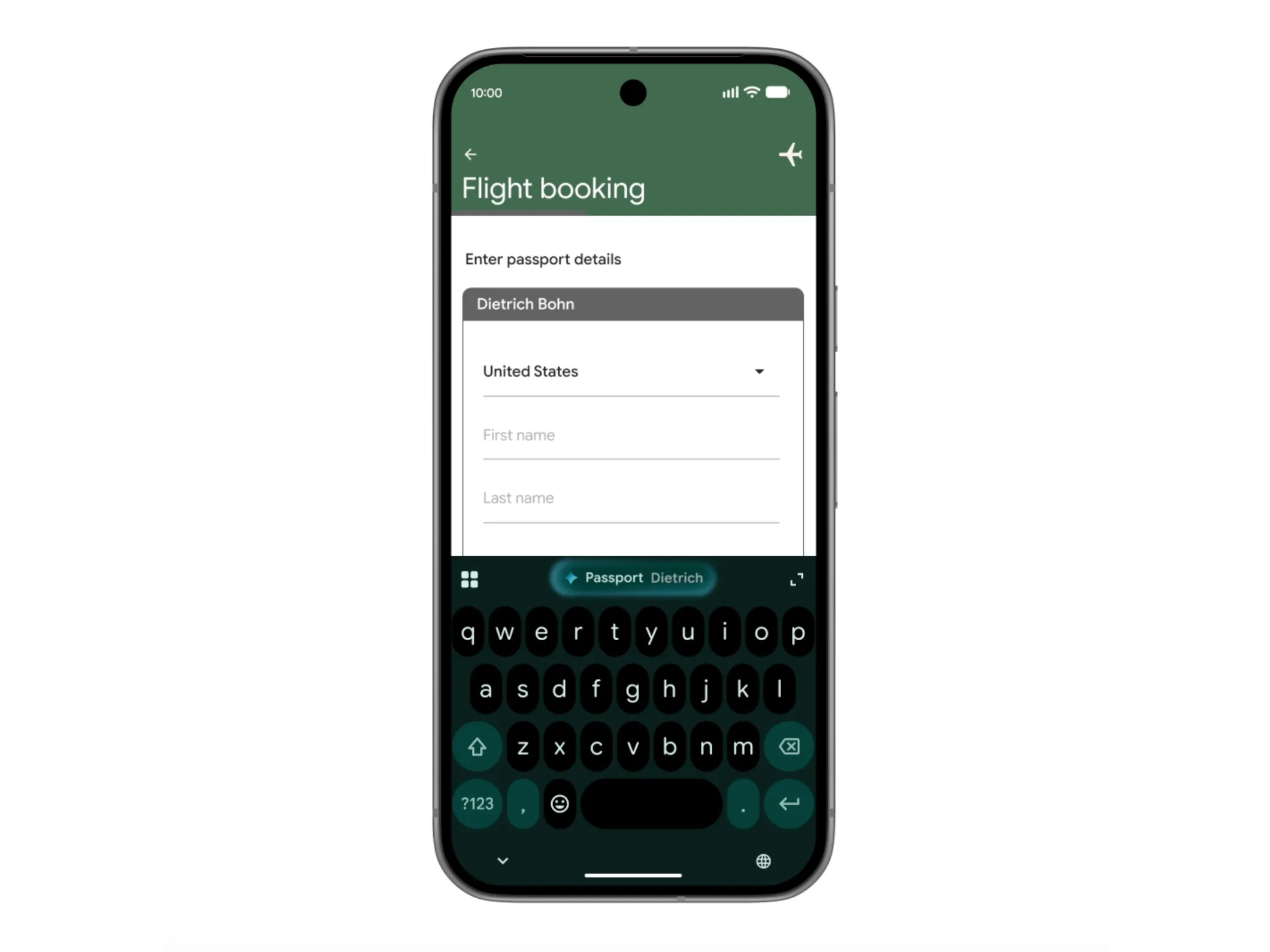

Im Hinblick auf einen weiteren wichtigen Zugang zur Systemebene – das automatische Ausfüllen von Formularen – wird Gemini auch „bedingt“ tiefer eingreifen. Laut Google können Benutzer Gemini mit der Autofill-Funktion von Android verbinden, um beim Ausfüllen verschiedener Formulare zu helfen. Dazu wird Gemini über seine sogenannte „Personal Intelligence“-Schnittstelle relevante Informationen aus personenbezogenen Datenquellen wie Google Fotos und Gmail mit Berechtigung abrufen, etwa zum automatischen Erkennen von Kfz-Kennzeichen auf Fotos und zum Ausfüllen von Formularen. Einerseits hat dieser Ansatz die Effizienz des Ausfüllens erheblich verbessert. Andererseits hat er auch eine neue Diskussion über die Grenze zwischen Privatsphäre und Bequemlichkeit ausgelöst – ob es „extrem rücksichtsvoll“ oder „etwas seltsam“ ist, bleibt dem Urteil des Benutzers überlassen.

Nach dem Plan von Google sollen in diesem Jahr verschiedene Funktionen von Gemini Intelligence „in Chargen und je nach Reifegrad“ eingeführt werden. Die ersten Push-Objekte werden weiterhin High-End-Android-Modelle wie Samsung Galaxy und Google Pixel sein, und es wird erwartet, dass sie ab diesem Sommer Updates erhalten.