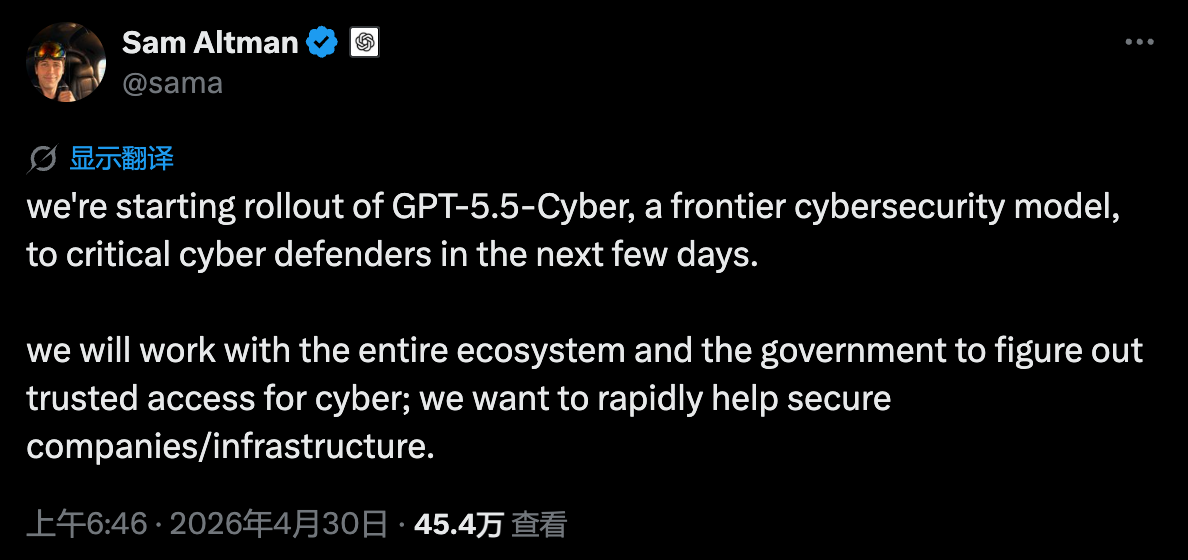

OpenAI bereitet die Einführung eines neuen hochmodernen Netzwerksicherheitsmodells GPT-5.5-Cyber vor. Der CEO des Unternehmens, Sam Altman, sagte, dass dieses Modell nicht der Öffentlichkeit zugänglich sein wird, sondern zunächst einer Gruppe überprüfter und vertrauenswürdiger „Cyber-Verteidiger“ zur Verfügung gestellt wird, um relevanten Institutionen dabei zu helfen, ihre eigenen Fähigkeiten zum Schutz der Netzwerksicherheit zu stärken.

Laut Altman auf Platform Gleichzeitig wird OpenAI auch mit dem gesamten Branchenökosystem und der US-Regierung zusammenarbeiten, um zu untersuchen, wie ein Mechanismus für den „vertrauenswürdigen Zugriff“ für den Bereich der Netzwerksicherheit eingerichtet werden kann.

Derzeit hat OpenAI noch nicht den ersten Stapel spezifischer Objekte spezifiziert, um Nutzungsrechte zu erhalten. Geht man jedoch von dem zuvor eingeführten „Trusted Access“-Programm des Unternehmens aus, gelten entsprechende Vereinbarungen in der Regel nur für geprüfte Fachkräfte und Institutionen. Zu den technischen Details, Leistungsgrenzen und spezifischen Spezifikationen von GPT-5.5-Cyber selbst hat OpenAI vorerst keine weiteren Informationen veröffentlicht.

Dem Namen nach zu urteilen dürfte es sich bei GPT-5.5-Cyber um eine spezialisierte Version des kürzlich veröffentlichten GPT-5.5 handeln. OpenAI hat GPT-5.5 zuvor als sein bisher „intelligentstes, intuitivstes und benutzerfreundlichstes“ Modell beschrieben. Daher wird allgemein davon ausgegangen, dass GPT-5.5-Cyber ein auf dieser Grundlage basierendes Derivatprodukt sein wird, das auf Netzwerksicherheitsszenarien zur gezielten Stärkung ausgerichtet ist.

Die stufenweise und kleine Veröffentlichung leistungsstarker Modelle wird in der KI-Branche zu einem immer offensichtlicheren Trend. Viele Unternehmen haben begonnen zu betonen, dass ihre fortschrittlichsten Modelle aufgrund der Gefahr des Missbrauchs nicht für eine vollständige Öffnung für die Öffentlichkeit geeignet sind. OpenAI hat zuvor eine Batch-Release-Strategie für seine netzwerksicherheitsorientierten Modelle eingeführt; Neben der Netzwerksicherheit ist das neu eingeführte Life-Science-spezifische Modell GPT-Rosalind des Unternehmens auch ein Produkt, das auf bestimmte hochsensible Bereiche zugeschnitten ist und hauptsächlich der biologischen Forschung und der Arzneimittelentwicklung dient.

Diesen Monat ging Anthropic einen ähnlichen Weg, indem es Claude Mythos auf den Markt brachte und seine sichere und kontrollierte Freisetzungsmethode mit hoher Barriere energisch bewirbt. Allerdings machte Anthropic bei der Sicherheitsfreigabe des Modells ziemlich peinliche Fehler, die einst zu Kontroversen über die entsprechenden Regelungen führten.

In dem Bericht wurde auch erwähnt, dass die US-Regierung trotz früherer Spannungen zwischen dem Weißen Haus und Anthropic wegen Fragen im Zusammenhang mit dem Pentagon dem Startprozess von Mythos immer noch große Aufmerksamkeit schenkt. Dem „Wall Street Journal“ zufolge hat sich das Weiße Haus zuletzt sogar gegen eine weitere Ausweitung des Zugriffs auf Mythos ausgesprochen. Dies spiegelt auch von der Seite her wider, dass die US-Regierung eine zunehmend direkte und vorsichtige Interventionshaltung gegenüber der Veröffentlichung von KI-Modellen mit hoher Kapazität an den Tag legt, die möglicherweise Sicherheitsrisiken bergen.