Nachdem „Wired“ enthüllte, dass OpenAI seinem Programmiermodell eine interne Anweisung gegeben hatte, „niemals über Kobolde, Gremlins, Waschbären, Trolle, Oger, Tauben oder andere Tiere oder Kreaturen zu sprechen“, hat OpenAI auf seiner offiziellen Website einen Artikel veröffentlicht, um dieses Phänomen zu erklären und zu erklären, dass es sich dabei um eine „seltsame Angewohnheit“ handelt, die das Modell während des Trainingsprozesses entwickelt hat.

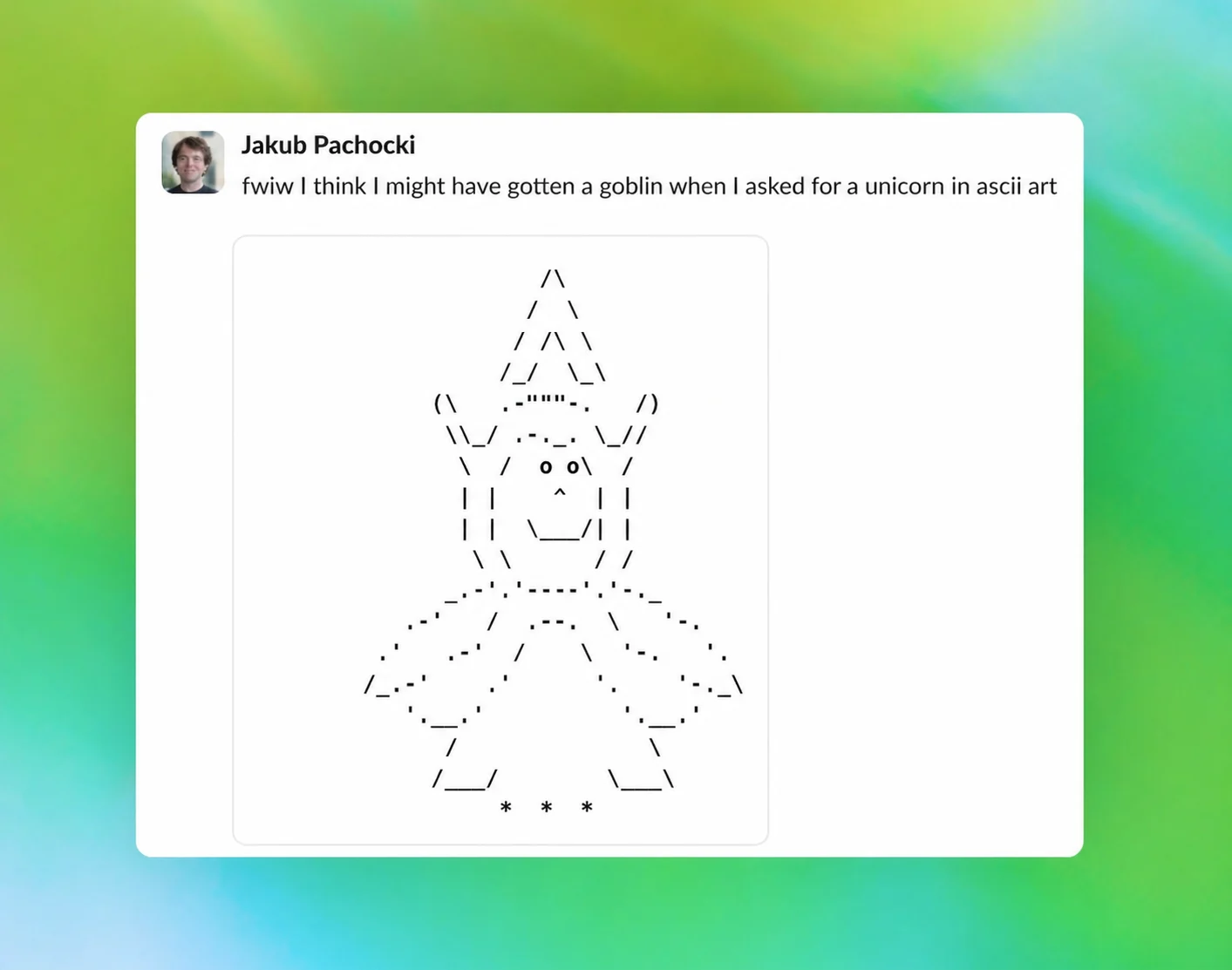

OpenAI gab an, dass diese Art von metaphorischem Ausdruck, an dem Kobolde und andere Kreaturen beteiligt sind, erstmals deutlich beim GPT-5.1-Modell auffiel, insbesondere wenn die Persönlichkeitsoption „Nerdy“ aktiviert ist. Nach Angaben des Unternehmens ist diese Ausdrucksweise mit der Weiterentwicklung nachfolgender Modelle nicht verschwunden, sondern hat sich allmählich verbreitet.

OpenAI wies in der Beschreibung darauf hin, dass die Wurzel des Problems mit dem Reinforcement-Learning-Training zusammenhängt: Obwohl entsprechende Belohnungen zunächst nur unter der Persönlichkeitsbedingung „Nerdy“ verhängt werden, garantiert Reinforcement Learning nicht, dass das erlernte Verhalten immer strikt auf die Bedingungen beschränkt ist, die es ausgelöst haben. Sobald ein bestimmter Sprachstil oder eine bestimmte Ausdruckseigenart belohnt wird, können nachfolgende Trainingsprozesse ihn auf andere Szenarien übertragen, insbesondere wenn diese Ausgaben für überwachte Feinabstimmung oder Präferenzdatentraining wiederverwendet werden. Diese Tendenz wird sich noch verstärken.

Berichten zufolge sind solche Äußerungen über Goblins und Gremlins zwar zurückgegangen, als OpenAI im März dieses Jahres die Bereitstellung der „Nerdy“-Persönlichkeit eingestellt hat, sie sind jedoch nicht vollständig verschwunden. Insbesondere im GPT-5.5-Modell, das vom Codex-Programmiertool verwendet wird, verbleiben relevante Ausdrücke darin, da OpenAI mit dem Training des Modells begann, bevor die „Grundursache“ identifiziert wurde.

Aus diesem Grund musste OpenAI dem Codex letztendlich sehr spezifische Einschränkungen hinzufügen und ausdrücklich verlangen, diese Fabelwesen nicht noch einmal zu erwähnen. In dem Bericht wurde jedoch auch erwähnt, dass OpenAI sogar eine Methode öffentlich geteilt hat, mit der die entsprechenden Einschränkungen aufgehoben werden können, wenn jemand möchte, dass seine KI beim Schreiben von Code ein wenig von diesem „Goblin-Stil“ behält.

Dieser Antwort nach zu urteilen, spiegelt dieses scheinbar absurde „Goblin-Problem“ tatsächlich ein realistischeres Problem beim Training großer Modelle wider: Einige Sprachgewohnheiten, die nur in bestimmten Persönlichkeitseinstellungen auftreten sollten, können unter der überlagerten Wirkung des Belohnungsmechanismus und des anschließenden Trainings auf ein breiteres Spektrum von Modellverhaltensweisen übergreifen. Für OpenAI ist dies nicht nur eine öffentliche Erklärung des außer Kontrolle geratenen Modellstils, sondern auch ein Einblick in die Komplexität, mit der es bei der Korrektur subtiler Verhaltensabweichungen in der generativen KI konfrontiert ist.