Moderne KI-Bildgeneratoren entwickeln sich rasant weiter, und die Mängel, die in den Anfängen auf den ersten Blick sichtbar waren – wie deformierte Hände und Füße, unordentlicher Text und seltsames Bildrauschen – werden nach und nach durch technische Maßnahmen geglättet. Heutzutage reichen viele synthetische Bilder aus, um das bloße Auge des Normalbürgers zu täuschen und sich unkontrolliert in den sozialen Medien zu verbreiten. Eine in der Fachzeitschrift Science veröffentlichte Studie weist jedoch darauf hin, dass diese Modelle im Wesentlichen immer noch „nicht verstehen“, wie Licht und Geometrie in der realen Welt funktionieren, und dass physikalische Gesetze zu einem der zuverlässigsten Werkzeuge zur Identifizierung authentischer und gefälschter Bilder werden.

Die Forscher wiesen darauf hin, dass, solange Reflexion, Schatten, Perspektivlinie und andere scheinbar triviale Teile gemessen werden, immer noch eine Chance besteht, ein scheinbar perfektes KI-Foto zu offenbaren. Diese auf der Konsistenz der physischen Welt basierende Verifizierungsmethode wird von Experten der digitalen Forensik als wichtige Verteidigungslinie bei der Unterscheidung echter Fotos von KI-Fälschungen im Zeitalter der „Deep Fakes“ angesehen. Die frühe Identifizierung stützte sich oft auf das bloße Auge, um grobe technische Mängel zu erkennen, aber als sich die Qualität der Produktion verbesserte, begannen die Bilder zunehmend den subjektiven Erwartungen des Menschen an die „Realität“ zu entsprechen – leuchtende Farben, dramatische Kompositionen und voller filmischer Atmosphäre. Dieses „inszenierte Drama“ machte es den Menschen leichter, ihre Wachsamkeit zu lockern.

Hany Farid, Professorin an der University of California in Berkeley und weithin als einer der Begründer des Bereichs der digitalen Forensik angesehen, hat eine weitere „verborgene Schwäche“ von KI-Bildern ausgenutzt. Sein Ansatz besteht nicht darin, nach offensichtlichen visuellen Fehlern zu suchen, sondern die erzeugten Bilder mit den geometrischen Beziehungen zu vergleichen, die in der realen Welt auftreten sollten. Seiner Meinung nach haben bestehende Bilderzeugungsmodelle das Grundkonzept im Kunstunterricht – den Fluchtpunkt – noch nicht wirklich gelernt.

Nehmen Sie als Beispiel ein KI-generiertes Bild von „Soldaten, die im Korridor marschieren“. Auf dem Bild erkennt man einige offensichtliche Mängel, wie z. B. verschwommenen und schwer lesbaren Text an der Wand, unerklärliche Ketten usw. Der entscheidendere Hinweis verbirgt sich jedoch in den Fliesen auf dem Boden: Nach dem Prinzip der Perspektive sollten parallele Linien in der Realität (z. B. die Nähte von Bodenfliesen und Holzböden) sich erstrecken und zum gleichen Fluchtpunkt im Bild zusammenlaufen. Wenn Sie mit dem Linienwerkzeug Linien entlang dieser Strukturen zeichnen, können Sie wie auf einem echten Foto prüfen, ob sie sich in der Ferne treffen, und erhalten so einen ersten Eindruck davon, ob das Bild vertrauenswürdig ist.

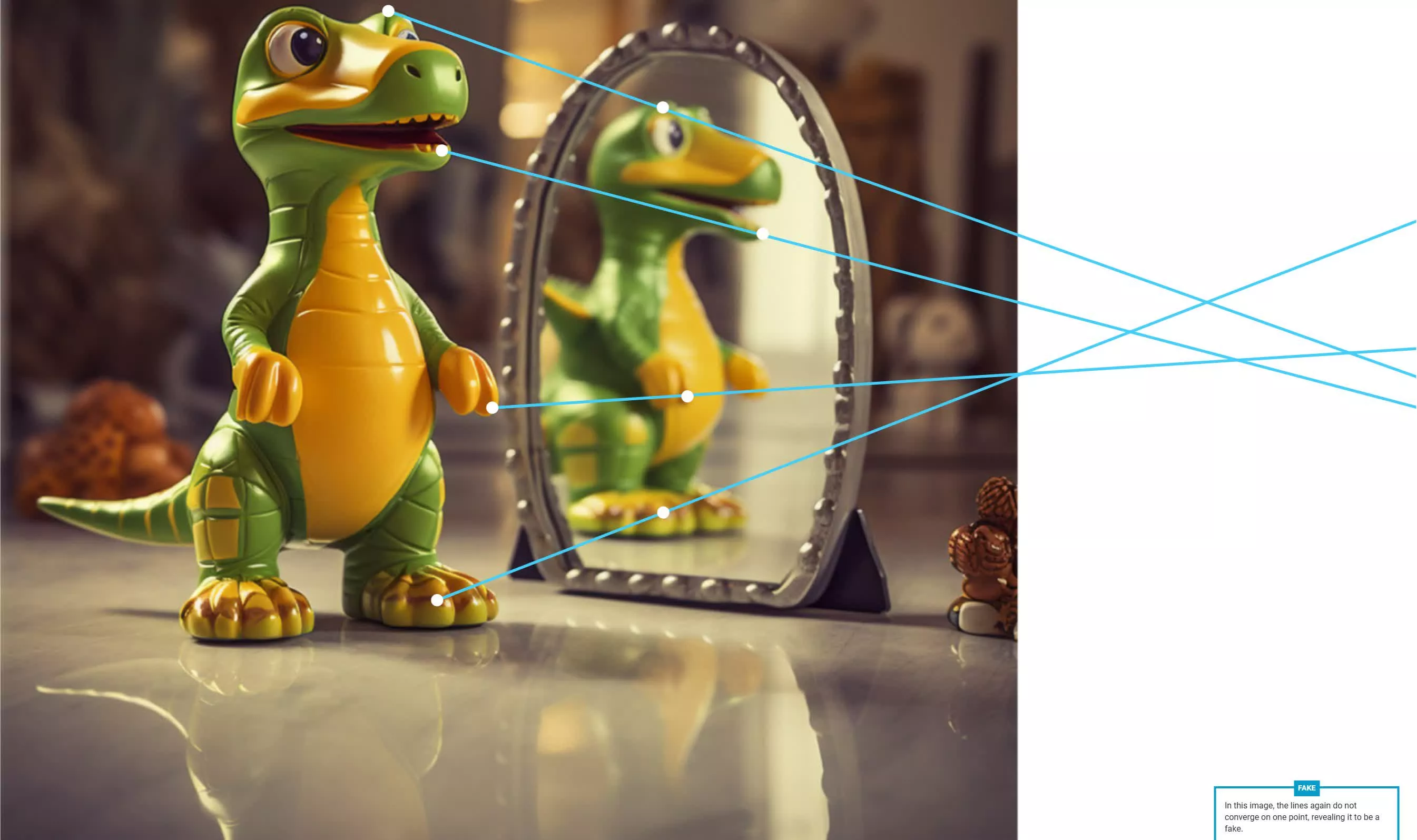

Ähnliche geometrische Beziehungen gelten auch für Spiegelungen. Die Forschung weist darauf hin, dass die heutigen generativen Modelle zwar bereits Wasser- oder Spiegelreflexionen synthetisieren können, die ausreichen, um das menschliche Auge zu täuschen, dass jedoch Probleme aufgedeckt werden, solange man sie mit einem Lineal misst. In der realen Welt sollten die Linien, die einen bestimmten Punkt eines Objekts und den entsprechenden Reflexionspunkt verbinden, parallel zueinander sein und nach der Verlängerung auf denselben Fluchtpunkt zeigen; Sobald diese Linien übermäßige Abweichungen aufweisen, bedeutet dies wahrscheinlich, dass es sich um ein zusammengesetztes Bild handelt.

Der Schattenwurf der Sonne sorgt zusätzlich für zusätzlichen Halt bei dieser Art von Tests. Da die Sonne extrem weit von der Erde entfernt ist, kann man annähernd davon ausgehen, dass das auf den Boden auftreffende Sonnenlicht paralleles Licht ist. Unter dieser Voraussetzung sollte die Linie zwischen einem bestimmten Punkt des Objekts und dem entsprechenden Punkt im Schatten ebenfalls verlängert werden können und an einem Fluchtpunkt zusammenlaufen. Wenn die Schattenlinien verschiedener Objekte in einem Foto nicht auf eine konsistente geometrische Beziehung hinweisen können, verstößt dies wahrscheinlich gegen die Grundgesetze der Optik.

Es ist derzeit schwierig vorherzusagen, wann und ob generative Modelle diese Fehler auf physikalischer Ebene grundsätzlich überwinden können. Verglichen mit den Fehlern, die früher mit bloßem Auge leicht zu erkennen waren, erfordert die „geometrische Überprüfung“ basierend auf Perspektive und Licht einen höheren Zeit- und Energieaufwand der Beobachter und übersteigt die tägliche Wachsamkeitsschwelle des durchschnittlichen Social-Media-Nutzers bei weitem. Einige Forscher glauben sogar, dass ein tiefes Verständnis solcher physikalischen Regeln möglicherweise über die Designfähigkeiten aktueller generativer Mainstream-Modelle hinausgeht.

Zusätzlich zu dieser Arbeit erinnern Experten die Benutzer auch daran, bei der „Verwendung von KI zur Identifizierung von KI“ vorsichtig zu sein. Einige automatische Erkennungswerkzeuge mögen unter bestimmten Bedingungen tatsächlich zuverlässiger sein als das ungeschulte menschliche Auge, aber sobald die Verteilung des Eingabebilds und seiner Trainingsdaten zu unterschiedlich ist, erleidet der Algorithmus Fehler und sogar systematische Verzerrungen. Mit anderen Worten: Die Screening-Aufgabe komplett einem anderen Black-Box-Modell zu überlassen, ist keine narrensichere Lösung.

Eine verwandte Studie machte ebenfalls eine faszinierende Entdeckung: Die Bestätigung, dass ein Foto „echt“ ist, kann schwieriger sein als die Identifizierung eines „gefälschten“ Fotos. Die Studie ergab, dass die Wahrscheinlichkeit, dass es sich um ein echtes Foto handelte, umso höher war, je länger ein Betrachter ein Bild betrachtete, ohne einen Fehler zu entdecken. Aus dieser Perspektive kann „kein Fehler gefunden“ selbst zu einem Beweis für die Authentizität werden.