NVIDIA beschleunigt die Einführung seiner KI-Flaggschiffplattform der nächsten Generation, Vera Rubin. Die neuesten Nachrichten zeigen, dass die Plattform bereits im Juli dieses Jahres an große nordamerikanische Cloud-Dienste und KI-Kunden ausgeliefert wird und in der zweiten Hälfte des Jahres 2026 in die Massenproduktion gehen wird. Frühere Gerüchte, dass Vera Rubin Probleme mit ihrem Design und ihren Spezifikationen habe, wurden nun durch den neuen Produktions- und Versandplan im Wesentlichen dementiert.

Vor einigen Tagen kursierten in der Branche Nachrichten über mögliche Anpassungen oder sogar Probleme im Design und den Spezifikationen von Vera Rubin, die als ähnlich beschrieben wurden wie die Turbulenzen, die der Blackwell-GPU-Server vor seiner Veröffentlichung erlebte. Basierend auf der Erfahrung, die Nvidia bei der Lieferung von KI-Racks und Servern der nächsten Generation mit Lieferkettenpartnern gesammelt hat, hat Nvidia jedoch erneut seine Fähigkeit unter Beweis gestellt, technische Mängel vor der Massenproduktion schnell zu beheben. In einem Bericht der taiwanesischen „Economic Daily“ unter Berufung auf Branchenketten wurde darauf hingewiesen, dass Nvidia mit seinen ODM-Partnern die endgültige Massenproduktionsversion von Vera Rubin fertiggestellt und einen klaren Einführungsrhythmus festgelegt habe.

Diesem Bericht zufolge wird Nvidia im Juni dieses Jahres mit der Testproduktion der Vera Rubin-Plattform beginnen und dann ab Juli die ersten Serverchargen an mehrere große Cloud-Dienstanbieter und KI-Rechenzentrumskunden in Nordamerika ausliefern. Zur ersten Kundenliste zählen Microsoft, Google, Amazon, Meta und Oracle. Nvidia dürfte in der kommenden Keynote-Rede zur Computex 2026 seine intensive Zusammenarbeit mit diesen Cloud-Giganten um Vera Rubin hervorheben. In dem Bericht wurde auch erwähnt, dass TSMC Anfang des Jahres den 3-nm-Prozess eingeführt hat, um mit der Massenproduktion von Vera-Rubin-Chips zu beginnen, während Gießereipartner wie Foxconn, Quanta und Wistron die Produktion kompletter Maschinen und Rahmen ab der zweiten Hälfte dieses Jahres vollständig einführen und bereits im dritten Quartal 2026 Massenlieferungen erreichen werden.

Während sich der Staub über die endgültigen Produktionsspezifikationen legt, werden frühere Aussagen, dass die Vera-Rubin-Plattform erheblichen Design- oder Spezifikationsänderungen unterliegen könnte, als „unvereinbar mit den Fakten oder auf Grundlage früher Informationen, die später überarbeitet wurden“ angesehen. Die Branche schätzt, dass sich die Kosten für jedes Vera Rubin AI-Server-Rack auf etwa 180 Millionen US-Dollar belaufen. Mit dieser Plattform wird erwartet, dass Nvidias potenzielle Durchdringung des globalen Marktes für KI-Infrastruktur die Marke von 1 Billion US-Dollar erreichen wird. Dies wird nicht nur die Gewinnmargen erheblich steigern, sondern auch Partnern, einschließlich Speicher- und Speicherlieferanten, neue Wachstumsimpulse verleihen.

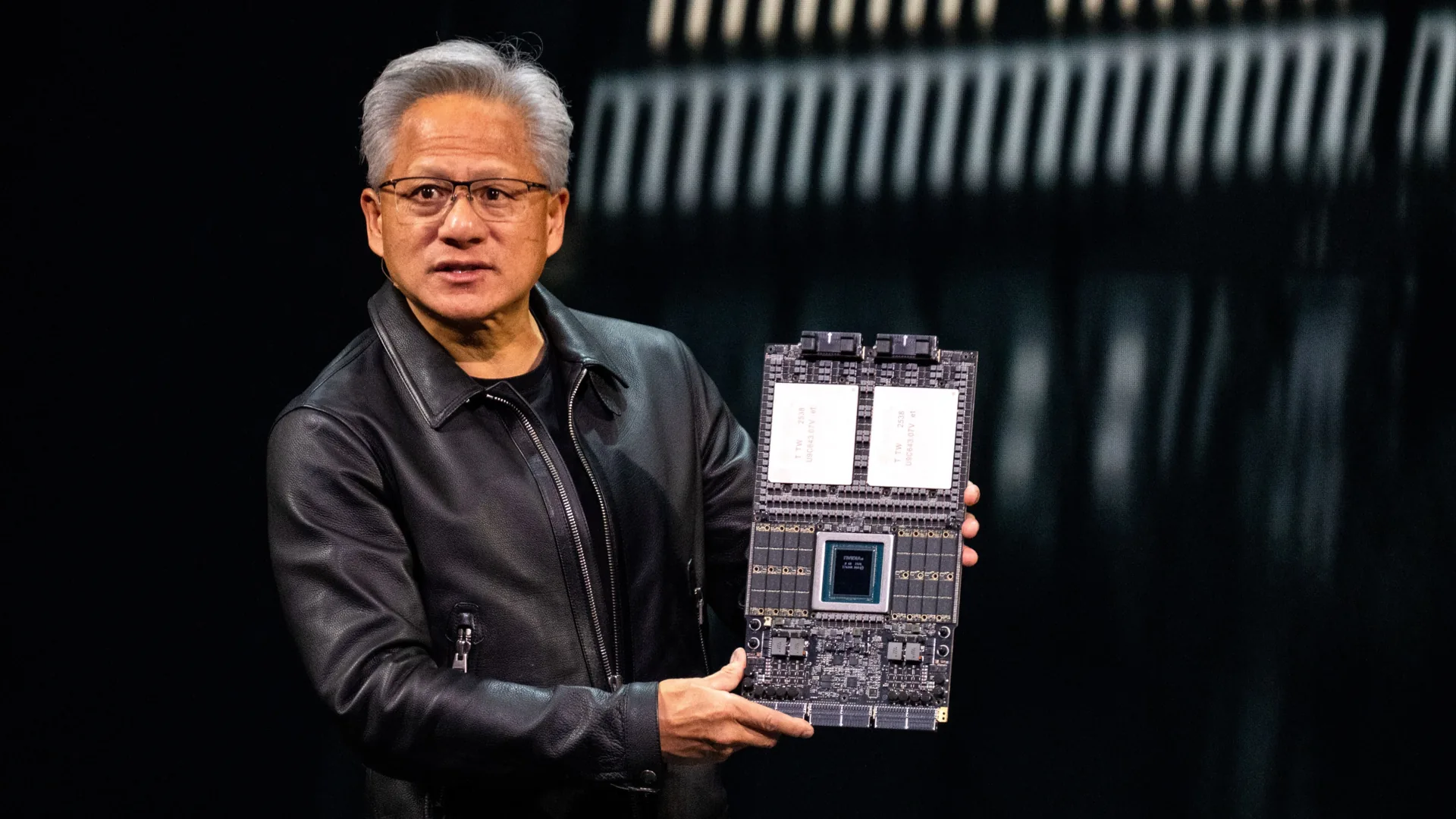

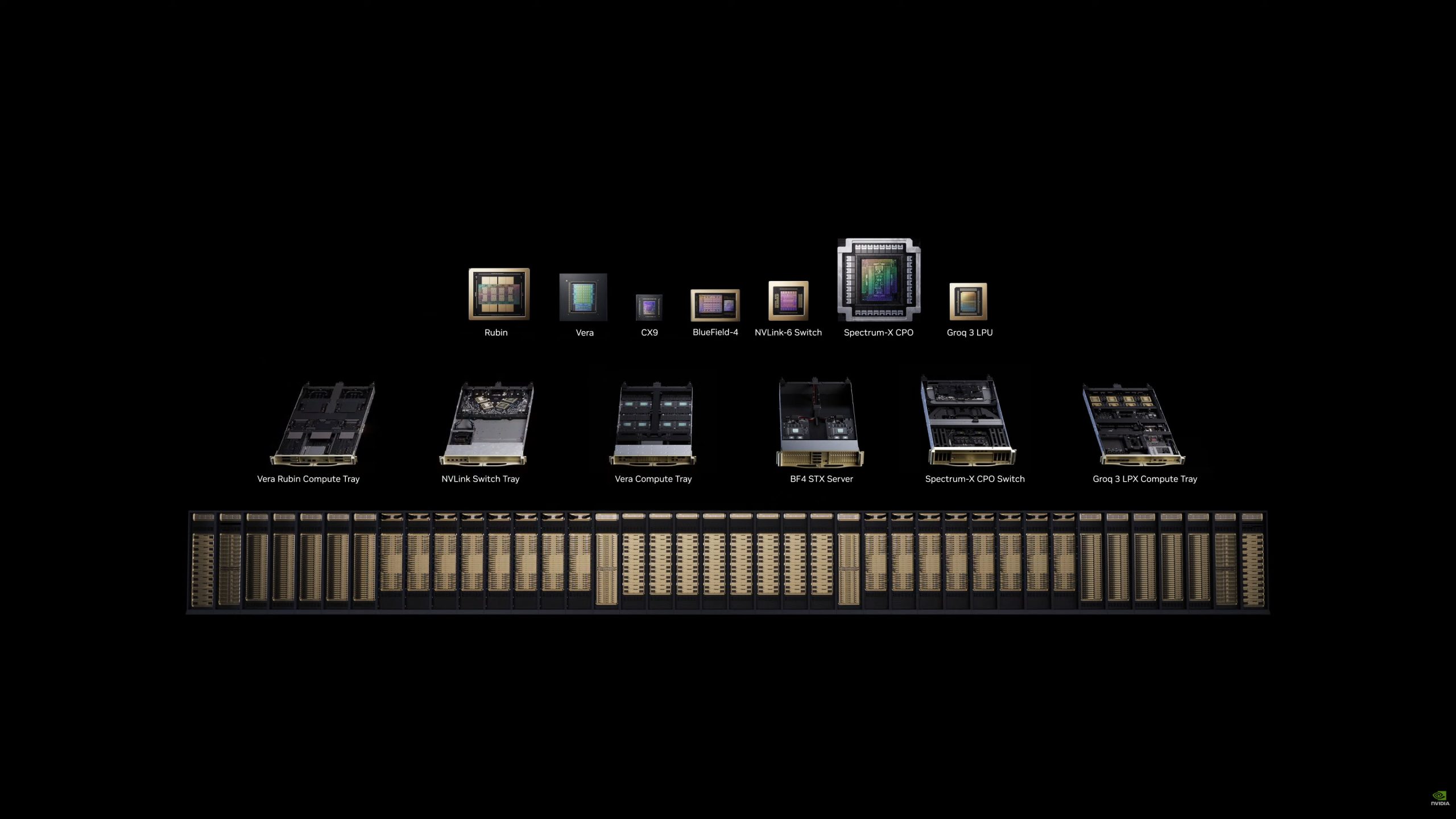

Rund um die Vera Rubin-Plattform werden gleichzeitig die Chip- und Speicherökologie verbessert: Partnerhersteller planen die Einführung einer neuen Generation von HBM4-Speicher mit hoher Bandbreite für Rubin-GPUs und stellen gleichzeitig eine SOCAMM2 LPDDR5X-Lösung mit einer Kapazität von bis zu 256 GB auf der CPU-Seite bereit, um den immer strengeren Anforderungen an Bandbreite und Kapazität beim Training und Inferenz von Großmodellen gerecht zu werden. Auf der Ebene der Hardwarearchitektur wird Vera Rubin als komplexe Plattform beschrieben, die aus sieben Chips besteht und von einem leistungsstarken Software-Stack unterstützt wird. Es gilt als vorübergehend konkurrenzlos in der Branche. Nvidia hat angekündigt, mithilfe von Vera Rubin seine Rechenleistung in den nächsten zehn Jahren voraussichtlich auf das 40-Millionen-fache des aktuellen Niveaus zu steigern. Basierend auf früheren Technologievorschauen geht die Branche außerdem allgemein davon aus, dass diese Plattform eine neue Runde sprunghafter Sprünge in der KI-Rechenleistung mit sich bringen wird.

Dem Zeitplan nach zu urteilen, entfernt sich Vera Rubin von Gerüchten und Unsicherheiten und tritt in die Phase der substanziellen Testproduktion und Auslieferung ein. Da die ersten Racks ab Juli in den Rechenzentren nordamerikanischer Cloud-Dienstleister landen und taiwanesische OEMs in der zweiten Jahreshälfte mit der Massenproduktion beginnen, wird Vera Rubin NVIDIAs Kerngewicht in der nächsten Phase des KI-Infrastrukturwettbewerbs werden und auch einen tiefgreifenden Einfluss auf die globale Cloud-Computing- und KI-Branchenlandschaft haben.