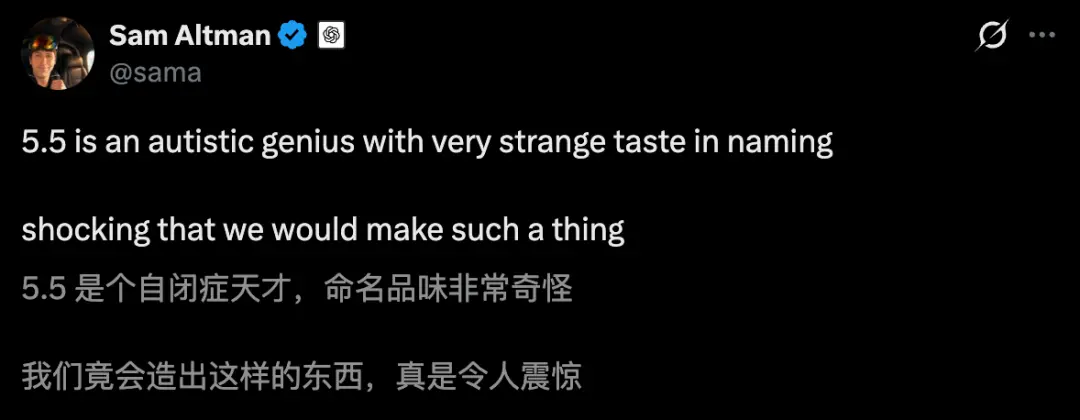

Gerade eben hat Ultraman GPT-5.5 persönlich einen Spitznamen gegeben, der das gesamte Internet schockierte – „Autistisches Genie“. Einen halben Monat nachdem GPT-5.5 online ging, äußerte Ultraman auf sozialen Plattformen mehrfach unverhohlen seine Begeisterung. Er konnte sich ein Seufzen nicht verkneifen. Ich kann nicht glauben, dass wir tatsächlich so eine KI erschaffen haben!

In Ultramans eigenen Worten hat die „ursprüngliche Intelligenz“ von GPT-5.5 eine Lücke auf Fehlerebene geöffnet:

Die Laufergebnisse sind überwältigend, die Token-Ersparnisse schießen in die Höhe und die Ästhetik von Leistung und Gewalt ist perfekt.

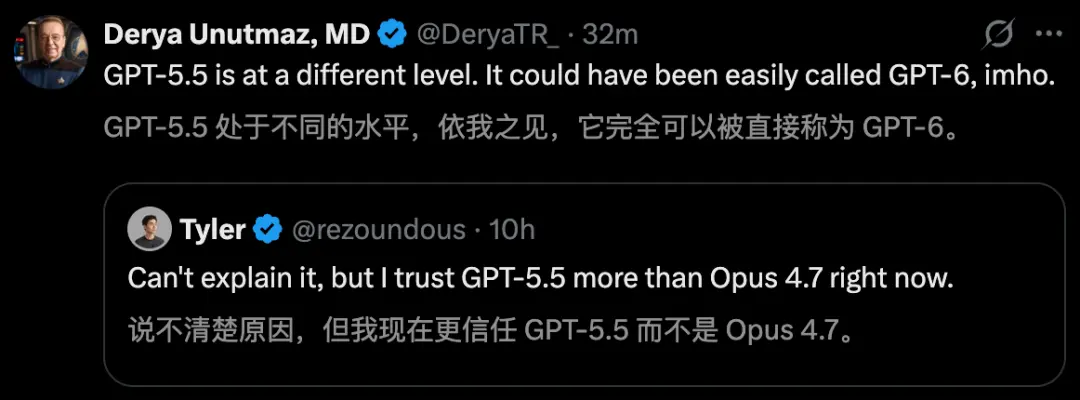

Große Namen im KI-Kreis haben mit ihren Füßen für GPT-5.5 gestimmt. Sogar KI-Professor Derya Unutmaz sagte unverblümt, dass es GPT-6 heißen kann!

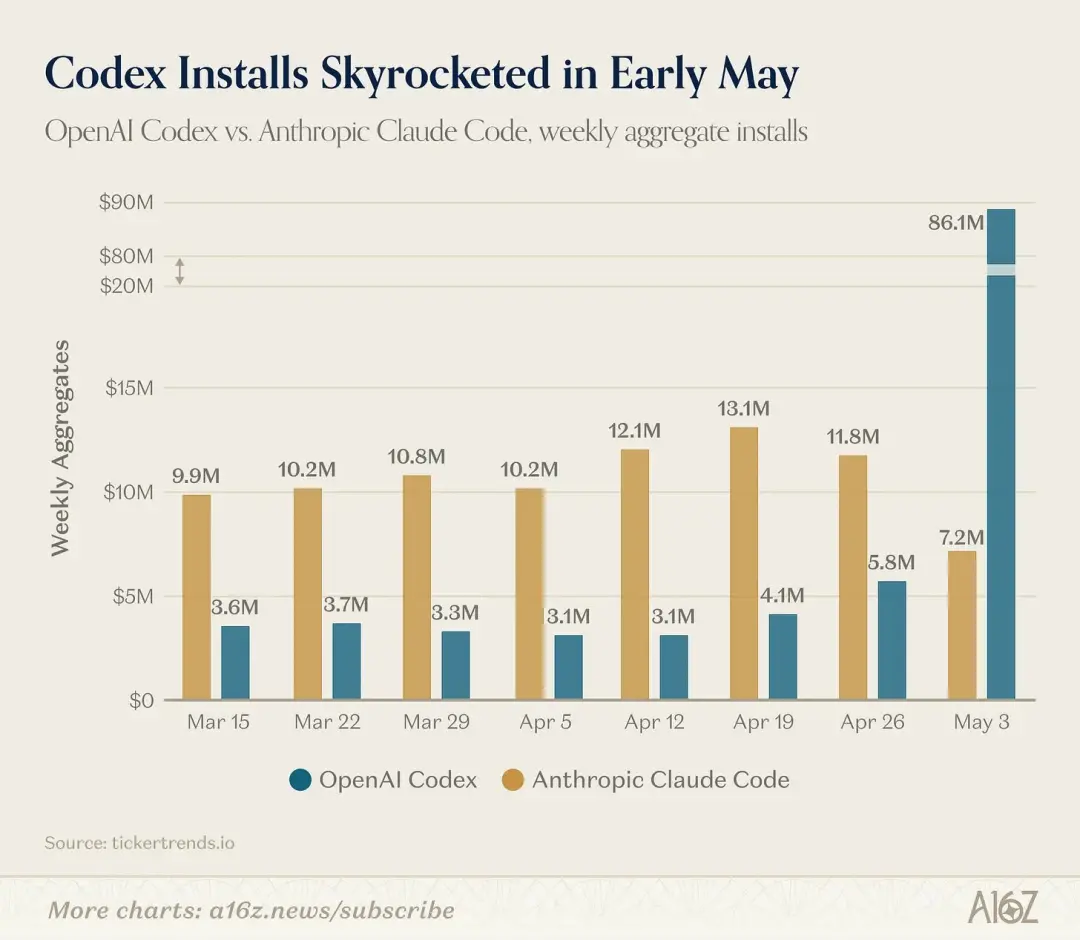

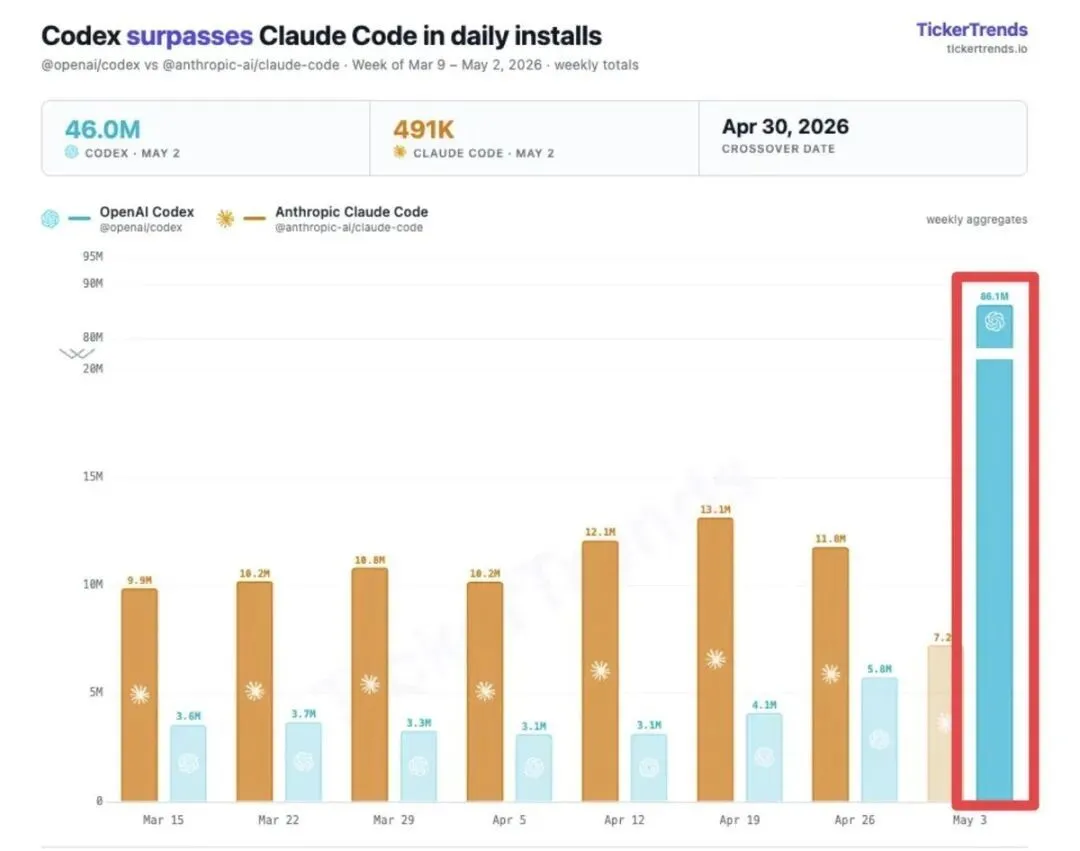

Auch heute ging ein Diagramm im gesamten Internet viral. Die von GPT-5.5 unterstützten Codex-Downloads stiegen im Mai rasant auf 86,1 Millionen und übertrafen damit die Zahl von Claude Code bei weitem.

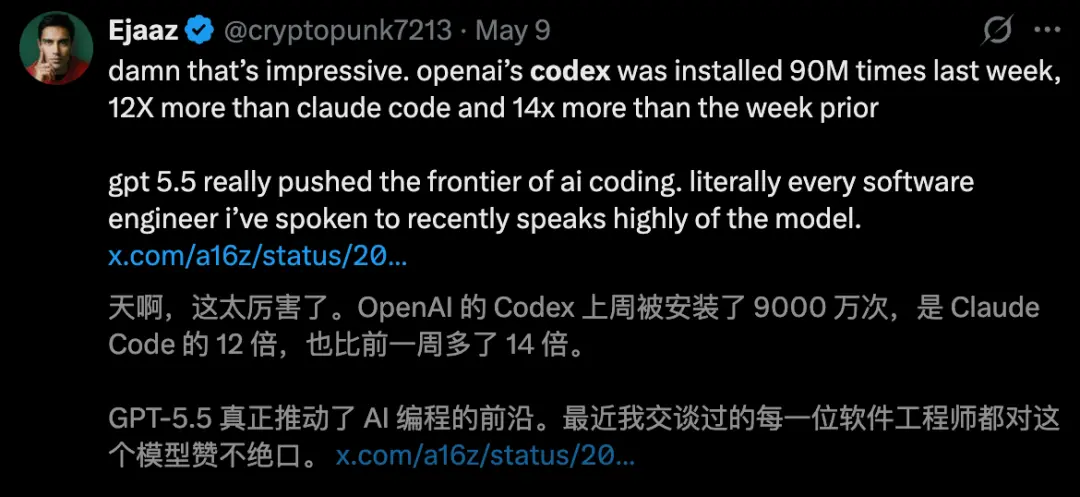

Allein letzte Woche überstieg die Zahl der Downloads 90 Millionen, das ist das Zwölffache von Claude Code.

Gleichzeitig belegen auch die Rückmeldungen der Entwickler diesen Punkt.

Viele Leute haben öffentlich erklärt, dass die Leistung von GPT-5.5 die von Claude Opus 4.7 bei tatsächlichen Codierungsaufgaben, insbesondere beim Token-Verbrauch, übertroffen hat.

Für die gleiche Aufgabe verwendet GPT-5.5 fast 40 % weniger Token als Claude.

Ich muss sagen, dass die Metapher vom „autistischen Genie“ so zutreffend ist, dass sie die Menschen ein wenig verunsichert.

Ein 16-köpfiges Team kann 32.000 US-Dollar pro Monat sparen, indem es sich von Claude abmeldet

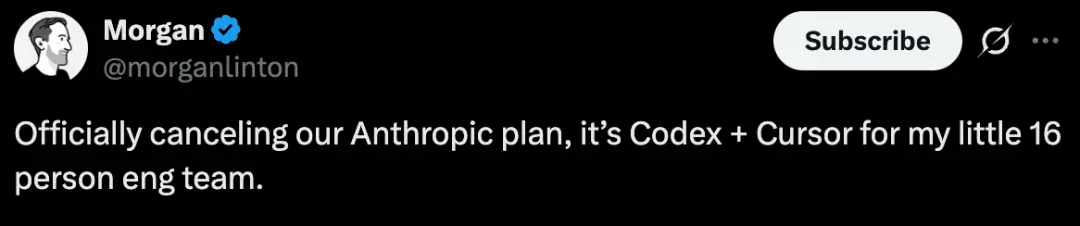

Morgan Linton, Gründer des Startup-Unternehmens Bold Metrics, veröffentlichte einen Beitrag mit ruhigem Ton, aber explosivem Inhalt:

Verabschieden Sie sich offiziell von Anthropic!

Für mein kleines Ingenieurteam von 16 Leuten hat die Kombination aus Codex + Cursor die ursprüngliche Lösung vollständig ersetzt.

Der Grund ist einfach und grob: Claude Code ist zu teuer!

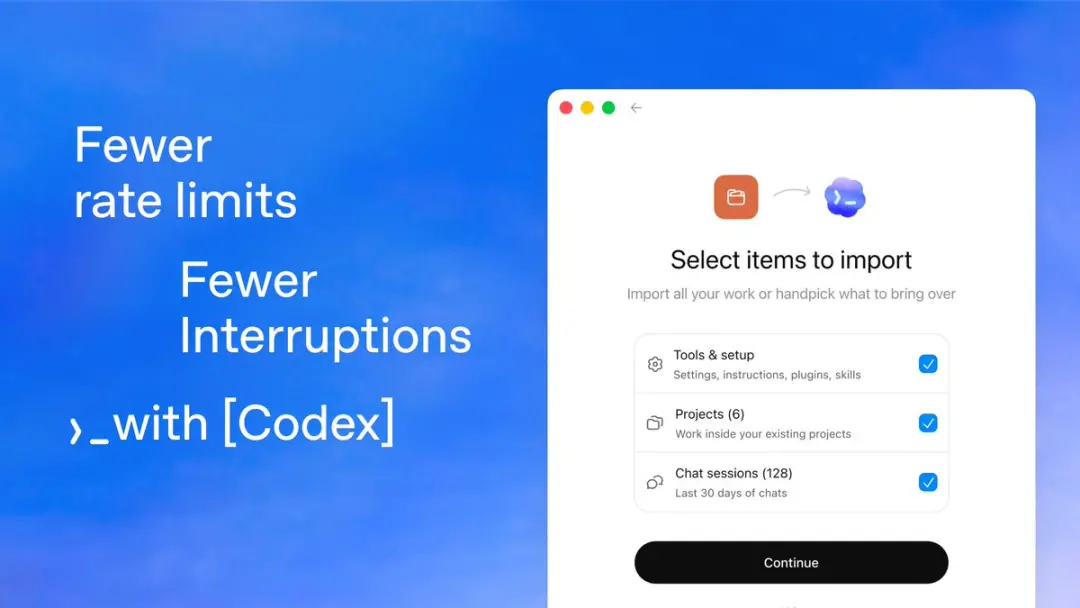

Im Gegensatz dazu war die jüngste Leistung von Codex mit der Unterstützung von GPT-5.5 erstaunlich und die Token-Nutzungsrate ist extrem hoch, was sehr kostensparend ist.

In der tatsächlichen Arbeit verwendet Bold Metrics immer noch häufig Cursor zur Codeüberprüfung.

Das Wichtigste ist, dass die Verwendung von Cursor durch das Team bisher noch nie zu Tabellenbeschränkungen geführt hat und die integrierte Composer 2-Funktionalität ausreicht, um die überwiegende Mehrheit der Entwicklungsszenarien zu bewältigen.

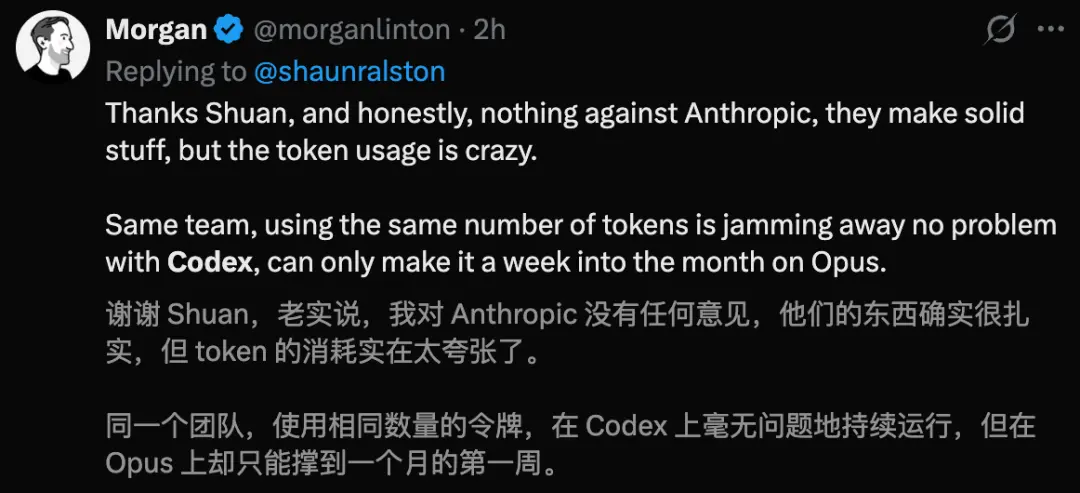

Bezüglich des Verbrauchs von Claude Token hat Linton eine Berechnung durchgeführt:

Jeder Ingenieur kostet mehr als 2.000 US-Dollar pro Monat und 16 Personen geben mehr als 32.000 US-Dollar pro Monat aus.

Nach der Umstellung auf Codex + Cursor hat die Token-Effizienz von GPT-5.5 die Kosten drastisch gesenkt, ohne die Leistung zu beeinträchtigen.

Noch beunruhigender ist seine Prognose, dass immer mehr führende Ingenieure ähnliche Entscheidungen treffen werden.

Man muss sagen, dass dieser Beitrag wie eine Tiefenbombe war, die direkt die Lebensader von Anthropic traf –Das Produkt ist gut, aber der Token-Konsum ist einfach nur Geldraub..

Was ist mit Codex? Die Daten liefern bereits die Antwort.

Mit 90 Millionen Downloads pro Woche ist Codex zu einem Mythos geworden

Daten von TickerTrends zeigen, dass Codex bis zum 3. Mai atemberaubende 86,1 Millionen Mal heruntergeladen wurde, was einer Steigerung von 1397 % gegenüber der Vorwoche entspricht.

Bis zum 8. Mai stieg diese Zahl innerhalb einer einzigen Woche weiter auf 90 Millionen.

Gleichzeitig wurde Claude Code von Anthropic im gleichen Zeitraum 7,2 Millionen Mal heruntergeladen, was einem Rückgang von 38 % gegenüber der Vorwoche entspricht.

Einer rennt und der andere verliert Blut. Die Geschwindigkeit einer Ebbe und Flut ist erdrückend.

Der Wendepunkt dieser Wachstumswelle ist klar –

Am 30. April veröffentlichte Codex die Version v0.128.0, die einen persistenten/Ziel-Workflow einführte und die sitzungsübergreifende, mehrstufige Aufgabenplanung unterstützte.

In Verbindung mit den Millionen von Token-Kontexten, die GPT-5.5 mit sich bringt, und der 40-prozentigen Verbesserung der Token-Effizienz stimmen Entwickler mit ihren Füßen ehrlicher ab als jede Bewertung.

Auch Altman selbst benutzte in einem internen Brief ein Wort, um das Wachstum von Codex zu beschreiben: verrückt!

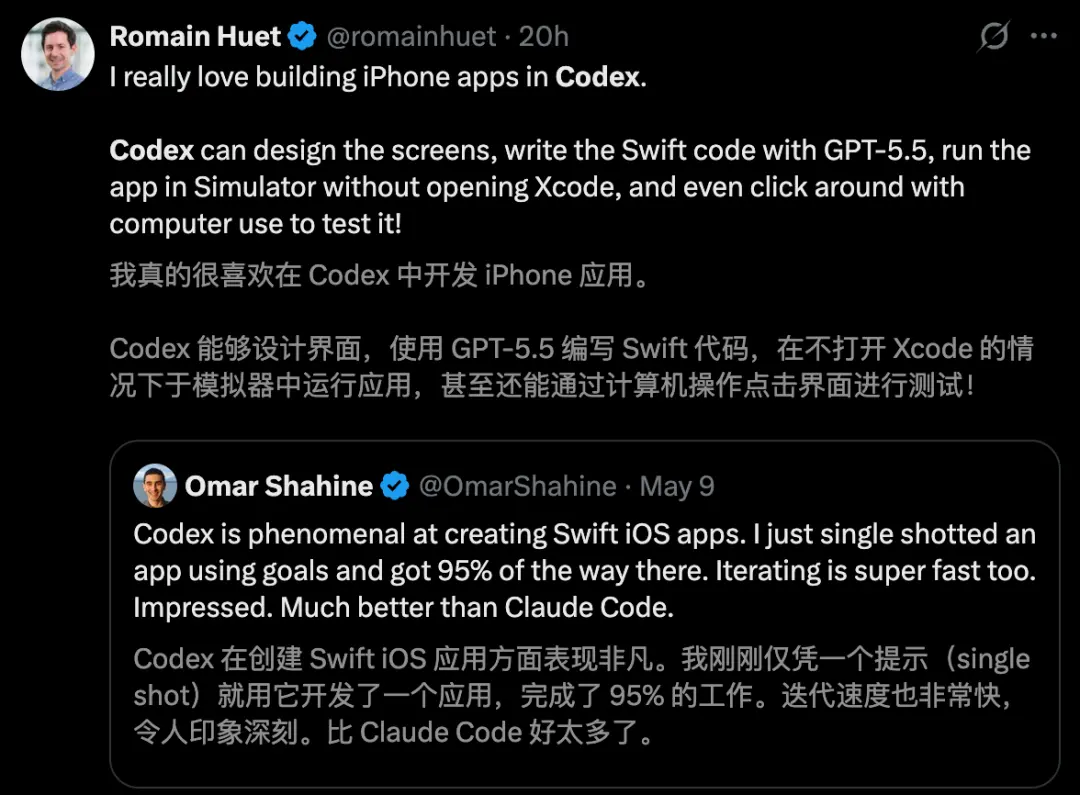

Microsoft-Vizepräsident Omar Shahine konnte sich ein Lob nicht verkneifen: „Codex hat bei der Entwicklung von Swift-iOS-Anwendungen außergewöhnlich gute Leistungen erbracht.“

Er nutzte nur eine Eingabeaufforderung, und Codex kam direkt aus der Anwendung heraus und löste 95 % der Arbeit. Es war viel einfacher zu verwenden als Claude Code.

Unmittelbar danach sagte Romain Huet, Leiter Developer Experience bei OpenAI:

Codex kann die Schnittstelle entwerfen, GPT-5.5 zum Schreiben von Swift-Code verwenden und Sie können die App direkt im Simulator ausführen, ohne Xcode überhaupt öffnen zu müssen. Sie können es sogar überall per „Computersteuerung“ testen!

Entwickler Dimitris Papailiopoulos sagte auch, dass er Codex mehr vertraue.

Jetzt, mit Codex, sagte Ultraman, dass seine Zeit freier sei.

Ultramans „Wahrheit“ spät in der Nacht und der Kommentarbereich geriet außer Kontrolle

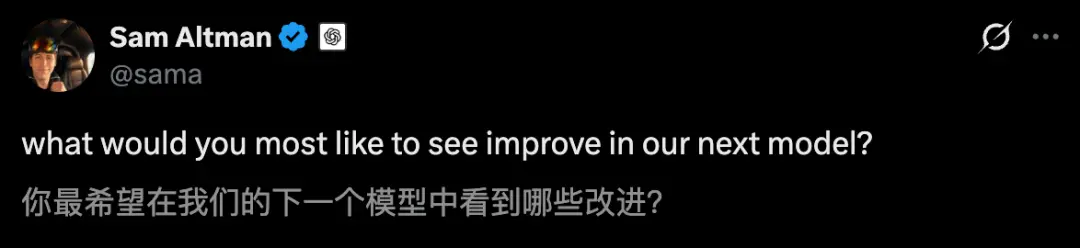

Außerdem hat Allman heute damit begonnen, online Meinungen einzuholen: „Was möchten Sie am OpenAI-Modell der nächsten Generation am meisten verbessern?“

Eine Zeit lang explodierte der Kommentarbereich mit Vorschlägen.

Ein überaus lobender Kommentar hat OpenAI an die Wand genagelt

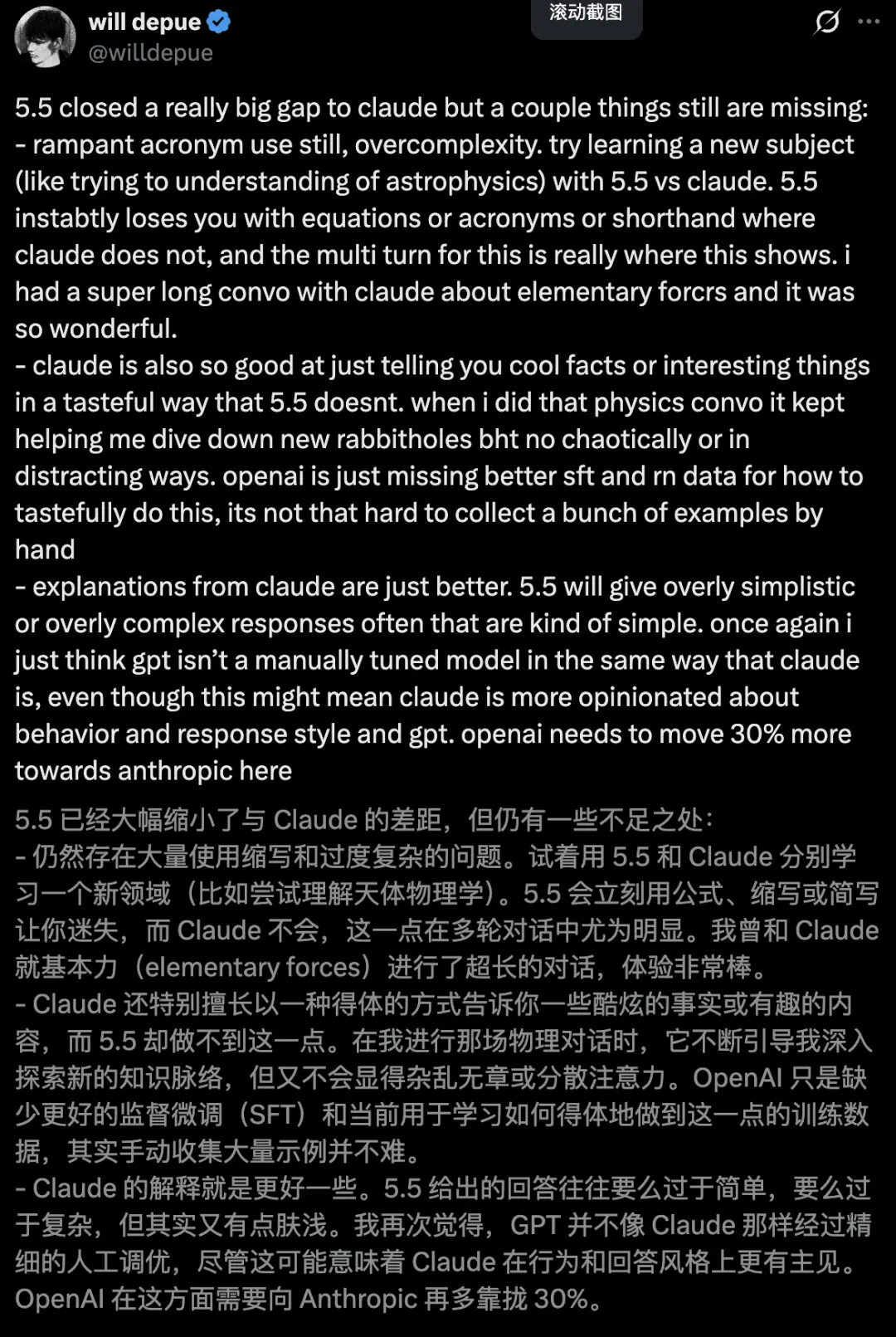

Die Antwort des ehemaligen OpenAI-Forschers Will Depue rückte in den Mittelpunkt des Publikums.

GPT-5.5 verringerte den Abstand zu Claude, verlor jedoch völlig an der „menschlichen Note“.

Er gab ein Beispiel. Wenn Sie Astrophysik lernen möchten, wirft GPT-5.5 sofort eine Menge kalter Abkürzungen und Formeln weg, die Sie verwirren;

Und Claude ist wie ein sachkundiger und eleganter Tutor, der Sie in den Kaninchenbau unterschiedlicher Kenntnisse führen kann, der sowohl interessant als auch nicht chaotisch ist.

Darüber hinaus rief er, dass die Datenoptimierung von OpenAI zu mechanisch sei, also lernte er schnell von Anthropic und reduzierte die „Persönlichkeit“ und „Erklärungskraft“ des Modells um 30 %.

Das mächtigste Modell im Internet wird eigentlich nicht gemocht, weil es „wie ein Mensch“ ist.

Andere hoffen, dass ChatGPT die Fähigkeit, Anweisungen zu befolgen und zu schreiben, verbessern kann.

Darüber hinaus ist das Frontend das, was Internetnutzer am häufigsten erwähnen, und sie hoffen auf deutliche Verbesserungen.